Generative KI hat das Feld der Computervision revolutioniert, indem sie Maschinen befähigt, realistische Bilder, Videos und sogar Texte zu erstellen. Unter den verschiedenen Techniken, die in der generativen KI verwendet werden, sind Generative Adversarial Networks (GANs) weit verbreitet und erfolgreich. Allerdings ist ein neuer Konkurrent aufgetaucht: Stable Diffusion. In diesem Blogbeitrag werden wir den Kampf zwischen GANs und Stable Diffusion untersuchen, ihre Stärken und Schwächen vergleichen und die Kraft von Stable Diffusion mit Hilfe des Stable Diffusion Image Generators von Anakin AI demonstrieren.

Artikelzusammenfassung

Vergleich verfügbarer generativer Modelle wie Autoencoder, GANs (Generative Adversarial Networks) und Diffusionsmodelle.

Stabile Diffusionsmodelle sind bei allgemeiner Nutzung beliebter, insbesondere für kreatives Design.

GANs sind im Fall von realistischen Zeitrafferbildern nützlicher.

Was sind generative Modelle?

Generative Modelle sind Deep-Learning-Modelle, die die Fähigkeit haben, neue Proben zu generieren, die den Trainingsdaten ähneln. Diese Modelle lernen die zugrunde liegende Verteilung der Trainingsdaten und können neue Proben generieren, die ähnlich den beobachteten Daten sind. Sie wurden in einer Vielzahl von Anwendungen eingesetzt, von der Erzeugung realistischer Bilder bis zur Generierung neuer Musikkompositionen.

An generativen Modellen interessiert?

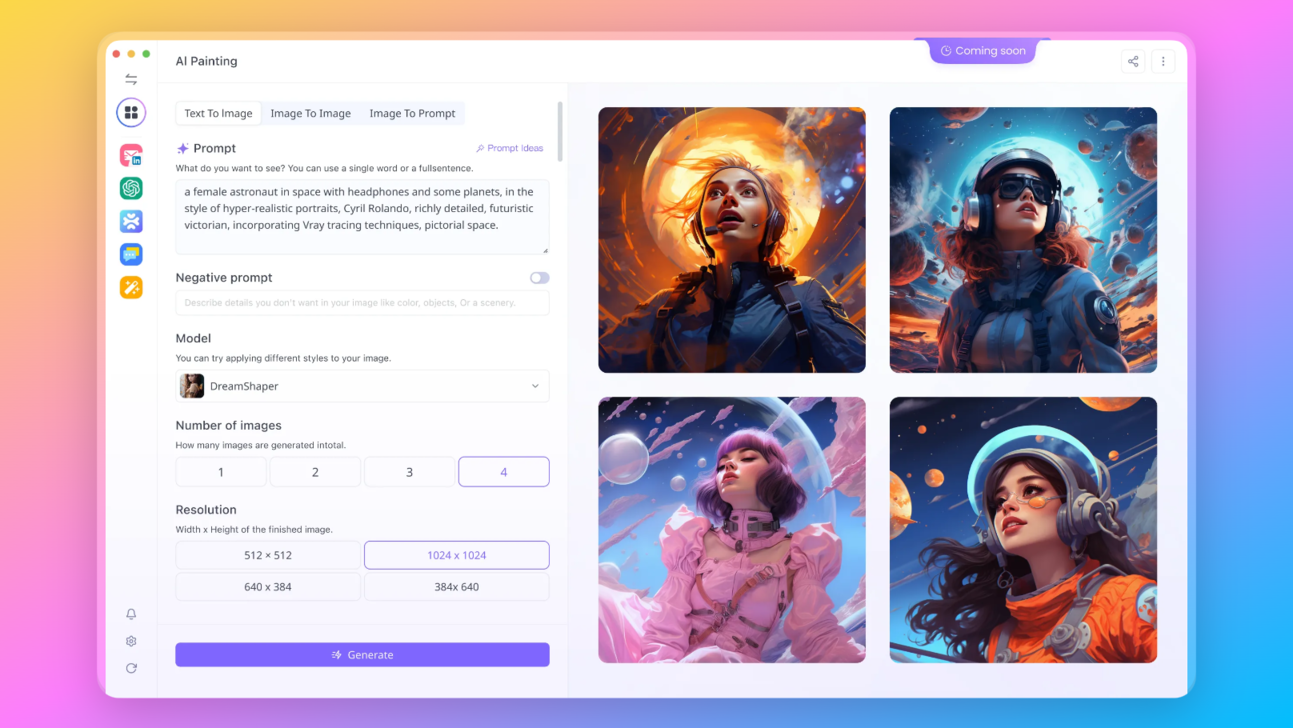

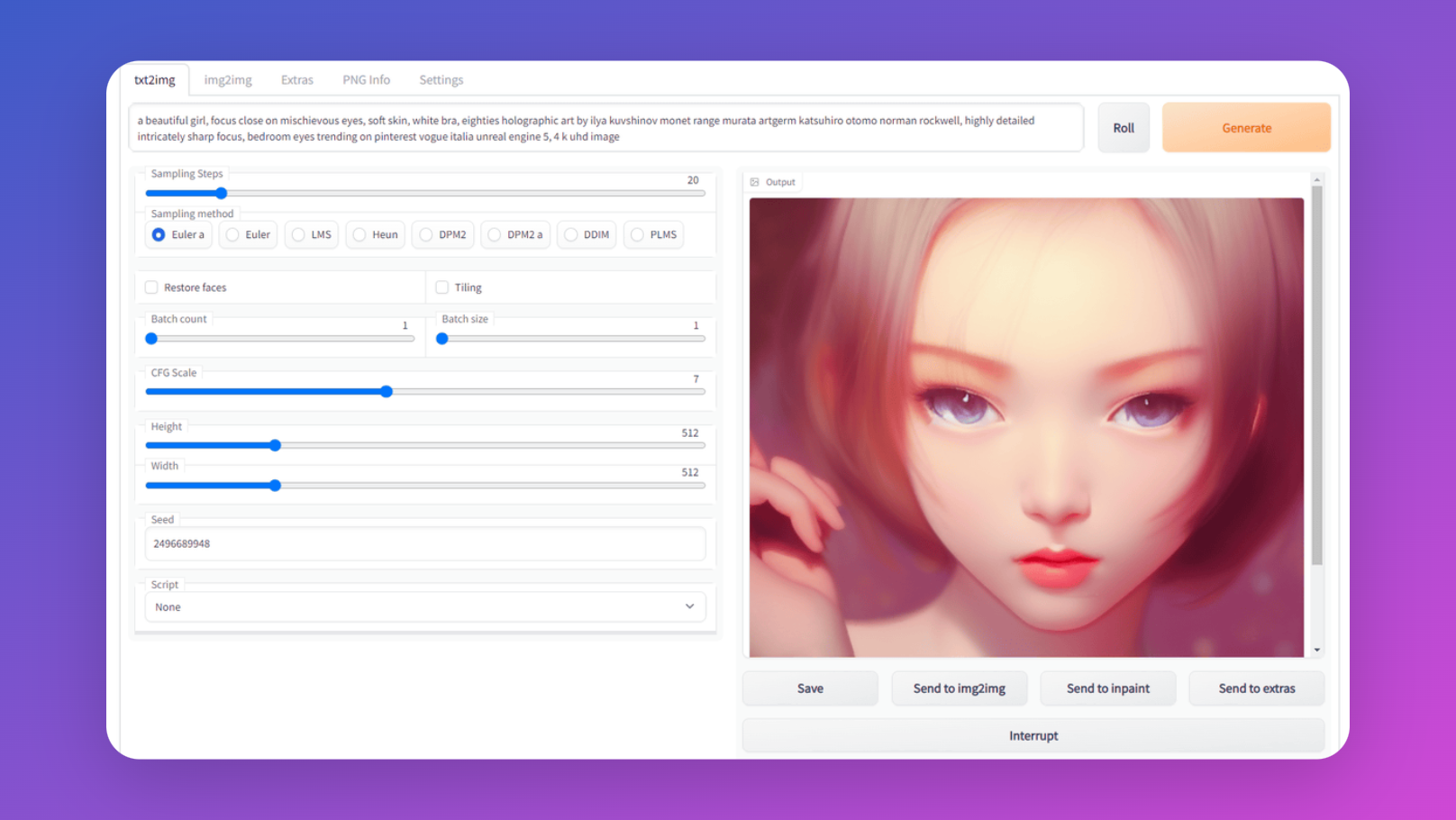

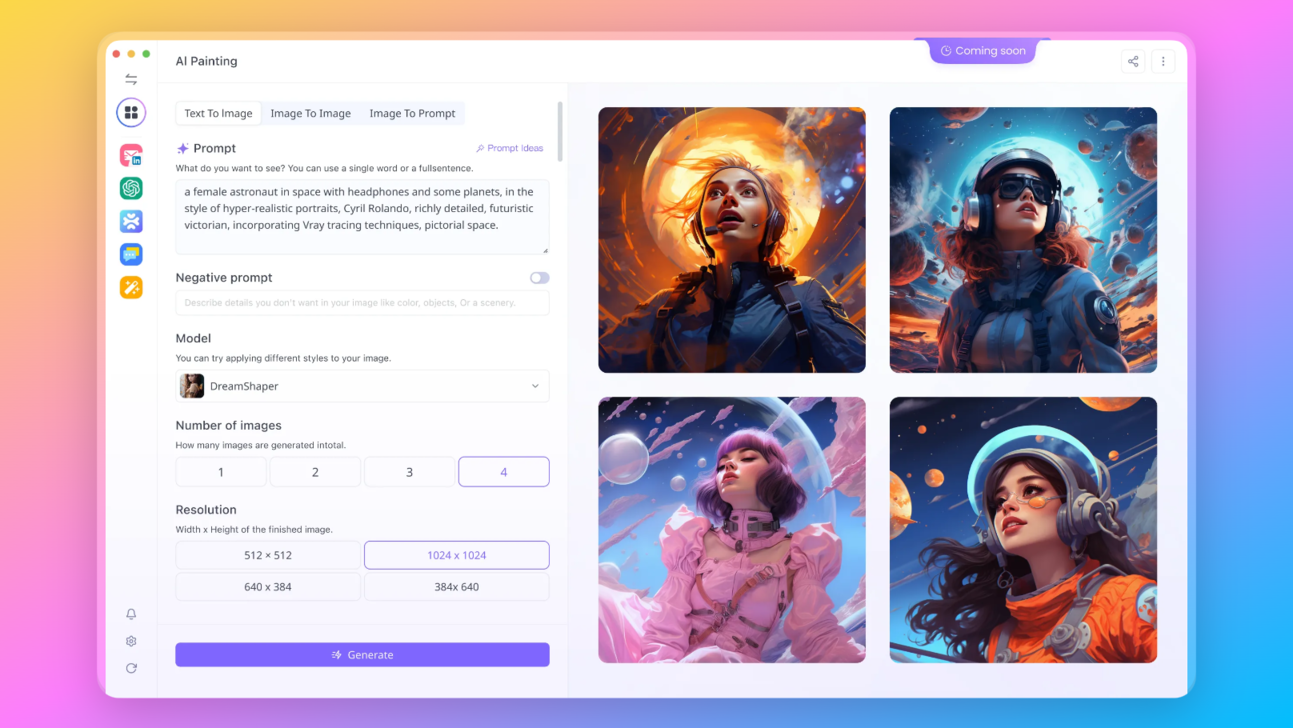

Vergessen Sie nicht, dass Sie jetzt mit dem Stable Diffusion Online Generator beeindruckende Bilder generieren können!

Die Geschichte der generativen KI

Generative KI hat seit ihrer Entstehung große Fortschritte gemacht. Frühe Entwicklungen generativer Modelle waren in ihrer Fähigkeit, hochwertige Bilder zu generieren, eingeschränkt. Fortschritte im Bereich des Deep Learning und der Rechenleistung haben jedoch zu immer ausgefeilteren Modellen geführt, die unglaublich realistische Bilder, Videos und Texte generieren können.

Explosion generativer KI-Text-zu-Bild-Modelle

Eine der bedeutenden Durchbrüche in der generativen KI war die Entwicklung von Text-zu-Bild-Modellen. Diese Modelle können Bilder auf der Grundlage von textuellen Beschreibungen generieren und ermöglichen eine direkte Übersetzung von Text in visuelle Darstellungen. Diese Innovation hat einen tiefgreifenden Einfluss auf die kreativen Branchen wie Werbung, Gaming und digitale Kunst.

Bildgenerierungsmodelle: Ein Vergleich

Frühe Bildgenerierungsmodelle hatten mit mehreren technischen Herausforderungen zu kämpfen, wie Modecollapse, Mangel an Vielfalt und Schwierigkeiten beim Training. Forscher und Entwickler haben unermüdlich daran gearbeitet, diese Einschränkungen zu überwinden, was zu verbesserten Modellen und Techniken geführt hat, die hochwertige und diverse Bilder generieren können.

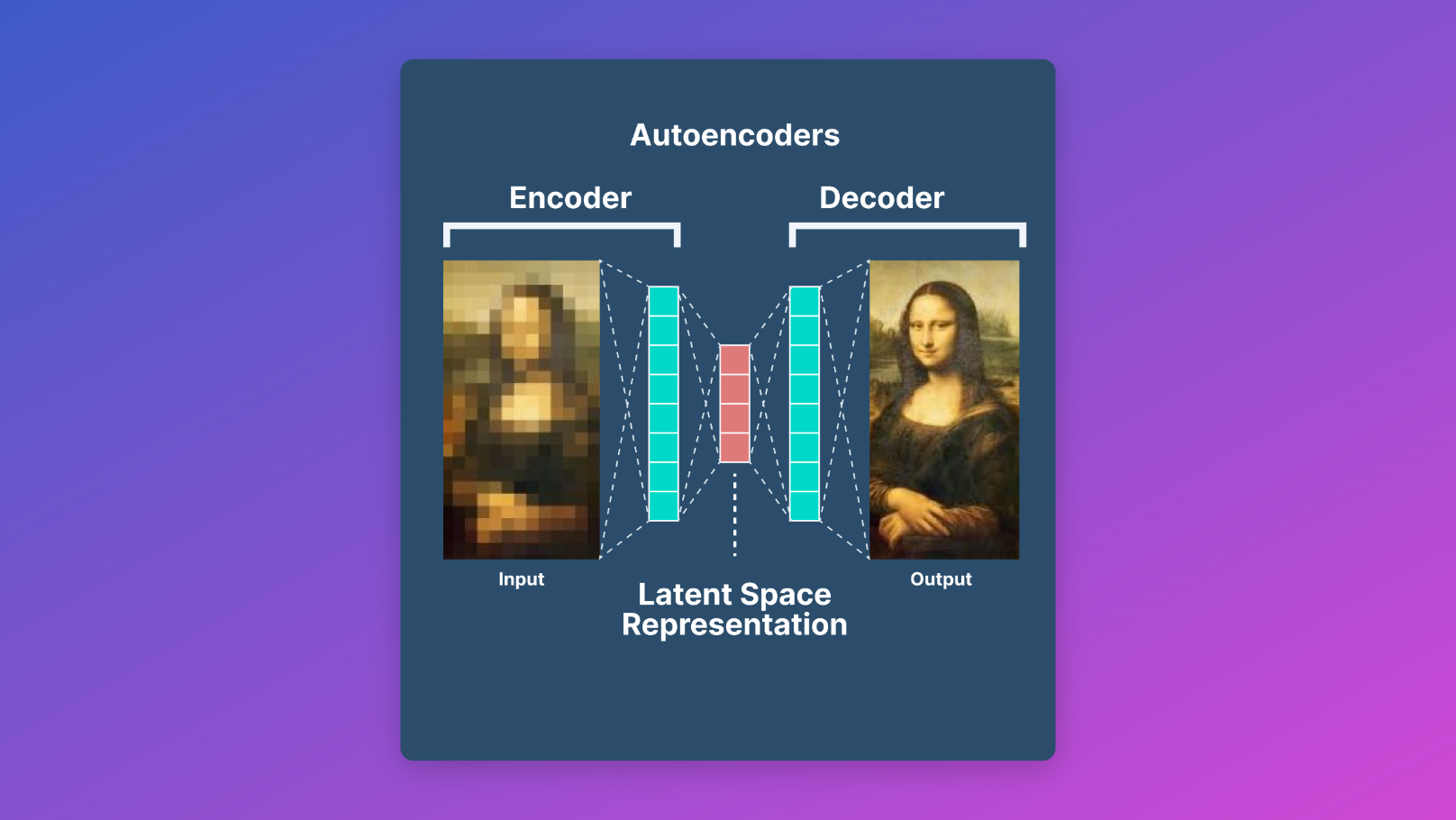

Autoencoder

Autoencoder sind eine Klasse von generativen Modellen, die das Codieren und Decodieren von Daten lernen. Sie werden häufig bei der Bildgenerierung eingesetzt und haben zur Weiterentwicklung des Bereichs der generativen KI beigetragen. Autoencoder haben ihre Stärken, aber auch einige Einschränkungen im Vergleich zu anderen generativen Modellen.

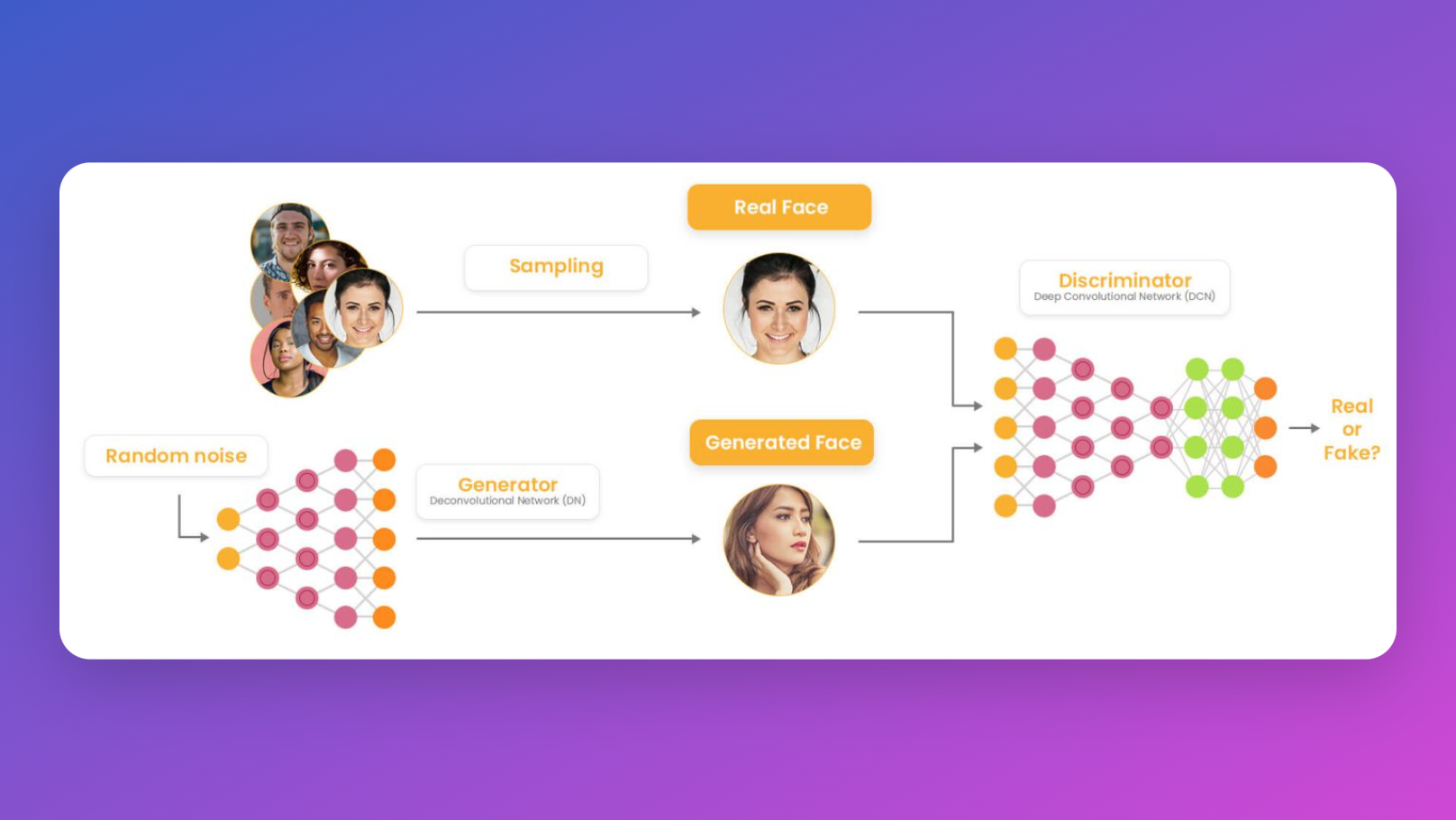

GANs (Generative Adversarial Networks)

GANs sind wahrscheinlich die bekanntesten und am weitesten verbreiteten generativen Modelle im Bereich der Computervision. Sie bestehen aus zwei Hauptkomponenten: einem Generator und einem Diskriminator. Der Generator versucht, realistische Bilder zu generieren, während der Diskriminator versucht, zwischen echten und generierten Bildern zu unterscheiden. GANs haben sich als sehr erfolgreich bei der Generierung hochwertiger Bilder erwiesen, haben jedoch ihre eigenen Einschränkungen.

Diffusionsmodelle

Diffusionsmodelle sind relativ neue Modelle im Bereich der generativen KI, haben aber durch ihren einzigartigen Ansatz Aufmerksamkeit erregt. Im Gegensatz zu GANs generieren Diffusionsmodelle Bilder, indem sie iterativ eine zufällige Rauscheingabe verfeinern. Dieser iterative Prozess ermöglicht die Erzeugung hochwertiger Bilder mit beeindruckenden Details und Realismus.

Stable Diffusion vs GAN: Ein detaillierter Vergleich

Jetzt werfen wir einen detaillierten Vergleich zwischen Stable Diffusion und GANs und zeigen die Stärken und Schwächen jedes Modells auf. Diese Analyse wird Ihnen helfen zu verstehen, welches Modell am besten für Ihre spezifischen Anforderungen an die Bildgenerierung geeignet ist.

Training und Rechenanforderungen

- GANs: Historisch gesehen waren GANs für die Bildgenerierung bevorzugt, aber sie sind schwer zu trainieren. Es ist komplex, ein stabiles Gleichgewicht zwischen Generator und Diskriminator zu erreichen, und sie neigen zu Modecollapse, bei dem der Generator keine vielfältigen Ausgaben erzeugt.

- Diffusionsmodelle: Im Vergleich zu GANs sind Diffusionsmodelle wie Stable Diffusion einfacher zu trainieren. Der Denoisierungsprozess ist zuverlässig und ermöglicht die Generierung von Rauschen durch einen iterativen Verfeinerungsprozess. Allerdings sind sie rechenintensiver als GANs, insbesondere bei direkten Diffusionsprozessen für hochauflösende Bilder. Latente Diffusionsmodelle, die im latenten Raum eines Variational Autoencoders (VAE) arbeiten, adressieren einige dieser Rechenherausforderungen.

- Transformer: Obwohl oft mit der Textgenerierung assoziiert, können Transformer auch auf Bildmodelle angewendet werden. Sie stellen eine architektonische Wahl dar, die sich von der Wahl des generativen Prozesses in Diffusions- oder GAN-Modellen unterscheidet.

Spezifische Anwendungsfälle

- Kreative Varianz: Diffusionsmodelle eignen sich ideal zur Erzeugung kreativer Bilder mit signifikanter Varianz und bieten eine reiche Palette für künstlerische und innovative Ergebnisse.

- Realistische Zeitraffer-Bilder: Zur Erzeugung von Zeitraffer-Bildern, wie zum Beispiel das Wachstum einer Pflanze, eignen sich sowohl Diffusionsmodelle als auch GANs. Der Diffusionsprozess kann so angepasst werden, dass er von einem Zeitschritt zum nächsten das Rauschen reduziert und so das allmähliche Wachstum erfasst. GANs könnten ebenfalls formuliert werden, um jeden Zeitschritt vom vorherigen zu generieren, allerdings würde dies möglicherweise eine sorgfältigere Abstimmung erfordern, um die Konsistenz im Hintergrund zu gewährleisten.

Modellauswahl und Qualität des Datensatzes

- Es ist wichtig zu beachten, dass die Wahl des Modelltyps (Diffusion, GANs, autoregressive Transformers) oft mehr von der Qualität und Größe des Datensatzes abhängt als von den inhärenten Eigenschaften der Modelle selbst.

- Jedes Modell hat seine Stärken, aber die endgültige Output-Qualität wird stark von den Eingabedaten beeinflusst. Daher sollte bei der Auswahl eines Modells auch die Verfügbarkeit und Qualität der Trainingsdaten berücksichtigt werden.

Überbrückung der Kluft zwischen Modellen

- Aktuelle Forschungen untersuchen Möglichkeiten, die Kluft zwischen autoregressiven und Diffusionsmodellen zu überbrücken, indem beide als Instanzen von zeitabhängigen Rauschunterdrückungsprozessen betrachtet werden. Diese Forschungen zeigen potenzielle zukünftige Entwicklungen, bei denen die jeweiligen Vorteile jedes Modelltyps kombiniert oder in hybriden Ansätzen genutzt werden könnten.

Vor- und Nachteile von Stable Diffusion

Stärken von Stable Diffusion:

Stable Diffusion bietet mehrere Vorteile gegenüber GANs, darunter:

- Stabiles Training: Stable Diffusion-Modelle lassen sich im Vergleich zu GANs leichter trainieren, was sie für eine breitere Palette von Benutzern zugänglicher macht.

- Konsistente Output-Qualität: Stable Diffusion erzeugt konsistent hochwertige Bilder ohne das Risiko eines Modekollapses, einem häufigen Problem bei GANs.

- Bessere Bewältigung komplexer Bildgenerierungsaufgaben: Diffusionsmodelle haben gezeigt, dass sie bessere Leistungen bei der Erzeugung von Bildern mit komplexen Texturen, feinen Details und scharfen Kanten erbringen.

- Verbesserte Stabilität während des Trainings: Stable Diffusion-Modelle zeigen eine bessere Trainingsstabilität und Konvergenzeigenschaften, was die Wahrscheinlichkeit von Trainingsfehlern verringert.

Nachteile von Stable Diffusion:

Auch wenn Stable Diffusion seine Stärken hat, gibt es auch einige Einschränkungen:

- Längere Inferenzzeit: Das Generieren von Bildern mit Stable Diffusion dauert im Vergleich zu GANs länger, da mehrere Iterationen erforderlich sind, um die anfängliche Rausch-Eingabe zu verbessern.

- Höhere Rechenanforderungen: Stable Diffusion-Modelle erfordern während des Trainings und der Inferenz mehr Rechenressourcen im Vergleich zu GANs.

- Eingeschränkte Anwendungen: Stable Diffusion-Modelle sind derzeit für Bildgenerierungsaufgaben besser geeignet und möglicherweise nicht so vielseitig wie GANs für andere Anwendungen wie Bild-zu-Bild-Übersetzung.

Anwendungsfälle und Leistungsanalyse

Um die Leistung von Stable Diffusion und GANs im realen Einsatz zu verstehen, ist es wichtig, ihre Anwendungsfälle zu erkunden und ihre Leistung in verschiedenen Szenarien zu bewerten. Diese Analyse liefert Erkenntnisse darüber, welches Modell besser für bestimmte Bildgenerierungsaufgaben wie die Erzeugung von Landschaften, Portraits oder abstrakter Kunst geeignet ist.

Die Zukunft der generativen KI: Stable Diffusion oder GAN?

Generative Modelle, einschließlich GANs und Diffusionsmodelle, entwickeln sich weiter und verbessern sich. Die Zukunft der generativen KI birgt spannende Möglichkeiten, wie stabilere und effizientere Trainingsalgorithmen, bessere Bewältigung komplexer Bildgenerierungsaufgaben und verbesserte Skalierbarkeit. Allerdings ist es angesichts der wachsenden Macht der generativen KI entscheidend, die ethischen Aspekte und potenziellen Risiken ihres Einsatzes anzusprechen.

Schlussfolgerung

Zusammenfassend lässt sich sagen, dass der Kampf zwischen GANs und Stable Diffusion das Feld der generativen KI weiterhin prägt. Während GANs lange Zeit die Vorherrschaft hatten, zeigt Stable Diffusion großes Potenzial als stabilere und zuverlässigere Alternative. Mit dem Stable Diffusion Image Generator von Anakin AI können Sie die Kraft von Stable Diffusion entfesseln und mühelos atemberaubende Bilder erstellen. Ob Sie sich für GANs oder Stable Diffusion entscheiden, die Zukunft der generativen KI birgt ein enormes Potenzial für die Transformation kreativer Branchen und die Auswirkungen auf verschiedene andere Bereiche. Starten Sie noch heute Ihre Reise in die Welt der generativen KI und entdecken Sie endlose Möglichkeiten.

Noch eine Sache:

Probieren Sie Anakin AI's Stable Diffusion Image Generator noch heute aus und entfesseln Sie die Kraft der generativen KI auf Ihren Fingerspitzen!

Erzeugen Sie mit Leichtigkeit atemberaubende Bilder mithilfe modernster Diffusionsmodelltechnologie. Starten Sie jetzt mit Anakin AI's Stable Diffusion Image Generator und verwirklichen Sie Ihre kreativen Ideen!