Stable Diffusion, das Open-Source-Modell zur Text-zu-Bild-Erzeugung, hat seit seiner ersten Veröffentlichung die Welt im Sturm erobert. Entwickelt von Stability AI, ermöglicht dieses leistungsstarke Tool den Zugang zu fortgeschrittenen Bildgenerierungsfähigkeiten und ermöglicht es Benutzern, atemberaubende visuelle Darstellungen aus textuellen Beschreibungen zu erzeugen. Jetzt, mit der Einführung von Stable Diffusion 3 Medium, hat das Team von Stability AI die Grenzen noch weiter ausgedehnt und bietet eine außergewöhnliche Leistung und Qualität in einem kompakteren und zugänglicheren Paket.

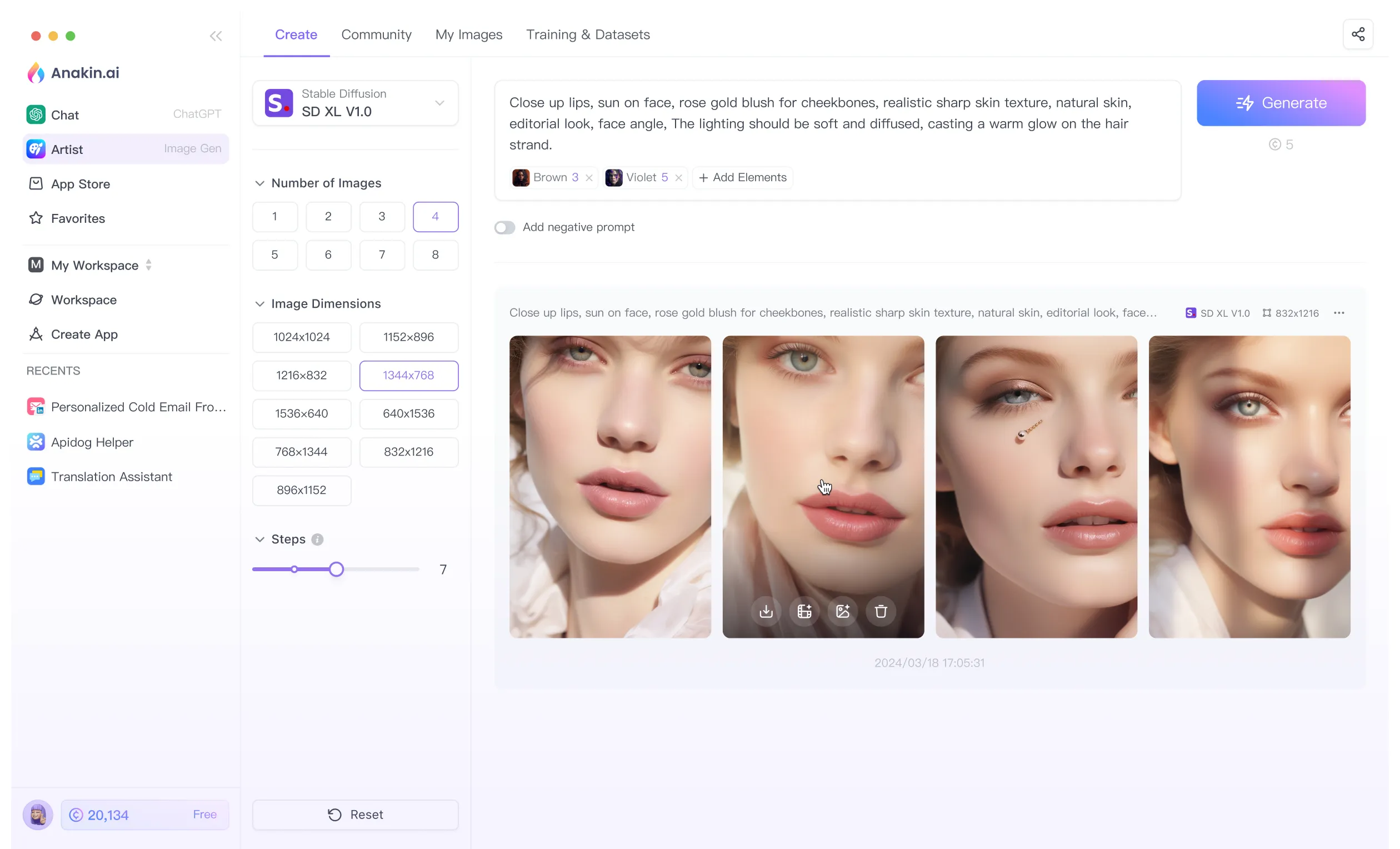

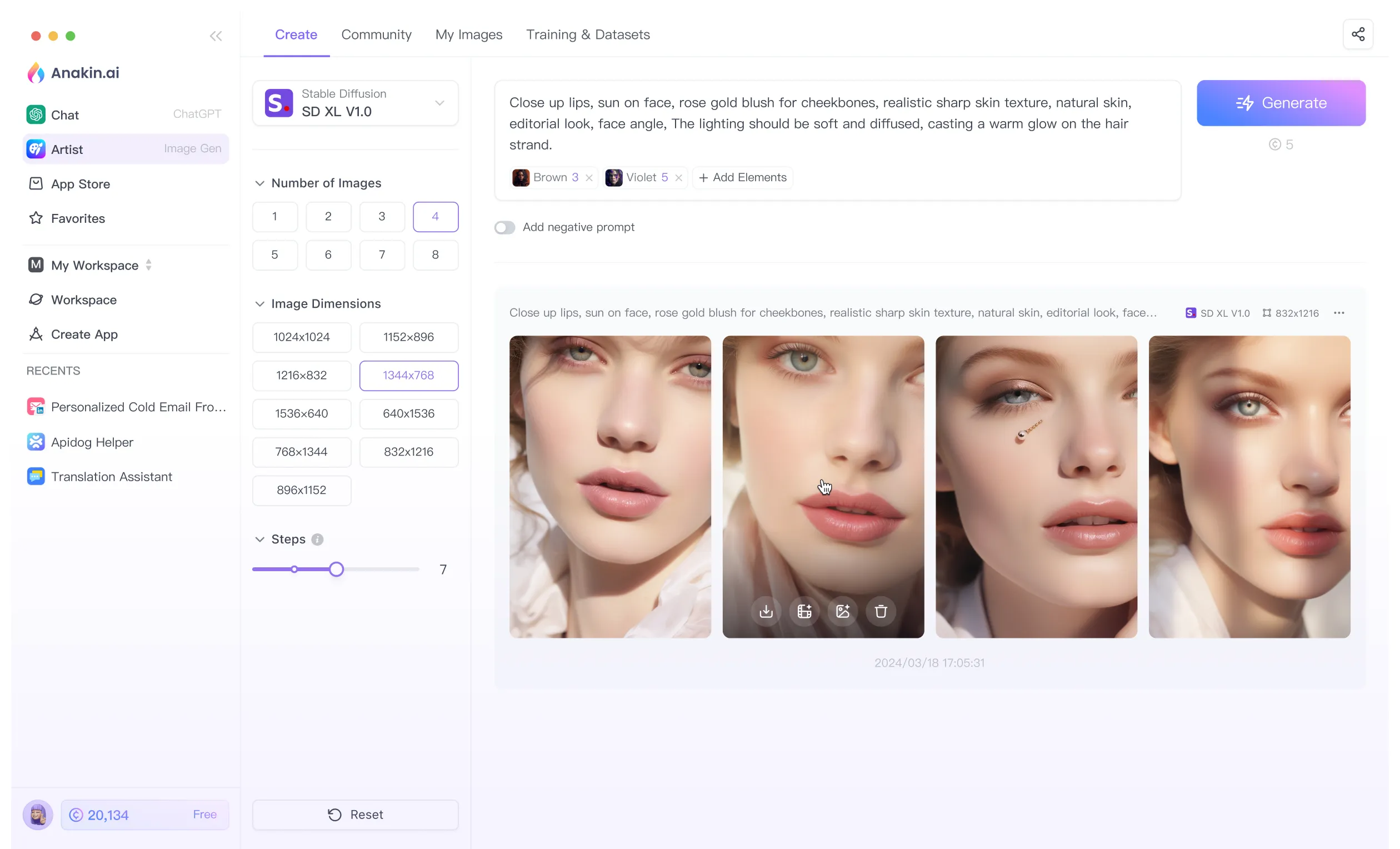

Anakin AI bietet derzeit KOSTENLOSE Zugriff auf einige der Stable Diffusion Modelle an!

Lassen Sie Ihrer Kreativität bei Anakin AI mit kostenlosem Stable Diffusion-Zugang freien Lauf!

Stable Diffusion 3 Medium: Ein kleineres, aber viel besseres Modell

Einer der wichtigsten Aspekte von Stable Diffusion 3 Medium ist seine reduzierte Größe im Vergleich zu seinem größeren Pendant, Stable Diffusion 3 Large. Während SD3 Large mit beeindruckenden 8 Milliarden Parametern aufwartet, schafft es SD3 Medium mit nur 2 Milliarden Parametern ebenfalls große Ergebnisse zu erzielen. Diese Größenreduktion hat wichtige Auswirkungen für Benutzer, da sie das Modell ermöglicht, effizient auf handelsüblicher Hardware ohne Einschränkung der Qualität ausgeführt zu werden.

Die Möglichkeit, qualitativ hochwertige Bilder auf standardmäßigen Verbraucher-Grafikkarten zu generieren, ist eine echte Innovation für viele Benutzer. Mit einem Mindestbedarf von nur 5 GB GPU-VRAM eröffnet SD3 Medium eine breitere Palette fortschrittlicher Bildgenerierungsmöglichkeiten für ein größeres Publikum. Egal, ob Sie Künstler, Designer oder einfach nur begeisterter Kreativer sind - Sie können jetzt die Leistungsfähigkeit von Stable Diffusion nutzen, ohne teure spezialisierte Hardware zu benötigen.

| GPU-Modell | VRAM | SD3 Medium Leistung |

|---|---|---|

| NVIDIA RTX 3060 | 12 GB | 2,35 s/Bild (8 Bilder) |

| NVIDIA RTX 3090 | 24 GB | 3,15 s/Bild (8 Bilder) |

| AMD Radeon RX 7900 XTX | 24 GB | 21 it/s |

Stable Diffusion 3 Medium vs DALLE 3: Fotorealistischere, bessere Typografie

Eines der herausragendsten Merkmale von Stable Diffusion 3 Medium (im Vergleich zu Konkurrenten wie DALLE 3) ist seine Fähigkeit zur Erzeugung von fotorealistischen Bildern mit beispielloser Genauigkeit. Das Modell wurde daraufhin optimiert, feinste Details und Texturen zu erfassen, was zu visuellen Darstellungen führt, die realen Fotografien ähneln. Diese fotorealistische Qualität ist besonders beeindruckend angesichts der reduzierten Größe des Modells.

Neben seinen fotorealistischen Fähigkeiten glänzt SD3 Medium auch in der Typografiegenerierung. Das Modell wurde darauf trainiert, Text mit außergewöhnlicher Klarheit und Genauigkeit zu verstehen und darzustellen.Ob Sie Bilder mit eingeblendeten Texten erstellen oder eigenständige Typografien generieren - SD3 Medium liefert Ergebnisse, die klar, lesbar und visuell ansprechend sind.

Einige Beispiele für Eingaben, die die fotorealistische Qualität und die Typografiefähigkeiten von SD3 Medium zeigen:

- "Ein eindrucksvolles 1950er-Jahre-Diner mit Neonlichtern und klassischen Autos, die draußen parken"

- "Eine futuristische Stadtszene mit hoch aufragenden Wolkenkratzern, fliegenden Autos und holografischen Werbeanzeigen"

- "Ein antiker ägyptischer Tempel mit Hieroglyphen, imposanten Statuen und einem geheimnisvollen Sarkophag"

Stable Diffusion 3 Medium Eingaben: Alles wird besser und einfacher

Ein weiterer Bereich, in dem Stable Diffusion 3 Medium glänzt, ist seine Fähigkeit, komplexe Eingaben zu verstehen und zu interpretieren.

- Das Modell wurde entwickelt, um die Feinheiten natürlicher Sprache zu erfassen, sodass Benutzer detaillierte Beschreibungen von Szenen, Objekten und Kompositionen liefern können. SD3 Medium kann diese Eingaben analysieren und Bilder erzeugen, die den Absichten des Benutzers genau entsprechen.

- Darüber hinaus verfügt das Modell über ein tiefes Verständnis für räumliche Beziehungen und Kompositionselemente. Es kann Objekte effektiv innerhalb eines Bildes positionieren, basierend auf der bereitgestellten Eingabe und unter Berücksichtigung von Faktoren wie Größe, Platzierung und Interaktion zwischen den Elementen.

- Dieses Maß an räumlichem Bewusstsein ermöglicht es Benutzern, visuell zusammenhängende und gut komponierte Bilder mühelos zu erstellen.

Einige Beispiele, die das komplexe Verständnis der Eingaben von SD3 Medium und die Beziehungen darin verdeutlichen:

- "Ein majestätischer Drache, der über eine nebelige Bergkette bei Sonnenuntergang schwebt"

- "Eine gemütliche Hütte im Wald, umgeben von hohen Kiefern und einem plätschernden Bach"

- "Ein magischer Wald, voll von biolumineszenten Pflanzen, leuchtenden Pilzen und verzauberten Kreaturen"

Ressourceneffizienz und Feinabstimmungsmöglichkeiten

Die kompakte Größe von Stable Diffusion 3 Medium macht es nicht nur für eine breitere Benutzerbasis zugänglich, sondern trägt auch zu seiner Ressourceneffizienz bei. Der reduzierte Speicherbedarf des Modells ermöglicht eine reibungslose Ausführung auf handelsüblichen Verbraucher-GPUs und minimiert den Bedarf an High-End-Hardware. Diese Effizienz ist besonders vorteilhaft für Benutzer, die eine größere Anzahl von Bildern in kurzer Zeit generieren möchten oder mit begrenzten Rechenressourcen arbeiten.

Darüber hinaus bietet SD3 Medium hervorragende Feinabstimmungsmöglichkeiten. Das Modell kann detaillierte Informationen aus kleinen Datensätzen aufnehmen, was Benutzern die Anpassung und Anpassung an spezifische Anforderungen ermöglicht. Ob Sie an einem bestimmten Kunststil, einem spezifischen Bereich oder einem einzigartigen Satz visueller Elemente arbeiten - die Feinabstimmungsmöglichkeiten von SD3 Medium ermöglichen es Ihnen, das Modell an Ihre Anforderungen anzupassen, was zu einer personalisierteren und zielgerichteten Bildgenerierung führt.

Wie man die Stable Diffusion 3 API verwendet

Keine Sorge! Anakin AI ist Ihre All-in-One-KI-Aggregator-Plattform, auf der Sie leicht auf alle LLM- und Bildgenerierungsmodelle an einem Ort zugreifen können!

Beginnen Sie jetzt mit der API-Integration von Anakin AIAPI Integration Now!

Die Verwendung der Stable Diffusion 3 API ist ein unkomplizierter Vorgang. Hier finden Sie eine Schritt-für-Schritt-Anleitung, wie Sie beginnen können:

Schritt 1: Melden Sie sich für einen API-Schlüssel an

Um Zugriff auf die Stable Diffusion 3 API zu erhalten, müssen Sie sich für einen API-Schlüssel anmelden. Besuchen Sie die Website von Stability AI und erstellen Sie ein Konto. Sobald Sie ein Konto haben, gehen Sie zum Abschnitt API-Schlüssel und generieren Sie einen neuen API-Schlüssel.

Schritt 2: Installieren Sie die erforderlichen Bibliotheken

Um mit der Stable Diffusion 3 API zu interagieren, müssen Sie einige Bibliotheken installieren. Sie können sie mit pip installieren:

pip install requests pillow

Schritt 3: Tätigen Sie API-Anfragen

Jetzt, da Sie Ihren API-Schlüssel und die erforderlichen Bibliotheken haben, können Sie API-Anfragen stellen, um Bilder zu generieren. Hier ist ein Beispielcode in Python:

import requests

from PIL import Image

from io import BytesIO

api_key = "IHR_API_SCHLÜSSEL"

url = "https://api.stability.ai/v1/generation/stable-diffusion-v3/text-to-image"

prompt = "Ein wunderschöner Sonnenuntergang über einem ruhigen Strand"

payload = {

"text_prompts": [

{

"text": prompt

}

],

"cfg_scale": 7,

"clip_guidance_preset": "FAST_BLUE",

"height": 512,

"width": 512,

"samples": 1,

"steps": 30,

}

headers = {

"Content-Type": "application/json",

"Accept": "application/json",

"Authorization": f"Bearer {api_key}"

}

response = requests.post(url, json=payload, headers=headers)

if response.status_code == 200:

data = response.json()

for i, image_data in enumerate(data["artifacts"]):

image_url = image_data["base64"]

image = Image.open(BytesIO(requests.get(image_url).content))

image.save(f"generated_image_{i}.png")

else:

print(f"Anfrage fehlgeschlagen mit Statuscode {response.status_code}")

In diesem Beispiel definieren wir die URL des API-Endpunkts und die Eingabe, um das Bild zu generieren. Wir setzen dann die gewünschten Parameter wie Bildgröße, Anzahl der Proben und die Anzahl der Schritte für den Diffusionsprozess.

Wir erstellen eine Nutzlast, die die Eingabe und die Parameter enthält, und setzen die Header mit dem API-Schlüssel und dem Inhalts-Typ. Schließlich stellen wir eine POST-Anfrage an den API-Endpunkt mit der Nutzlast und den Headern.

Wenn die Anfrage erfolgreich ist (Statuscode 200), rufen wir die generierten Bilddaten aus der Antwort ab und speichern sie als PNG-Datei. Wenn die Anfrage fehlschlägt, geben wir den Statuscode zu Debugging-Zwecken aus.

Schritt 4: Anpassen und experimentieren

Passen Sie den Code nach Belieben an und experimentieren Sie mit verschiedenen Eingaben und Parametern, um verschiedene Arten von Bildern zu generieren. Sie können die cfg_scale anpassen, um die Anpassung des Bildes an die Eingabe zu steuern, die clip_guidance_preset ändern, um den Stil zu beeinflussen, und die height und width anpassen, um Bilder verschiedener Größen zu generieren.

Die Stable Diffusion 3 API bietet eine Vielzahl von Möglichkeiten zur Generierung kreativer und einzigartiger Bilder. Erkunden Sie die API-Dokumentation, um mehr über die verfügbaren Parameter und Optionen zu erfahren.

Vergessen Sie nicht, Ihren API-Schlüssel sicher zu behandeln und ihn nicht öffentlich zu teilen. Mit diesen Schritten sind Sie bereit, die Stable Diffusion 3 API zu nutzen, um atemberaubende Bilder aus textuellen Anweisungen zu generieren!

Ja, Stable Diffusion 3 Medium ist Open Source und kostenlos

Stability AI hat Stable Diffusion 3 Medium über verschiedene Kanäle zugänglich gemacht:

- Benutzer können das Modell über die Stability API testen und nahtlos in bestehende Workflows und Anwendungen integrieren.

- Die Modellgewichte stehen unter einer offenen, nicht-kommerziellen Lizenz zur Verfügung, was es Forschern und Enthusiasten ermöglicht, die Technologie zu erforschen und damit zu experimentieren.

- Für den kommerziellen Einsatz bietet Stability AI eine Creator License und eine Enterprise License an. Diese Lizenzoptionen bieten die erforderlichen Berechtigungen und Unterstützung für Einzelpersonen und Unternehmen, die SD3 Medium in ihren Projekten und Produkten nutzen möchten.

Indem flexible Lizenzierungsoptionen angeboten werden, stellt Stability AI sicher, dass die Vorteile dieser leistungsstarken Technologie von einer breiten Benutzerbasis genutzt werden können. Das Modell können Sie hier herunterladen.

Schlussfolgerung

Stable Diffusion 3 Medium stellt einen bedeutenden Meilenstein in der Entwicklung von Text-zu-Bild-Erzeugungsmodellen dar. Durch außergewöhnliche Leistung und Qualität in einem kompakteren und zugänglicheren Paket ermöglicht SD3 Medium Benutzern, beeindruckende visuelle Inhalte ohne die Notwendigkeit spezialisierter Hardware zu erstellen. Seine Fähigkeit, fotorealistische Bilder zu erzeugen, komplexe Eingaben zu verarbeiten und räumliche Beziehungen zu verstehen, macht es zu einem vielseitigen und leistungsstarken Werkzeug für Kreative und Enthusiasten.

Während Stability AI die Grenzen der generativen KI weiter vorantreibt, unterstreicht Stable Diffusion 3 Medium ihr Engagement, den Zugang zu fortgeschrittenen Bildgenerierungsfähigkeiten für alle zu demokratisieren. Mit seiner Ressourceneffizienz, den Feinabstimmungsmöglichkeiten und den flexiblen Lizenzierungsoptionen steht SD3 Medium kurz davor, die Art und Weise, wie wir visuelle Inhalte erstellen und nutzen, zu revolutionieren. Egal, ob Sie Künstler, Designer, Forscher oder einfach jemand mit einer Leidenschaft für Kreativität sind - Stable Diffusion 3 Medium eröffnet Ihnen eine Welt voller Möglichkeiten und ermöglicht es Ihnen, Ihrer Vorstellungskraft wie nie zuvor Leben einzuhauchen.

Anakin AI bietet derzeit KOSTENLOSE Zugriff auf einige Stable Diffusion Modelle an!

Lassen Sie Ihrer Kreativität bei Anakin AI mit kostenlosem Stable Diffusion-Zugang freien Lauf!