Hai mai sognato di creare video straordinari generati dall'IA, ma ti sei sentito limitato da strumenti costosi e proprietari come Sora di OpenAI? Non sei solo. La recente uscita di Open-Sora, un modello di generazione video IA open-source sviluppato da HPC-AI Tech (il team di Colossal-AI), ha suscitato onde di entusiasmo nelle comunità creative e tecnologiche. Offrendo capacità potenti paragonabili alle alternative commerciali, Open-Sora sta rapidamente diventando la soluzione ideale per la creazione di video di alta qualità IA accessibili.

In questo articolo, approfondiremo cosa rende Open-Sora uno strumento così innovativo, esploreremo la sua evoluzione, le caratteristiche tecniche, i benchmark delle prestazioni e come si confronta con Sora di OpenAI. Sia che tu sia un creatore di contenuti, uno sviluppatore o semplicemente un appassionato di IA, troverai molte ragioni per essere entusiasta di Open-Sora.

Pronto a esplorare altri strumenti IA video innovativi? Scopri i potenti modelli di generazione video di Anakin IA come Minimax Video, Tencent Hunyuan e Runway ML — tutti disponibili in un'unica piattaforma semplificata. Eleva i tuoi progetti creativi oggi stesso: Esplora Anakin AI Video Generator

L'Evoluzione di Open-Sora: Da Inizio Promettente a Sfida per l'Industria

Open-Sora non è diventato una sensazione dall'oggi al domani. È evoluto significativamente dalla sua uscita iniziale, migliorando costantemente le sue capacità e prestazioni:

Storia delle Versioni a Colpo d'Occhio:

- Open-Sora 1.0: Rilascio iniziale, processo di addestramento e architettura del modello completamente open-source.

- Open-Sora 1.1: Introdotta la generazione video multi-risoluzione, multi-lunghezza e multi-rapporto d'aspetto, insieme a condizionamento e modifica di immagini/video.

- Open-Sora 1.2: Aggiunta di flusso rettificato, 3D-VAE e miglioramento delle metriche di valutazione.

- Open-Sora 1.3: Implementazione di attenzione a finestra mobile e VAE spaziale-temporale unificato, scalando fino a 1,1 miliardi di parametri.

- Open-Sora 2.0: L'ultima e più avanzata versione, con 11 miliardi di parametri e quasi paragonabile ai modelli proprietari come Sora di OpenAI.

Ogni iterazione ha avvicinato Open-Sora alla parità con i modelli commerciali leader del settore, democratizzando l'accesso alla potente tecnologia di generazione video IA.

Sotto il Coibent: Architettura Tecnica e Caratteristiche Fondamentali

Cosa rende esattamente Open-Sora 2.0 un'alternativa così convincente a Sora di OpenAI? Analizziamo la sua architettura innovativa e le potenti capacità:

Architettura del Modello Innovativa:

- Masked Motion Diffusion Transformer (MMDiT): Utilizza meccanismi avanzati di attenzione totale in 3D, migliorando significativamente la modellazione delle caratteristiche spaziotemporali.

- Spatio-Temporal Diffusion Transformer (ST-DiT-2): Supporta durate video diverse, risoluzioni, rapporti d'aspetto e frame rate, rendendolo altamente versatile.

- High-Compression Video Autoencoder (Video DC-AE): Riduce drasticamente il tempo di inferenza attraverso una compressione efficiente, consentendo generazioni video più rapide.

Capacità di Generazione Impressionanti:

Open-Sora 2.0 offre diversi metodi intuitivi di generazione video:

- Da Testo a Video: Crea video coinvolgenti direttamente da descrizioni testuali.

- Da Immagine a Video: Porta la vita a immagini statiche con movimento dinamico.

- Da Video a Video: Modifica senza sforzo contenuti video esistenti.

- Controllo dell'Intensità del Movimento: Regola l'intensità del movimento con un semplice parametro “Punteggio Movimento” (da 1 a 7).

Queste funzionalità consentono ai creatori di produrre contenuti altamente personalizzati e visivamente coinvolgenti con facilità.

Processo di Addestramento Efficiente: Alte Prestazioni a una Frazzione del Costo

Uno dei risultati notevoli di Open-Sora è la sua metodologia di addestramento economica. Sfruttando strategie innovative, il team di Open-Sora ha ridotto significativamente i costi di addestramento rispetto agli standard del settore:

Metodologia di Addestramento Intelligente:

- Formazione a Fasi Multiple: Inizia con frame a bassa risoluzione, affinando progressivamente per uscite ad alta risoluzione.

- Strategia di Priorità a Bassa Risoluzione: Prioritizza l'apprendimento delle caratteristiche del movimento prima, poi il miglioramento della qualità, risparmiando fino a 40 volte le risorse computazionali.

- Filtraggio Rigoroso dei Dati: Garantisce dati di addestramento di alta qualità, migliorando l'efficienza complessiva.

- Elaborazione Parallela: Utilizza ColossalAI per ottimizzare l'uso della GPU negli ambienti di addestramento distribuiti.

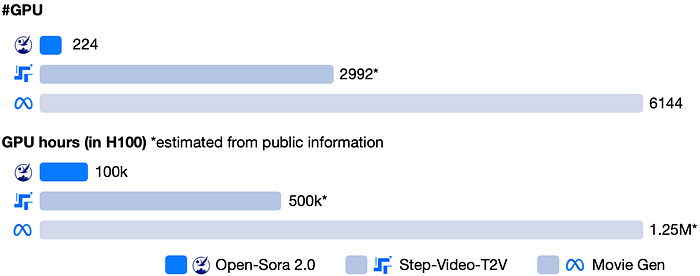

Remarkable Cost Efficiency:

- Open-Sora 2.0: Sviluppato a circa $200,000 (equivalente a 224 GPU).

- Step-Video-T2V: Stimato in 2992 GPU (500k ore GPU).

- Movie Gen: Richiede circa 6144 GPU (1.25M ore GPU).

Questo rappresenta una riduzione dei costi impressionante da 5 a 10 volte rispetto ai modelli di generazione video proprietari, rendendo Open-Sora accessibile a una gamma più ampia di utenti e sviluppatori.

Benchmark delle Prestazioni: Come Si Confronta Open-Sora?

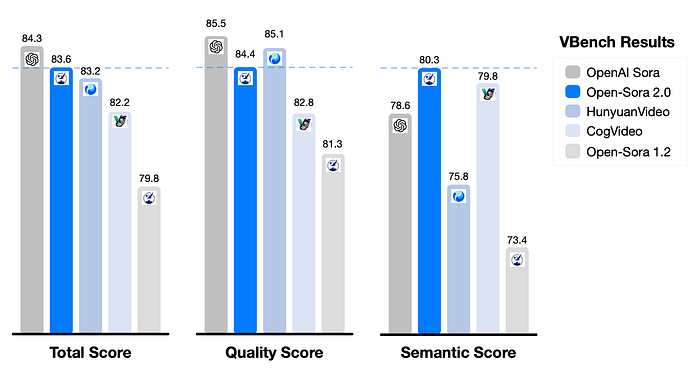

Quando si valutano i modelli IA, i benchmark delle prestazioni sono cruciali. Open-Sora 2.0 ha mostrato risultati impressionanti, quasi paragonabili a quelli di Sora di OpenAI in metriche chiave:

Risultati della Valutazione VBench:

- Punteggio Totale: Open-Sora 2.0 ha ottenuto 83.6, rispetto a 84.3 di OpenAI Sora.

- Punteggio Qualità: 84.4 (Open-Sora) vs. 85.5 (OpenAI Sora).

- Punteggio Semantico: 80.3 (Open-Sora) vs. 78.6 (OpenAI Sora).

Il divario di prestazioni tra Open-Sora e Sora di OpenAI si è notevolmente ridotto: dal 4,52% nelle versioni precedenti allo 0,69% odierno.

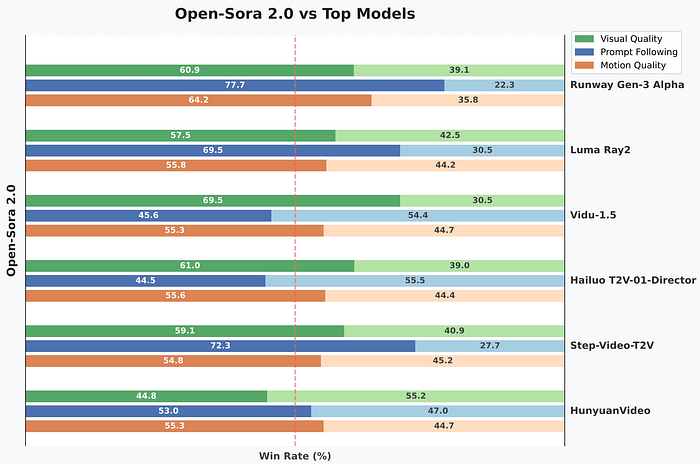

Tassi di Vittoria per Preferenza Utente:

In confronti diretti, Open-Sora 2.0 supera costantemente altri modelli leader:

- Qualità Visiva: 69.5% tasso di vittoria contro Vidu-1.5, 61.0% contro Hailuo T2V-01-Director.

- Seguimento del Prompt: 77.7% tasso di vittoria contro Runway Gen-3 Alpha, 72.3% contro Step-Video-T2V.

- Qualità del Movimento: 64.2% tasso di vittoria contro Runway Gen-3 Alpha, 55.8% contro Luma Ray2.

Questi risultati dimostrano chiaramente il vantaggio competitivo di Open-Sora, rendendolo un'alternativa praticabile a soluzioni costose e proprietarie.

Specifiche di Generazione Video: Cosa Puoi Aspettarti?

Open-Sora 2.0 offre robuste capacità di generazione video adatte a diverse esigenze creative:

Risoluzione e Lunghezza:

- Supporta più risoluzioni (256px, 768px) e rapporti d'aspetto (16:9, 9:16, 1:1, 2.39:1).

- Genera video di alta qualità (720p) fino a 16 secondi.

Frame Rate e Tempi di Elaborazione:

- Output costante a 24 FPS per una qualità cinematografica fluida.

- I tempi di elaborazione variano:

- Risoluzione 256×256: ~60 secondi su una singola GPU di fascia alta.

- Risoluzione 768×768: ~4.5 minuti con 8 GPU in parallelo.

- GPU RTX 3090: 30 secondi per un video di 2 secondi a 240p, 60 secondi per un video di 4 secondi.

Requisiti Hardware e Installazione: Iniziare

Per iniziare a utilizzare Open-Sora, dovrai soddisfare specifici requisiti hardware e software:

Requisiti di Sistema:

- Python: Versione 3.8 o superiore.

- PyTorch: Versione 2.1.0 o superiore.

- CUDA: Versione 11.7 o superiore.

Requisiti di Memoria della GPU:

- GPU Consumer (es., RTX 3090 con 24GB VRAM): Adatte per video brevi e a bassa risoluzione.

- GPU Professionali (es., RTX 6000 Ada con 48GB VRAM): Raccomandate per risoluzioni più alte e video più lunghi.

- GPU H100/H800: Ideali per la massima risoluzione e sequenze più lunghe.

Passaggi per l'Installazione:

- Clona il repository:

git clone https://github.com/hpcaitech/Open-Sora

- Configura l'ambiente Python:

conda create -n opensora python=3.8 -y

- Installa i pacchetti richiesti:

pip install -e .

- Scarica i pesi del modello dai repository di Hugging Face.

- Ottimizza l'uso della memoria con il flag

--save_memorydurante l'inferenza.

Limitazioni e Sviluppi Futuri: Cosa Aspettarsi da Open-Sora?

Nonostante le sue capacità impressionanti, Open-Sora 2.0 ha ancora alcune limitazioni:

- Lunghezza Video: Attualmente limitata a 16 secondi per uscite di alta qualità.

- Limiti di Risoluzione: Risoluzioni più elevate richiedono più GPU di fascia alta.

- Vincoli di Memoria: Le GPU consumer hanno capacità limitate.

Tuttavia, il team di Open-Sora sta lavorando attivamente a miglioramenti come l'interpolazione multi-frame e una migliore coerenza temporale, promettendo video generati dall'IA più lunghi e fluidi in futuro.

Considerazioni Finali: Democratizzare la Generazione di Video IA

Open-Sora 2.0 rappresenta un significativo passo avanti nella democratizzazione della tecnologia di generazione video IA. Con prestazioni quasi pari ai modelli proprietari come Sora di OpenAI — ma a una frazione del costo — Open-Sora consente a creatori, sviluppatori e aziende di sfruttare la potenza della generazione video IA senza spese proibitive.

Con l'evoluzione continua di Open-Sora, è pronto a rivoluzionare le industrie creative, offrendo strumenti di generazione video di alta qualità accessibili a tutti.

Pronto a esplorare strumenti di generazione video IA ancora più potenti? Scopri Minimax Video, Tencent Hunyuan, Runway ML e altro ancora — tutti disponibili su Anakin AI. Sblocca la tua creatività oggi: Esplora Anakin AI Video Generator