急速に進化する人工知能の分野で、自分自身のマシン上で強力な言語モデルをローカルで実行できる能力は、比類のないプライバシー、コントロール、柔軟性を提供します。DeepSeekによって開発された最先端の言語モデルであるDeepSeek-R1は、その推論、数学、コーディングタスクにおける驚異的なパフォーマンスから大きな注目を集めており、OpenAIの独自モデルにも匹敵します。この包括的なガイドでは、個人用コンピュータで大規模な言語モデルの展開を簡素化するために設計されたユーザーフレンドリーなプラットフォームOllamaを使用して、DeepSeek-R1をローカルで実行するプロセスを説明します。

DeepSeek-R1を理解する

DeepSeek-R1は、DeepSeekの第一世代推論モデルシリーズを表しており、OpenAIのo1のようなトップティアの商業モデルと競合することを目的としています。DeepSeek-R1が特に注目される理由は、より小さな蒸留バージョンから671Bパラメータの完全なモデルまで、複数のサイズで提供されているため、さまざまなハードウェア構成においてアクセス可能であることです。これらのモデルはMITのライセンスの下で提供されており、個人および商業アプリケーションでの利用が可能です。

DeepSeekチームは、彼らの最大モデルの推論能力が、より小さく、管理しやすいモデルに効果的に蒸留できることを示しています。これは、エンタープライズグレードのハードウェアにアクセスできなくても、より控えめなセットアップで高度なAI機能を利用できることを意味します。

なぜOllamaなのか?

Ollamaは、ローカルで大規模な言語モデルを実行するための最も人気のあるソリューションの一つとして浮上しています。以下の理由からです:

- 複雑なAIモデルのインストールと管理を簡素化します

- モデルのダウンロードと初期化を自動的に行います

- 特定のハードウェアに最適化されたモデルを提供します

- モデルと対話するための使いやすいインターフェースを提供します

- DeepSeek以外の幅広いモデルをサポートします

システム要件

始める前に、AIモデルをローカルで実行するには相当な計算リソースが必要であることを理解しておくべきです。要件は、使用するDeepSeek-R1のバージョンによって異なります:

- 小さいモデル(1.5B、7B、8B用): 少なくとも16GBのRAMを持つ現代のCPUと、可能であれば8GB以上のVRAMを持つ適度なGPU

- 中程度のモデル(14B、32B用): 16-24GBのVRAMを持つ強力なGPUが推奨されます

- 大きいモデル(70B用): 40GB以上のVRAMを持つハイエンドGPUまたは複数のGPU

- 完全な671Bモデル用: 複数の強力なGPUを搭載したエンタープライズグレードのハードウェア

オペレーティングシステムのサポートには、macOS、Linux、Windowsが含まれます。

ステップバイステップのインストールガイド

ステップ 1: Ollamaをインストールする

まず、システム上でOllamaをセットアップしましょう。

macOSおよびLinux用:

curl -fsSL https://ollama.com/install.sh | sh

Windows用:

公式Ollamaウェブサイトからインストーラーをダウンロードし、インストールウィザードに従ってください。

インストール後、Ollamaが正常に動作していることを確認します:

ollama --version

ステップ 2: DeepSeek-R1をダウンロードして実行する

Ollamaがインストールされたら、単一のコマンドでDeepSeek-R1をダウンロードして実行できます。ハードウェアの能力に基づいて適切なモデルサイズを選択してください:

エントリーレベルのシステム用(1.5Bバージョン、1.1GBダウンロード):

ollama run deepseek-r1:1.5b

中程度のシステム用(7Bバージョン、4.7GBダウンロード):

ollama run deepseek-r1:7b

より良いシステム用(Llamaに基づく8Bバージョン、4.9GBダウンロード):

ollama run deepseek-r1:8b

高性能システム用(14Bバージョン、9.0GBダウンロード):

ollama run deepseek-r1:14b

非常に強力なシステム用(32Bバージョン、20GBダウンロード):

ollama run deepseek-r1:32b

エンタープライズハードウェア用(70Bバージョン、43GBダウンロード):

ollama run deepseek-r1:70b

研究クラスター用(完全671Bモデル、404GBダウンロード):

ollama run deepseek-r1:671b

これらのコマンドを初めて実行するとき、Ollamaは自動的にモデルをダウンロードして設定します。これには、インターネット接続やモデルサイズに応じて時間がかかる場合があります。

ステップ 3: DeepSeek-R1と対話する

モデルが読み込まれたら、DeepSeek-R1と対話を始めるためのコマンドラインインターフェースが表示されます。単にクエリを入力してEnterを押してください。

>>> 監視学習と非監視学習の主な違いは何ですか?

DeepSeek-R1はあなたのクエリを処理し、学習に基づいて応答を提供します。

ステップ 4: 高度な使用法

Ollamaは、DeepSeek-R1との体験を向上させるためのいくつかの高度な機能を提供します:

カスタムパラメータ:

ollama run deepseek-r1:8b --temperature 0.7 --top-p 0.9

APIの使用:

Ollamaは、モデルをアプリケーションに統合するためのHTTP APIも提供しています:

curl -X POST http://localhost:11434/api/generate -d '{

"model": "deepseek-r1:8b",

"prompt": "量子コンピュータを簡単な言葉で説明してください",

"stream": false

}'

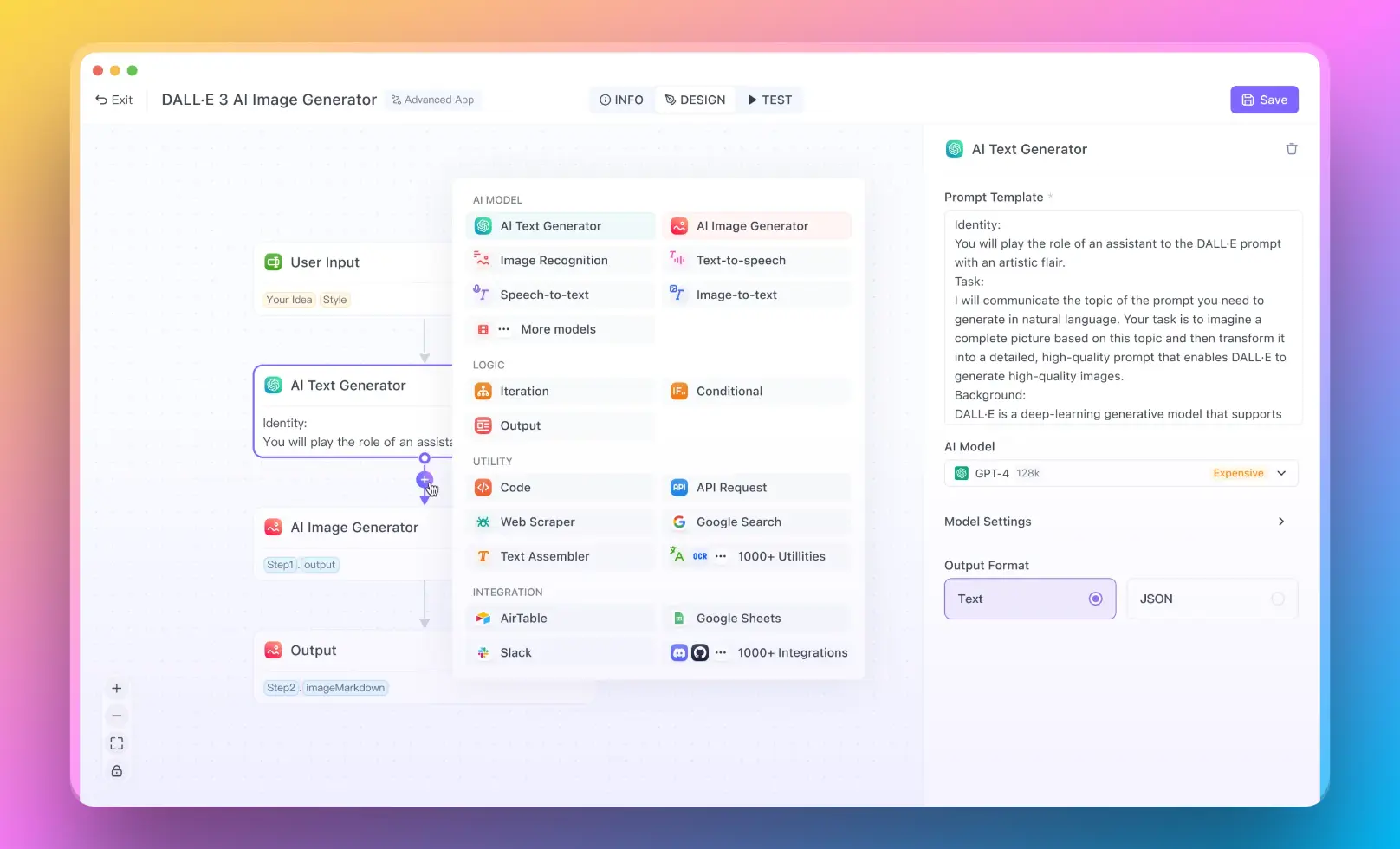

Anakin AIの使用:強力な代替手段

Ollamaでモデルをローカルで実行することは素晴らしいコントロールとプライバシーを提供しますが、相当な計算リソースと技術的な設定が必要です。特に強力なハードウェアへのアクセスがない多くのユーザーにとって、Anakin AIはローカルインストールの複雑さなしにDeepSeekや他の強力なモデルを体験できる優れた代替手段を提供します。

Anakin AIはオールインワンプラットフォームであり、次のような機能を提供します:

- 即時アクセス: 何もダウンロードしたりインストールしたりすることなく、ブラウザで直接DeepSeekや他の強力なモデルを使用できます。

- ユーザーフレンドリーなインターフェース: AIモデルとシンプルで直接的に対話をするための清潔で直感的なチャットインターフェース。

- 複数モデルサポート: DeepSeekだけでなく、Llama、Mistral、DolphinなどのさまざまなオープンソースLLMにもアクセスできます。

- ハードウェアの制約なし: ノートパソコンやタブレットなど、控えめなハードウェアでも大規模なモデルとの会話を実行できます。

- 持続的な会話: すべてのチャットが保存され、整理されているため、過去の対話を参照するのが簡単です。

- 高度な機能: AIアプリケーションを作成し、データと統合し、カスタムワークフローを構築できます。

Anakin AIを始めるには、単に:

- https://anakin.aiにアクセス

- アカウントを作成またはサインイン

- 利用可能なモデルからDeepSeekを選択

- セットアップなしですぐにチャットを開始

このアプローチは特に次のような人々にとって有益です:

- 限られたハードウェアリソースを持つユーザー

- 技術的な設定なしで迅速にアクセスが必要な人

- 同じAIインフラストラクチャを使用してコラボレーションしたいチーム

- ローカルにデプロイする前にさまざまなモデルをテストしたい開発者

パフォーマンス最適化のヒント

OllamaでDeepSeekをローカルで実行している場合、パフォーマンスを最適化するためのヒントをいくつか紹介します:

- GPUアクセラレーション: GPUドライバが最新で正しく設定されていることを確認し、最大のパフォーマンスを引き出します。

- メモリ管理: より大きなモデルを実行しているときは、不要なアプリケーションを閉じてシステムリソースを解放します。

- 量子化: Ollamaは自動的に量子化を適用してメモリ使用量を減らしますが、特定のニーズに合わせたさまざまな量子化設定を試すことができます。

- コンテキストウィンドウ管理: プロンプトと応答の長さに注意し、非常に長い会話はメモリを消費し、応答を遅くする可能性があります。

- 冷却: AIモデルを実行することは計算集約的であり、熱を発生させる可能性があります。サーマルスロットリングを防ぐために、システムが適切な冷却を持っていることを確認してください。

DeepSeek-R1を使用してアプリケーションを構築する

シンプルなチャットインタラクションを超えて、DeepSeek-R1はさまざまなアプリケーションに統合できます:

コード生成と分析:

DeepSeek-R1はコード関連のタスクに優れており、開発者にとって以下のような価値があります:

- 要求に基づいてコードスニペットを生成する

- 既存のコードをデバッグする

- アルゴリズムを最適化する

- プログラミング言語間で翻訳する

研究と分析:

モデルの推論能力は、以下のような場面に適しています:

- 学術論文を要約する

- データトレンドを分析する

- 仮説を生成する

- 構造化レポートを作成する

コンテンツ作成:

DeepSeek-R1を使用して:

- 記事を書いたり編集したりする

- マーケティングコピーを作成する

- クリエイティブなコンテンツを生成する

- 言語間で翻訳する

結論

Ollamaを使用してDeepSeek-R1をローカルで実行することは、強力なAIモデルへのアクセスを民主化する重要なステップを表します。このアプローチは、データとインタラクションに完全にコントロールを与えながら、最先端の言語処理能力を活用します。ハードウェア資源や技術的な快適さに応じて、Ollamaを通じてモデルをローカルで実行するか、Anakin AIのようなユーザーフレンドリーなプラットフォームを通じてアクセスするかを選択できます。

AI技術が進化し続ける中、これらのモデルをローカルで実行できる能力は、プライバシーを重視する個人、敏感なデータを扱う開発者、そしてサードパーティのAPIに依存せずに独自のアプリケーションを構築しようとする組織にとってますます重要になるでしょう。

次世代のAI搭載アプリケーションを構築する開発者、大規模な言語モデルの能力を探る研究者、あるいは最先端のAIを体験しているいずれかのエンスージアストであっても、Ollamaを使ったDeepSeek-R1は、進んだAI機能を手の届くところに提供する強力で柔軟なソリューションを提供します。

適切なセットアップとリソースがあれば、DeepSeek-R1の力を利用して、シンプルなテキスト生成から複雑な推論タスクまで、すべてをローカルでデータと計算リソースに完全なコントロールを保ちながら実行できます。そして、ローカルでの計算が現実的でない場合には、Anakin AIのようなソリューションが、進んだAIモデルのパワーを数回のクリックで利用できる便利な代替手段を提供することを忘れないでください。