No cenário em rápida evolução da inteligência artificial, ter acesso a modelos de linguagem poderosos e não censurados localmente oferece uma liberdade sem precedentes para desenvolvedores, pesquisadores e entusiastas de IA. O DeepSeek R1, um modelo de linguagem de última geração desenvolvido pela DeepSeek, ganhou atenção significativa por suas impressionantes capacidades de raciocínio que rivalizam com modelos proprietários, como as ofertas da OpenAI. Este guia abrangente irá orientá-lo por tudo que você precisa saber sobre como rodar a versão não censurada do DeepSeek R1 em sua máquina local, dando a você controle completo e privacidade sobre suas interações com a IA.

Entendendo o DeepSeek R1: Um Modelo de Raciocínio Poderoso

O DeepSeek R1 representa um avanço significativo na tecnologia de IA de código aberto. Este modelo demonstrou desempenho excepcional em benchmarks complexos, destacando-se particularmente em:

- Tarefas avançadas de raciocínio que exigem resolução de problemas em múltiplas etapas

- Cálculo matemático e resolução de problemas algorítmicos

- Codificação e escrita técnica com precisão impressionante

- Geração de conteúdo criativo em vários domínios

A versão padrão do DeepSeek R1 vem com mecanismos de segurança integrados que restringem certos tipos de saídas. No entanto, muitos usuários buscam a versão não censurada para pesquisas legítimas, aplicações criativas ou casos de uso especializados onde tais limitações são contraproducentes.

Por que Executar o DeepSeek R1 Não Censurado Localmente?

Executar uma versão não censurada do DeepSeek R1 localmente oferece várias vantagens convincentes:

- Privacidade completa: Seus dados e prompts nunca saem de sua máquina

- Sem taxas de uso: Evite custos por token ou de assinatura associados a APIs de nuvem

- Personalização: Ajuste parâmetros e prompts do sistema sem restrições

- Capacidade offline: Use IA avançada sem precisar de conexão com a internet

- Sem limites de taxa: Execute quantas consultas seu hardware suportar

O Processo de Abliteração: De Censurado a Não Censurado

O processo de remoção de filtros de segurança de modelos de linguagem como o DeepSeek R1 é frequentemente referido como "abliteração". Ao contrário do ajuste fino tradicional que requer retrainings extensivos, a ablitação modifica os padrões de ativação interna do modelo para suprimir sua tendência a rejeitar certos tipos de prompts.

Esse processo preserva as capacidades de raciocínio principais enquanto remove restrições artificiais, resultando em um modelo que:

- Maintém sua inteligência e capacidades originais

- Responde a uma gama mais ampla de prompts sem recusa

- Permite a exploração de tópicos criativos e controversos

Apresentando o Anakin AI: Sua Porta de Entrada para Fluxos de Trabalho de IA

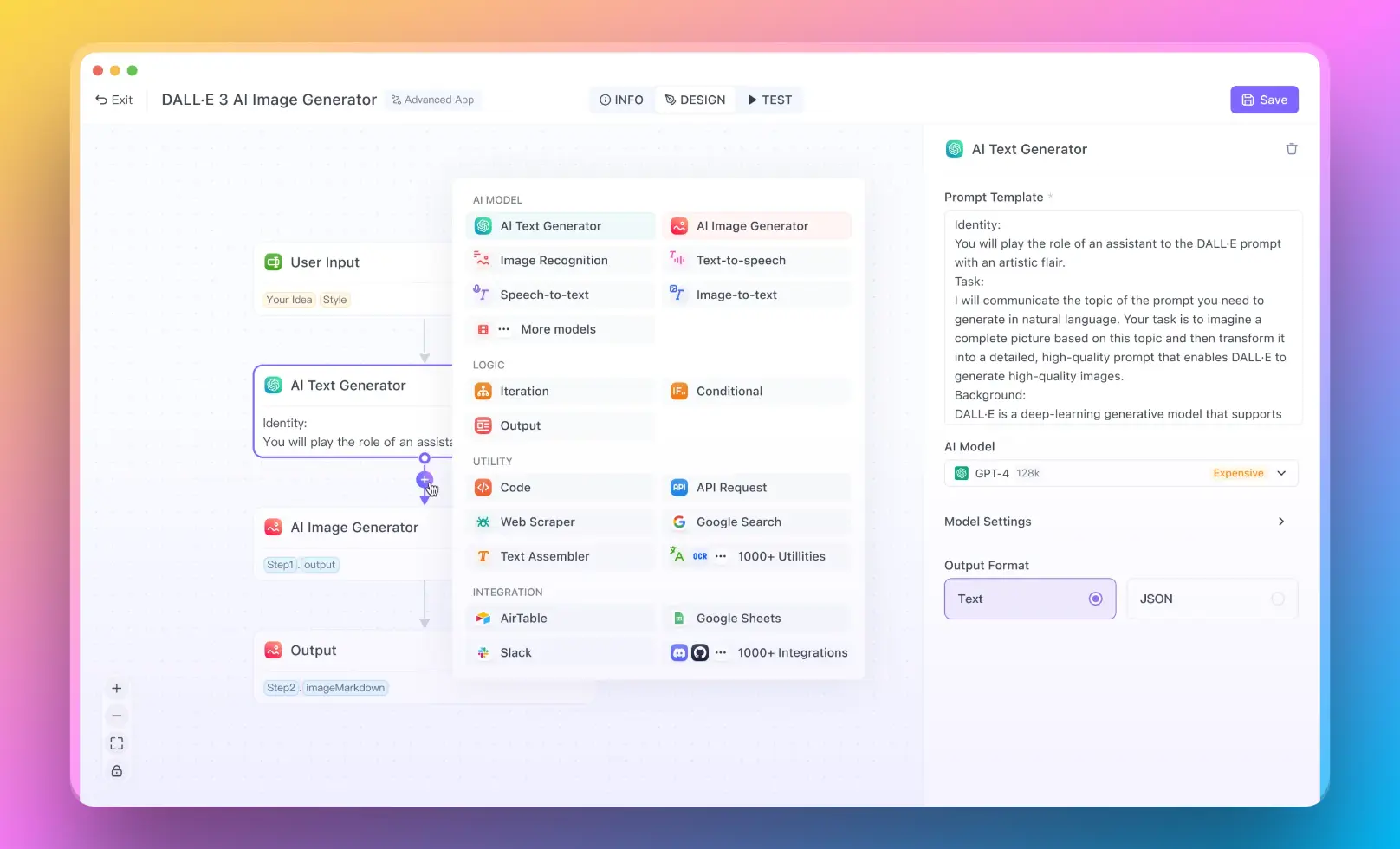

Antes de mergulhar na instalação local, vale a pena considerar o Anakin AI como uma plataforma poderosa para trabalhar com modelos não censurados como o DeepSeek R1.

O Anakin AI oferece uma solução sem código para criar fluxos de trabalho de IA que podem aproveitar vários modelos poderosos, incluindo versões não censuradas do DeepSeek R1.

Com o Anakin AI, você pode:

- Conectar-se a várias APIs LLM, incluindo DeepSeek R1, GPT-4, Claude 3.5 e Dolphin-Mixtral não censurado

- Criar fluxos de trabalho complexos de IA sem conhecimentos de programação

- Integrar a geração de imagens de IA (FLUX) e a geração de áudio/vídeo (Minimax)

- Acessar 1000+ aplicativos de IA pré-construídos para vários casos de uso

Para aqueles que desejam um início rápido com o DeepSeek R1 não censurado sem gerenciar a complexidade técnica da implantação local, o Anakin AI oferece uma excelente alternativa. No entanto, para aqueles comprometidos com uma configuração totalmente local, vamos prosseguir com o guia de instalação.

Requisitos de Hardware para Executar o DeepSeek R1 Localmente

O DeepSeek R1 está disponível em vários tamanhos, com os requisitos de recursos escalonando de acordo:

Requisitos Mínimos:

- GPU: GPU NVIDIA com pelo menos 8GB de VRAM para o modelo de 8B de parâmetros

- RAM: 16GB no mínimo (recomendado 32GB+)

- Armazenamento: 15-40GB de espaço livre dependendo do tamanho do modelo

- CPU: Processador moderno de múltiplos núcleos (Intel i7/Ryzen 7 ou melhor)

Recomendado para Modelos Maiores (32B/70B):

- GPU: NVIDIA RTX 4090 (24GB VRAM) ou múltiplas GPUs

- RAM: 64GB+

- Armazenamento: SSD NVMe com 100GB+ de espaço livre

- CPU: Processador de alto desempenho com 8+ núcleos físicos

Instalando e Executando o DeepSeek R1 Não Censurado com Ollama

Ollama é uma ferramenta amigável que simplifica a execução de grandes modelos de linguagem localmente. Veja como usá-la para implantar o DeepSeek R1 não censurado:

Passo 1: Instalar Ollama

Para macOS/Linux:

curl -fsSL https://ollama.com/install.sh | sh

Para Windows:

Baixe o instalador do site oficial do Ollama.

Passo 2: Baixar o Modelo

Dependendo das capacidades do seu hardware, escolha o tamanho do modelo apropriado:

# Para a versão de 8B de parâmetros (menos intensiva em recursos)

ollama pull deepseek-r1:8b

# Para versões maiores (se seu hardware suportar)

ollama pull deepseek-r1:32b

ollama pull deepseek-r1:70b

Para versões especificamente não censuradas, você pode precisar usar modelos fornecidos pela comunidade:

ollama pull huihui_ai/deepseek-r1-abliterated:8b

Passo 3: Executar o Modelo

Inicie uma sessão interativa com seu modelo instalado:

ollama run deepseek-r1:8b

ou para a versão não censurada:

ollama run huihui_ai/deepseek-r1-abliterated:8b

Agora você pode interagir com o modelo diretamente através da linha de comando.

Passo 4: Integração com Aplicações

Ollama fornece uma API REST que permite integrar o modelo com outras aplicações:

- Ponto de extremidade da API: http://localhost:11434

- Requisição de exemplo:

POST http://localhost:11434/api/generate

{

"model": "deepseek-r1:8b",

"prompt": "Seu prompt aqui",

"stream": true

}

Configuração Avançada para Desempenho Ideal

Opções de Quantização

A quantização reduz a pegada de memória do modelo com impacto mínimo na qualidade:

- Q4_K_M: Melhor equilíbrio entre qualidade e desempenho

- Q6_K: Qualidade mais alta, mas requer mais VRAM

- Q2_K: Máxima eficiência para hardware limitado

Ajustes de Parâmetros

Ajuste o comportamento do seu modelo com esses parâmetros:

ollama run deepseek-r1:8b -c '

{

"temperature": 0.7,

"top_p": 0.9,

"context_length": 4096,

"repeat_penalty": 1.1

}'

Alocação de Camadas da GPU

Se você tiver VRAM limitada, pode especificar quantas camadas serão transferidas para a GPU:

ollama run deepseek-r1:8b --gpu-layers 32

Usando o Anakin AI para Fluxos de Trabalho Aprimorados

Como mencionado anteriormente, Anakin AI oferece uma alternativa poderosa para setups locais complexos. Veja como o Anakin AI pode aprimorar sua experiência com o DeepSeek R1 não censurado:

- Cri ação de fluxos de trabalho sem código: Construa visualmente fluxos de trabalho complexos de IA sem programação

- Integração de múltiplos modelos: Combine DeepSeek R1 com outros modelos no mesmo fluxo de trabalho

- Templates pré-construídos: Acesse templates especializados para várias aplicações

- Eficiência de custo: Pague apenas pelo que usa, sem gerenciar infraestrutura

Para começar com o Anakin AI:

- Inscreva-se na plataforma Anakin AI

- Selecione DeepSeek R1 entre os modelos disponíveis

- Configure seu fluxo de trabalho visualmente com a interface de arrastar e soltar

- Implante sua solução com um único clique

Considerações Éticas e Uso Responsável

Enquanto modelos não censurados oferecem liberdade valiosa para aplicações legítimas, eles também vêm com responsabilidades:

- Monitoramento de Conteúdo: Implemente sua própria filtragem de conteúdo para aplicações voltadas aos usuários

- Conformidade Legal: Certifique-se de que seu uso esteja em conformidade com as leis e regulamentos locais

- Proteção de Privacidade: Trate os dados dos usuários com responsabilidade, especialmente ao processar informações sensíveis

- Prevenção de Danos: Evite aplicações que possam causar danos diretos a indivíduos ou grupos

Resolução de Problemas Comuns

Erros de Memória Insuficiente

Se você encontrar erros de falta de memória CUDA:

- Reduza a extensão do contexto

- Use uma quantização mais agressiva (por exemplo, Q4_K_M em vez de Q6_K)

- Alocar menos camadas para a GPU

- Feche outros aplicativos que utilizam intensivamente a GPU

Desempenho Lento

Para melhorar o desempenho:

- Ative a aceleração da GPU, se disponível

- Use um SSD NVMe para armazenamento do modelo

- Otimize o tamanho do lote e a contagem de threads

- Considere atualizar o hardware para modelos maiores

Alucinações do Modelo

Para reduzir ineficiências nas saídas:

- Diminua a configuração da temperatura

- Aumente a penalidade de repetição

- Forneça prompts mais detalhados com instruções explícitas

- Use prompts de sistema para guiar o comportamento do modelo

Conclusão

Executar o modelo DeepSeek R1 não censurado localmente dá a você acesso sem precedentes a capacidades poderosas de IA com privacidade e controle completos. Seja você escolher a rota técnica de instalação local através do Ollama ou optar pela experiência simplificada do Anakin AI, você agora tem o conhecimento necessário para implantar este modelo de ponta para suas necessidades específicas.

Ao entender tanto os aspectos técnicos quanto as considerações éticas, você pode aproveitar os modelos de IA não censurados de maneira responsável enquanto explora todo o espectro de possibilidades que eles oferecem. À medida que os modelos de linguagem continuam a evoluir, ter as habilidades para implantar e personalizá-los localmente continuará sendo um ativo inestimável para desenvolvedores, pesquisadores e entusiastas de IA.

Lembre-se de que, com grande poder, vem grande responsabilidade. Use essas capacidades de forma ética, legal e consciente para contribuir positivamente para o avanço da tecnologia de IA.