In diesem umfassenden Leitfaden werden wir untersuchen, wie man das leistungsstarke Llama 3 70b-Sprachmodell lokal mit Ollama ausführt und wie man benutzerdefinierte KI-Apps ohne Codierung mit Anakin AI erstellt. Wir werden den Installationsprozess, das Ausführen von Llama 3 mit Ollama, das Erstellen von KI-Apps mit Anakin AI's No-Code-Plattform und die Integration von KI-Funktionen in Ihre Projekte mithilfe der APIs von Anakin AI abdecken. Am Ende dieses Leitfadens werden Sie das Wissen und die Fähigkeiten haben, die Möglichkeiten dieser modernen KI-Werkzeuge zu nutzen.

Dann dürfen Sie Anakin AI nicht verpassen!

Anakin AI ist eine All-in-One-Plattform für Ihre Workflow-Automatisierung. Erstellen Sie leistungsstarke KI-Apps mit einem benutzerfreundlichen No-Code-App-Builder, mit Llama 3, Claude, GPT-4, Uncensored LLMs, Stable Diffusion...

Erstellen Sie Ihre Traum-KI-App innerhalb von Minuten, nicht Wochen, mit Anakin AI!

Ausführen von Llama 3 70b mit Ollama

Ollama ist eine kostenlose und Open-Source-Anwendung, mit der Sie verschiedene große Sprachmodelle, einschließlich Llama 3, auf Ihrem eigenen Computer ausführen können, auch mit begrenzten Ressourcen. Es nutzt die Leistungsvorteile von llama.cpp, einer Open-Source-Bibliothek, die entwickelt wurde, um LLMs lokal mit relativ geringen Hardwareanforderungen auszuführen.

Installation von Ollama

Der erste Schritt besteht darin, Ollama zu installieren. Es unterstützt alle gängigen Betriebssysteme: Windows, macOS und Linux. Befolgen Sie die Anweisungen auf der offiziellen Ollama-Website (https://ollama.com/), um die entsprechende Version für Ihr System herunterzuladen und zu installieren.

Windows-Installation

- Besuchen Sie die Ollama-Website und laden Sie den Windows-Installer herunter.

- Führen Sie den Installer aus und befolgen Sie die Anweisungen auf dem Bildschirm.

- Nach der Installation können Sie Ollama über das Startmenü oder durch Ausführen des Befehls

ollamaim Terminal starten.

macOS-Installation

- Besuchen Sie die Ollama-Website und laden Sie den macOS-Installer herunter.

- Doppelklicken Sie auf die heruntergeladene Datei, um die Ollama-Anwendung zu extrahieren.

- Ziehen Sie die Ollama-Anwendung in Ihren "Applications"-Ordner.

- Starten Sie Ollama aus dem "Applications"-Ordner oder indem Sie den Befehl

ollamaim Terminal ausführen.

Linux-Installation

- Besuchen Sie die Ollama-Website und laden Sie den Linux-Installer für Ihre Distribution herunter.

- Entpacken Sie das heruntergeladene Archiv.

- Öffnen Sie ein Terminal und navigieren Sie zum extrahierten Verzeichnis.

- Führen Sie das Skript

install.shmit sudo-Rechten aus:sudo ./install.sh - Nach der Installation können Sie Ollama ausführen, indem Sie

ollamaim Terminal eingeben.

Herunterladen und Ausführen von Llama 3 70b

Nachdem Ollama installiert ist, öffnen Sie Ihr Terminal oder die Eingabeaufforderung und führen Sie den folgenden Befehl aus:

ollama run llama3:70b

Mit diesem Befehl wird das Llama 3 70b-Modell heruntergeladen und geladen, das ein großes Sprachmodell mit 70 Milliarden Parametern ist. Je nach Internetverbindung und Systemspezifikationen kann dieser Vorgang einige Zeit dauern.

Nach Abschluss des Downloads startet Ollama eine Chat-Oberfläche, in der Sie mit dem Llama 3 70b-Modell interagieren können. Sie können Fragen stellen, Eingaben geben oder Gespräche führen, und das Modell generiert Antworten basierend auf seinem Training.

Optimierung der Leistung

Wenn Sie aufgrund begrenzter Systemressourcen eine langsame Leistung erleben oder Probleme bei der Ausführung des 70b-Modells auftreten, können Sie Folgendes ausprobieren:

Verwenden Sie ein kleineres Modell: Ollama bietet auch Zugriff auf die 8b-Version von Llama 3, die weniger Parameter hat und möglicherweise effizienter auf Systemen mit geringerer Leistung läuft. Um das 8b-Modell auszuführen, verwenden Sie den Befehl ollama run llama3:8b.

Verwenden Sie eine geringere Quantisierung: Ollama bietet verschiedene Quantisierungsstufen für die Modelle an, die sich auf deren Größe und Leistung auswirken können. Sie können versuchen, eine geringere Quantisierungsstufe mit dem Befehl ollama run llama3:70b-instruct-q2_K auszuführen.

Verbessern Sie Ihre Hardware: Wenn Sie umfangreich mit großen Sprachmodellen wie Llama 3 70b arbeiten möchten, erwägen Sie ein Upgrade des RAMs und der GPU Ihres Systems, um den Rechenaufwand effizienter bewältigen zu können.

Erstellen von KI-Apps mit Anakin AI

Anakin AI ist eine No-Code-Plattform, mit der Sie benutzerdefinierte KI-Apps erstellen können, ohne eine einzige Zeile Code schreiben zu müssen. Sie bietet eine benutzerfreundliche Oberfläche und integriert verschiedene KI-Modelle, darunter GPT-3, GPT-4, Claude, Stable Diffusion und mehr.

Erstellen eines Kontos

Um mit Anakin AI zu beginnen, besuchen Sie deren Website (https://www.anakin.ai/) und erstellen Sie ein kostenloses Konto. Nach der Anmeldung haben Sie Zugriff auf Ihren persönlichen Arbeitsbereich.

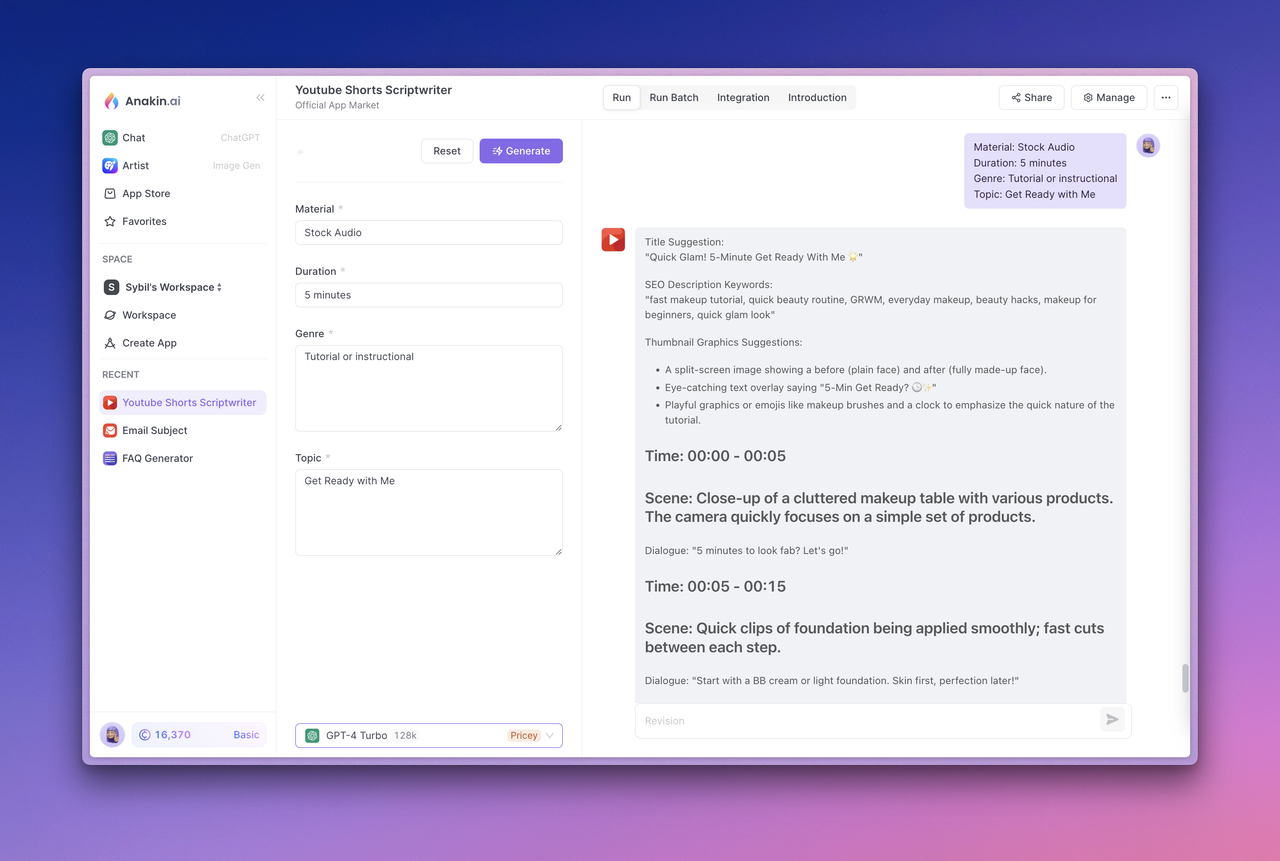

Erstellen einer Schnell-App

Eine der einfachsten Möglichkeiten, eine KI-App mit Anakin AI zu erstellen, besteht darin, die Funktion "Schnell-App" zu verwenden. So erstellen Sie eine Schnell-App:

- In Ihrem persönlichen Arbeitsbereich klicken Sie auf die Schaltfläche "App hinzufügen oder erstellen".

- Wählen Sie die Option "Schnell-App" aus und geben Sie Ihrer App einen Namen.

- Definieren Sie Ihre Eingabefelder, wie z.B. das Thema für einen Blogbeitrag oder eine Eingabeaufforderung für die Textgenerierung.

- Wählen Sie das KI-Modell aus, das Sie für Ihre App verwenden möchten.

- Klicken Sie auf "Generieren", um Ihre App zu testen und die Ausgabe anzuzeigen.

Beispiel: Erstellen wir eine Schnell-App, die einen Blogbeitrag zu einem bestimmten Thema generiert:

- Nennen Sie Ihre App "Blog Post Generator".

- Fügen Sie ein Eingabefeld namens "Thema" als einzeiliges Textfeld hinzu.

- Wählen Sie das Modell "GPT-4" aus.

- Klicken Sie auf "Generieren" und geben Sie ein Thema ein, z.B. "Nachhaltiges Leben".

- Die App generiert einen gut strukturierten Blogbeitrag zum gewählten Thema.

Anpassen Ihrer App

Anakin AI ermöglicht es Ihnen, Ihre KI-App weiter anzupassen, indem Sie zusätzliche Eingabefelder hinzufügen, die Parameter des KI-Modells anpassen und das Ausgabeformat ändern. Experimentieren Sie mit verschiedenen Einstellungen, um die beste Konfiguration für Ihre Bedürfnisse zu finden.

Zum Beispiel können Sie dem Blog-Post-Generator zusätzliche Eingabefelder wie "Wörteranzahl" oder "Ton" hinzufügen und die Parameter des KI-Modells anpassen, um Inhalte zu generieren, die Ihren Vorlieben entsprechen.

Verwenden von vorgefertigten Apps

Zusätzlich zum Erstellen eigener Apps bietet Anakin AI eine Sammlung von vorgefertigten KI-Apps, die von Entwicklern und anderen Benutzern erstellt wurden. Sie können diese Apps direkt durchsuchen und verwenden oder sie klonen und nach Ihren Anforderungen anpassen.

Um eine vorgefertigte App zu verwenden, befolgen Sie diese Schritte:

- Klicken Sie in Ihrem persönlichen Arbeitsbereich auf die Schaltfläche "Apps durchsuchen".

- Durchsuchen Sie die verfügbaren Apps oder verwenden Sie die Suchfunktion, um spezifische Apps zu finden.

- Klicken Sie auf eine App, um Details und Beschreibungen anzuzeigen.

- Klicken Sie auf die Schaltfläche "App verwenden", um die App zu Ihrem Arbeitsbereich hinzuzufügen.

- Passen Sie bei Bedarf die Einstellungen der App an oder verwenden Sie sie wie sie ist.

Teilen Ihrer App

Sobald Sie eine benutzerdefinierte KI-App erstellt haben, mit der Sie zufrieden sind, können Sie sie über den Anakin AI App Store veröffentlichen und anderen Benutzern zugänglich machen. Dadurch können andere Benutzer Ihre App entdecken und nutzen, und Sie können Guthaben erhalten, wenn sie sich anmelden und Ihre App nutzen.

Um Ihre App zu teilen, befolgen Sie diese Schritte:

- Halten Sie in Ihrem persönlichen Arbeitsbereich über der App, die Sie teilen möchten, den Mauszeiger und klicken Sie auf die drei Punkte.

- Wählen Sie "Verwalten" aus dem Dropdown-Menü.

- Klicken Sie auf die Schaltfläche "Im App Store veröffentlichen".

- Geben Sie die erforderlichen Informationen wie den Namen, die Beschreibung und das Symbol der App ein.

- Klicken Sie auf "Veröffentlichen", um Ihre App im App Store verfügbar zu machen.

Sie können dann den Link zu Ihrer veröffentlichten App teilen, und andere Benutzer können sie direkt verwenden oder sie in ihrem Arbeitsbereich klonen, um sie weiter anzupassen.

API-Integration mit Anakin AI

Anakin AI bietet umfassende API-Services für alle Anwendungen und ermöglicht Entwicklern und Organisationen, ihre Projekte nahtlos mit Anakin AI-APIs zu integrieren und zu verbessern.

Vorteile der API-Integration

- Schnelle Entwicklung: Entwickeln Sie KI-Anwendungen, die auf Ihre geschäftlichen Anforderungen zugeschnitten sind, mit Anakin AI's intuitiver visueller Schnittstelle und Echtzeitimplementierung auf allen Clients.

- Flexibilität: Unterstützung mehrerer KI-Modellanbieter, die Ihnen die Flexibilität geben, bei Bedarf Anbieter zu wechseln.

- Streamlined Access: Vorverpackter Zugriff auf die wesentlichen Funktionen des KI-Modells.

- Einen Schritt voraus: Bleiben Sie mit bevorstehenden erweiterten Funktionen, die über die API verfügbar sind, immer einen Schritt voraus.

Wie man Anakin AI's API verwendet, um Apps zu erstellen

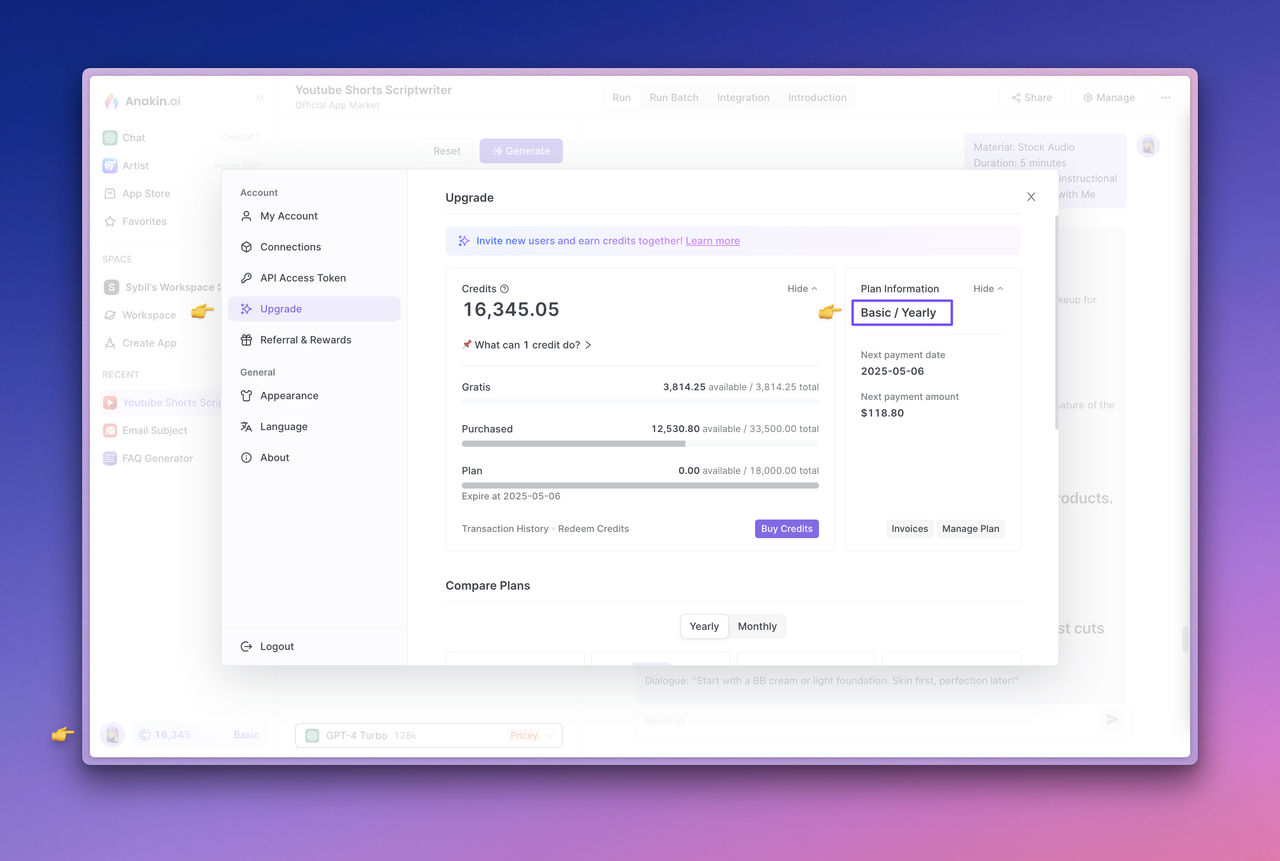

Schritt 1: Upgraden Sie Ihren Plan und überprüfen Sie Ihr Kontoguthaben

Anakin AI's API-Dienst ist derzeit exklusiv für Abonnenten verfügbar. Beim Verwenden des KI-Modells über API-Aufrufe werden Guthaben von Ihrem Kontostand abgebucht.

Um Ihren Abonnementstatus zu überprüfen oder Ihren Plan zu aktualisieren, navigieren Sie zur Anakin AI Web App. Klicken Sie auf den Avatar in der linken unteren Ecke, um die Upgrade-Seite aufzurufen. Stellen Sie bitte sicher, dass Ihr aktuelles Konto über ausreichendes Guthaben verfügt.

Schritt 2: Testen Sie Ihre App

Um die App zu testen, wählen Sie die App aus und klicken Sie auf die Schaltfläche "Generieren". Bestätigen Sie, dass sie ordnungsgemäß funktioniert und die erwartete Ausgabe liefert, bevor Sie fortfahren.

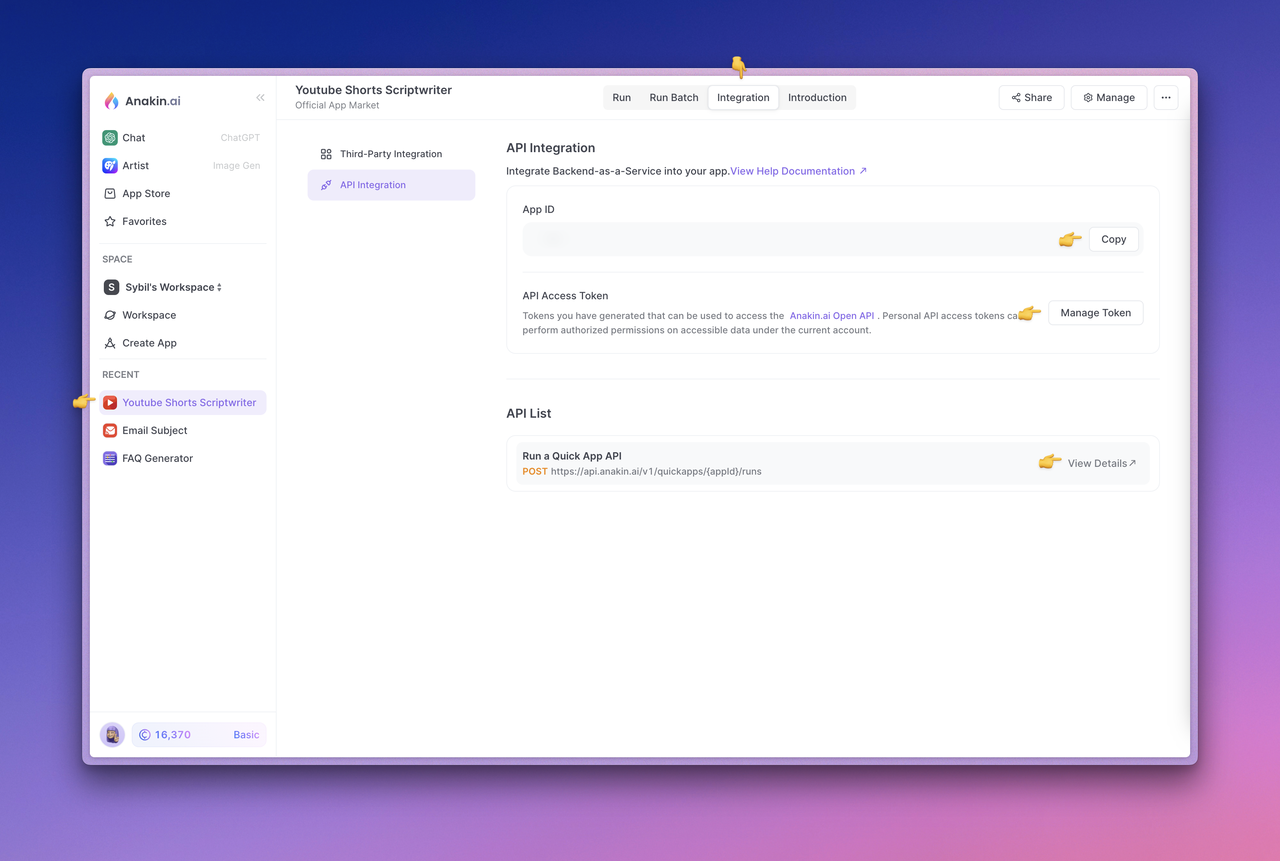

Schritt 3: API-Dokumentation anzeigen und API-Zugriffstoken verwalten

Besuchen Sie als Nächstes den Bereich Integration in der App oben. In diesem Bereich können Sie auf "Details anzeigen" klicken, um die von Anakin AI bereitgestellte API-Dokumentation anzuzeigen, API-Zugriffstoken zu verwalten und die App-ID anzuzeigen.

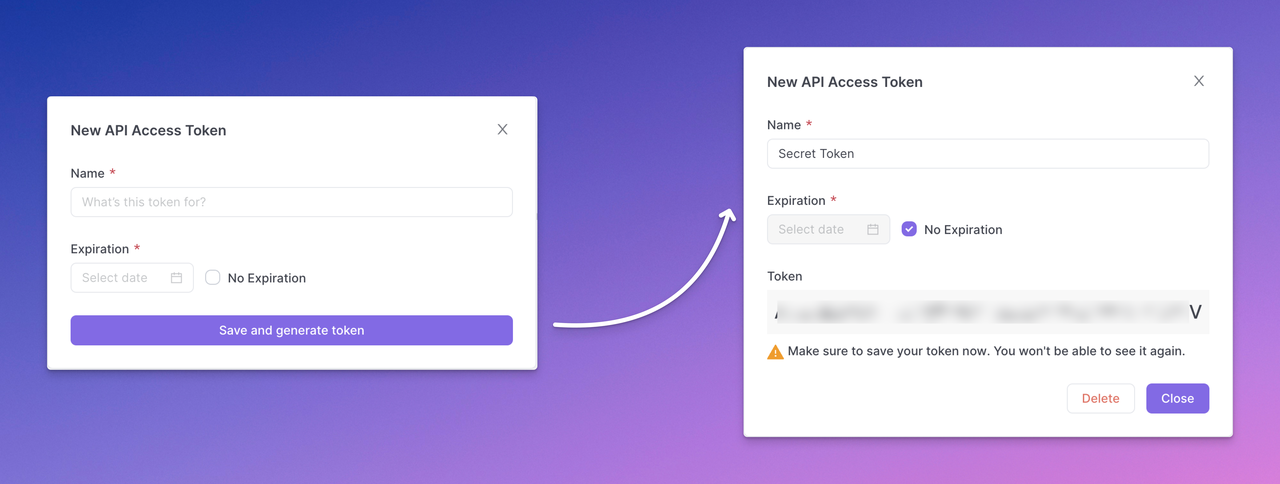

Schritt 4: Generieren Sie Ihr API-Zugriffstoken

Klicken Sie auf die Schaltfläche "Token verwalten", um Ihr API-Zugriffstoken zu verwalten, und wählen Sie "Neues Token" aus, um Ihr API-Zugriffstoken zu generieren.

Konfigurieren Sie die folgenden Token-Einstellungen, klicken Sie auf "Speichern und Token generieren" und kopieren Sie das API-Zugriffstoken sicher.

HINWEIS: Das generierte API-Zugriffstoken wird nur einmal angezeigt. Stellen Sie sicher, dass Sie es sofort kopieren und sicher speichern. Eine bewährte Praxis besteht darin, API-Schlüssel im Klartext über Backend-Aufrufe freizulegen, anstatt sie direkt im Frontend-Code oder in Anfragen zu verwenden. Dies hilft, Missbrauch oder Angriffe auf Ihre App zu verhindern.

Sie können mehrere API-Zugriffstoken für eine App erstellen, um sie unter verschiedenen Benutzern oder Entwicklern zu verteilen. Dadurch können Benutzer der API auf die von der App bereitgestellten KI-Funktionen zugreifen, während die zugrunde liegende Eingabeaufforderungstechnik und andere Toolfunktionen intakt bleiben.

Wie man eine Schnell-App mit Anakin AI erstellt

Eine Schnell-App ermöglicht es Ihnen, hochwertige Textinhalte wie Blog-Beiträge, Übersetzungen und andere kreative Inhalte zu generieren. Durch Aufruf der Run a Quick App API wird der Benutzerinhalt gesendet und das generierte Textergebnis erhalten.

Die für die Textgenerierung verwendeten Modellparameter und Eingabeaufforderungsvorlagen hängen von den Eingabeeinstellungen in der Anakin AI App -> Verwalten -> Design-Seite ab.

Die API-Dokumentation und Beispielanfragen für die App finden Sie in App -> Integration -> API List -> Details anzeigen.

Hier ist ein Beispiel für einen API-Aufruf, um Informationen zur Textvervollständigung zu erstellen:

TIPP: Bitte denken Sie daran, die Variable {{appId}} durch die gewünschte App-ID zu ersetzen und ANAKINAI_API_ACCESS_TOKEN durch das generierte API-Zugriffstoken in Schritt 4 zu ersetzen.

curl --location --request POST 'https://api.anakin.ai/v1/quickapps/{{appId}}/runs' \

--header 'Authorization: Bearer ANAKINAI_API_ACCESS_TOKEN' \

--header 'X-Anakin-Api-Version: 2024-05-06' \

--header 'Content-Type: application/json' \

--data-raw '{

"inputs": {

"Produkt/Service": "Cloud-Service",

"Funktionen": "Zuverlässigkeit und Leistung.",

"Vorteile": "Effizienz",

"Rahmen": "Attention-Interest-Desire-Action"

},

"stream": true

}'

Überprüfen Sie weitere Details zur Quick-App-API in der API-Referenz.

Wie man eine KI-Chatbot-App mit Anakin AI erstellt

Eine Chatbot-App ermöglicht es Ihnen, Chatbots zu erstellen, die in einem natürlichen Frage-Antwort-Format mit Benutzern interagieren. Um ein Gespräch zu beginnen, rufen Sie die Conversation with Chatbot API auf und geben Sie den zurückgegebenen Parametername weiterhin ein, um das Gespräch aufrechtzuerhalten.

Die API-Dokumentation und Beispielanfragen für die App finden Sie in App -> Integration -> API List -> Details anzeigen.

Hier ist ein Beispiel für einen API-Aufruf, um Unterhaltungsnachrichten zu senden:

TIPP: Bitte denken Sie daran, die Variable {{appId}} durch die gewünschte App-ID zu ersetzen und ANAKINAI_API_ACCESS_TOKEN durch das generierte API-Zugriffstoken in Schritt 4 zu ersetzen.

curl --location --request POST 'https://api.anakin.ai/v1/chatbots/{{appId}}/messages' \

--header 'Authorization: Bearer ANAKINAI_API_ACCESS_TOKEN' \

--header 'X-Anakin-Api-Version: 2024-05-06' \

--header 'Content-Type: application/json' \

--data-raw '{

"content": "Wie ist dein Name? Bist du der Schlaue?",

"stream": true

}'

Fazit

In diesem umfassenden Leitfaden haben wir besprochen, wie man das leistungsstarke Llama 3 70b-Sprachmodell lokal mit Ollama ausführt und wie man benutzerdefinierte KI-Apps ohne Codierung mit Anakin AI erstellt. Durch den Einsatz dieser Werkzeuge können Sie die Möglichkeiten moderner KI-Technologien nutzen und sie in Ihre Projekte oder Workflows integrieren. Ob Sie ein Entwickler, ein Geschäftsprofi oder ein KI-Enthusiast sind, Ollama und Anakin AI bieten zugängliche und benutzerfreundliche Lösungen, um das Potenzial von KI freizuschalten.

Dann dürfen Sie Anakin AI nicht verpassen!

Anakin AI ist eine All-in-One-Plattform für Ihre Workflow-Automatisierung. Erstellen Sie leistungsstarke KI-Apps mit einem benutzerfreundlichen No-Code-App-Builder, mit Llama 3, Claude, GPT-4, Uncensored LLMs, Stable Diffusion...

Erstellen Sie Ihre Traum-KI-App innerhalb von Minuten, nicht Wochen, mit Anakin AI!

+