في ظل التطور السريع في مجال الذكاء الاصطناعي، فإن القدرة على تشغيل نماذج اللغة القوية محليًا على جهازك الخاص توفر خصوصية وتحكم ومرونة لا مثيل لها. تمثل DeepSeek-R1، نموذج اللغة المتقدم الذي طورته DeepSeek، نقطة جذب كبيرة للأضواء نظراً لأدائها المذهل في مهام الاستدلال والرياضيات والبرمجة—مقارنًا حتى بنماذج OpenAI الخاصة. ستقوم هذه الدليل الشامل بإرشادك خلال عملية تشغيل DeepSeek-R1 محليًا باستخدام Ollama، وهو منصة سهلة الاستخدام مصممة لتبسيط نشر نماذج اللغة الكبيرة على أجهزة الكمبيوتر الشخصية.

فهم DeepSeek-R1

تمثل DeepSeek-R1 سلسلة النماذج الأولى للاستدلال من DeepSeek، التي تم تصميمها لمنافسة النماذج التجارية الراقية مثل o1 من OpenAI. ما يجعل DeepSeek-R1 جديرًا بالملاحظة بشكل خاص هو أنه متاح بأحجام متعددة، من النسخ الصغيرة المصفاة إلى نموذج كامل يحتوي على 671 مليار معلمة، مما يجعله متاحًا عبر تكوينات الأجهزة المختلفة. هذه النماذج مرخصة بموجب MIT، مما يتيح استخدامها لكل من التطبيقات الشخصية والتجارية.

أظهرت فريق DeepSeek أن قدرات الاستدلال لأكبر نماذجهم يمكن تقطيرها بشكل فعال إلى نماذج أصغر وأكثر قابلية للإدارة. هذا يعني أنه حتى لو لم يكن لديك إمكانية الوصول إلى الأجهزة ذات المعايير التجارية، يمكنك أن تستفيد من قدرات الذكاء الاصطناعي المتقدمة على إعدادات أكثر تواضعًا.

لماذا Ollama؟

برزت Ollama كواحدة من أكثر الحلول شعبية لتشغيل نماذج اللغة الكبيرة محليًا لأنها:

- تبسط عملية تثبيت وإدارة نماذج الذكاء الاصطناعي المعقدة

- تتعامل تلقائيًا مع تنزيل النماذج وبدء التشغيل

- تحسن أداء النماذج وفقًا لمعداتك المحددة

- توفر واجهة سهلة الاستخدام للتفاعل مع النماذج

- تدعم مجموعة واسعة من النماذج إلى جانب DeepSeek فقط

متطلبات النظام

قبل أن تبدأ، يجب أن تفهم أن تشغيل نماذج الذكاء الاصطناعي محليًا يتطلب موارد حسابية كبيرة. تختلف المتطلبات بناءً على أي إصدار من DeepSeek-R1 تخطط لاستخدامه:

- للنماذج الأصغر (1.5B، 7B، أو 8B): معالج حديث بذاكرة وصول عشوائي (RAM) لا تقل عن 16 جيجابايت ويفضل وجود بطاقة رسومات جيدة بسعة 8 جيجابايت أو أكثر

- للنماذج المتوسطة (14B، 32B): يُوصى باستخدام بطاقة رسومات قوية بسعة 16-24 جيجابايت

- للنماذج الأكبر (70B): بطاقات رسومات من الفئة العليا بسعة 40 جيجابايت أو أكثر أو عدة بطاقات رسومات

- للنموذج الكامل 671B: أجهزة ذات معايير تجارية مزودة بعدة بطاقات رسومات قوية

تشمل أنظمة التشغيل المدعومة macOS وLinux وWindows.

دليل التثبيت خطوة بخطوة

الخطوة 1: تثبيت Ollama

أولاً، دعونا نقوم بتشغيل Ollama على نظامك.

لـ macOS وLinux:

curl -fsSL https://ollama.com/install.sh | sh

لنظام Windows:

قم بتنزيل المثبت من الموقع الرسمي لـ Ollama واتبع معالج التثبيت.

بعد التثبيت، تحقق من أن Ollama تعمل بشكل صحيح:

ollama --version

الخطوة 2: تنزيل وتشغيل DeepSeek-R1

بمجرد تثبيت Ollama، يمكنك تنزيل وتشغيل DeepSeek-R1 باستخدام أمر واحد. اختر حجم النموذج المناسب بناءً على قدرات جهازك:

لأنظمة المستوى المبتدئ (إصدار 1.5B، تنزيل 1.1GB):

ollama run deepseek-r1:1.5b

لأنظمة المستوى المتوسط (إصدار 7B، تنزيل 4.7GB):

ollama run deepseek-r1:7b

لأنظمة أفضل (إصدار 8B بناءً على Llama، تنزيل 4.9GB):

ollama run deepseek-r1:8b

لأنظمة عالية الأداء (إصدار 14B، تنزيل 9.0GB):

ollama run deepseek-r1:14b

لأنظمة قوية جدًا (إصدار 32B، تنزيل 20GB):

ollama run deepseek-r1:32b

لأجهزة من الفئة التجارية (إصدار 70B، تنزيل 43GB):

ollama run deepseek-r1:70b

لتجمعات البحث (نموذج كامل 671B، تنزيل 404GB):

ollama run deepseek-r1:671b

عند تشغيل هذه الأوامر لأول مرة، ستقوم Ollama تلقائيًا بتنزيل وإعداد النموذج. قد يستغرق ذلك بعض الوقت بناءً على سرعة الإنترنت لديك وحجم النموذج.

الخطوة 3: التفاعل مع DeepSeek-R1

بمجرد تحميل النموذج، ستظهر لك واجهة سطر الأوامر حيث يمكنك البدء في التفاعل مع DeepSeek-R1. ببساطة اكتب استفساراتك واضغط على Enter.

>>> ما هي الفروقات الرئيسية بين التعلم تحت الإشراف وبدون إشراف؟

ستقوم DeepSeek-R1 بمعالجة استفسارك وتقديم استجابة بناءً على تدريبها.

الخطوة 4: الاستخدام المتقدم

تقدم Ollama العديد من الميزات المتقدمة التي يمكن أن تعزز تجربتك مع DeepSeek-R1:

معلمات مخصصة:

ollama run deepseek-r1:8b --temperature 0.7 --top-p 0.9

استخدام API:

توفر Ollama أيضًا واجهة برمجة تطبيقات HTTP تسمح لك بدمج النموذج في تطبيقاتك:

curl -X POST http://localhost:11434/api/generate -d '{

"model": "deepseek-r1:8b",

"prompt": "اشرح الحوسبة الكمومية بمصطلحات بسيطة",

"stream": false

}'

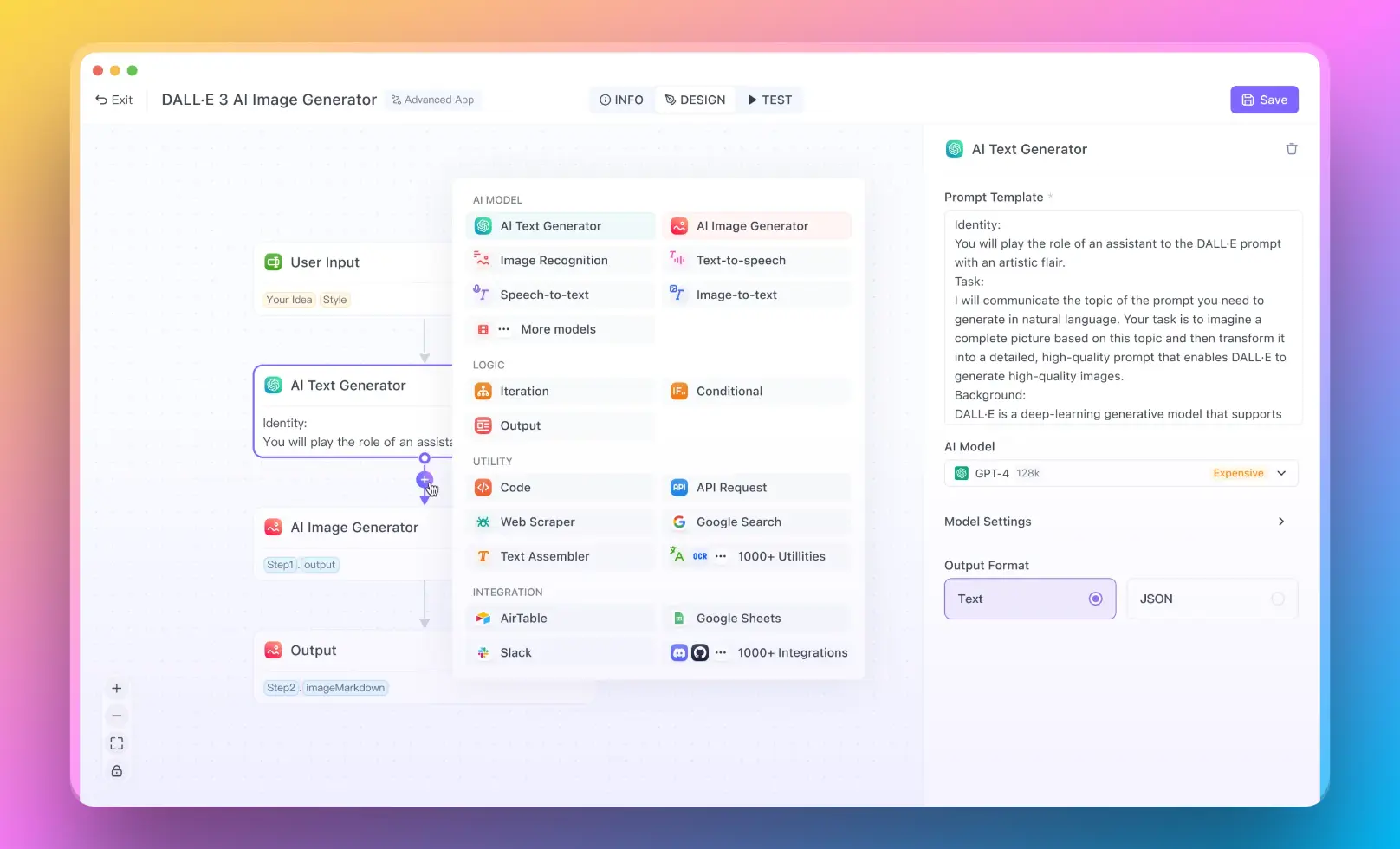

استخدام Anakin AI: بديل قوي

بينما يوفر تشغيل النماذج محليًا باستخدام Ollama تحكمًا وخصوصية كبيرة، إلا أنه يتطلب موارد حسابية كبيرة وإعدادًا تقنيًا. بالنسبة للعديد من المستخدمين، وخاصة أولئك الذين ليس لديهم إمكانية الوصول إلى أجهزة قوية، يوفر Anakin AI بديلاً ممتازًا يتيح لك تجربة DeepSeek ونماذج قوية أخرى دون تعقيد التثبيت المحلي.

Anakin AI هي منصة شاملة تقدم:

- وصول فوري: استخدم DeepSeek ونماذج قوية أخرى مباشرة في متصفحك دون تنزيل أو تثبيت أي شيء.

- واجهة مستخدم سهلة: واجهة محادثة نظيفة وبديهية تجعل التفاعل مع نماذج الذكاء الاصطناعي بسيطًا ومباشرًا.

- دعم نماذج متعددة: الوصول ليس فقط إلى DeepSeek ولكن مجموعة واسعة من النماذج الأخرى مثل Llama وMistral وDolphin وغيرها من نماذج LLM مفتوحة المصدر.

- لا قيود على الأجهزة: إجراء محادثات مع نماذج كبيرة حتى على أجهزة بسيطة مثل أجهزة الكمبيوتر المحمولة أو الأجهزة اللوحية.

- محادثات مستمرة: يتم حفظ وتنظيم كل محادثاتك، مما يسهل الرجوع إلى التفاعلات السابقة.

- ميزات متقدمة: إنشاء تطبيقات ذكاء اصطناعي، والتكامل مع بياناتك، وبناء سير العمل المخصصة.

للبدء مع Anakin AI، ببساطة:

- زيارة https://anakin.ai

- إنشاء حساب أو تسجيل الدخول

- اختيار DeepSeek من النماذج المتاحة

- بدء المحادثة على الفور دون أي إعداد

هذا النهج مفيد بشكل خاص لـ:

- المستخدمين الذين لديهم موارد أجهزة محدودة

- أولئك الذين يحتاجون إلى وصول سريع دون إعداد تقني

- الفرق الراغبة في التعاون باستخدام نفس بنية الذكاء الاصطناعي

- المطورين الذين يختبرون نماذج مختلفة قبل النشر محليًا

نصائح تحسين الأداء

إذا كنت تقوم بتشغيل DeepSeek محليًا باستخدام Ollama، فإليك بعض النصائح لتحسين الأداء:

- تسريع GPU: تأكد من تحديث تعريفات بطاقة الرسوميات لديك وتكوينها بشكل صحيح لتحقيق أقصى أداء.

- إدارة الذاكرة: أغلق التطبيقات غير الضرورية عند تشغيل النماذج الكبيرة لتحرير موارد النظام.

- تكميم البيانات: تقوم Ollama تلقائيًا بتطبيق التكميم لتقليل استخدام الذاكرة، لكن يمكنك تجربة إعدادات التكميم المختلفة حسب احتياجاتك المحددة.

- إدارة نافذة السياق: كن واعيًا لطول العناوين والاستجابات، حيث يمكن أن تستهلك المحادثات الطويلة جدًا المزيد من الذاكرة وتبطئ الاستجابات.

- التبريد: تشغيل نماذج الذكاء الاصطناعي يمكن أن يكون مكثفاً من الناحية الحسابية وينتج حرارة. تأكد من أن نظامك مزود بتبريد مناسب لمنع انحدار الأداء الحراري.

بناء تطبيقات باستخدام DeepSeek-R1

بعيدًا عن تفاعلات الدردشة البسيطة، يمكن دمج DeepSeek-R1 في تطبيقات مختلفة:

توليد وتحليل الشفرات:

تتفوق DeepSeek-R1 في المهام المتعلقة بالشيفرات، مما يجعلها ذات قيمة للمطورين الذين يرغبون في:

- توليد مقتطفات الشيفرات بناءً على المتطلبات

- تصحيح الشيفرات الموجودة

- تحسين الخوارزميات

- ترجمة بين لغات البرمجة

البحث والتحليل:

تجعل قدرات النموذج في الاستدلال مناسبة تمامًا لـ:

- تلخيص الأوراق الأكاديمية

- تحليل اتجاهات البيانات

- توليد فرضيات

- إنشاء تقارير منظمة

إنشاء المحتوى:

استخدم DeepSeek-R1 لـ:

- كتابة وتحرير المقالات

- إنشاء نصوص تسويقية

- توليد محتوى إبداعي

- ترجمة بين اللغات

الخاتمة

تشغيل DeepSeek-R1 محليًا باستخدام Ollama يمثل خطوة كبيرة نحو ديمقراطية الوصول إلى نماذج الذكاء الاصطناعي القوية. تتيح لك هذه الطريقة السيطرة الكاملة على بياناتك وتفاعلاتك مع الاستفادة من قدرات معالجة اللغة الحديثة. اعتمادًا على موارد أجهزتك ومستوى راحتك الفني، يمكنك الاختيار بين تشغيل النموذج محليًا عبر Ollama أو الوصول إليه عبر منصات سهلة الاستخدام مثل Anakin AI.

بينما تواصل تقنية الذكاء الاصطناعي التطور، ستصبح القدرة على تشغيل هذه النماذج محليًا أكثر أهمية للأفراد المتقيدين بالخصوصية، والمطورين الذين يعملون مع بيانات حساسة، والمؤسسات التي تسعى لبناء تطبيقات خاصة دون الاعتماد على واجهات برمجة التطبيقات الخارجية.

سواء كنت مطورًا تبني الجيل المقبل من التطبيقات المعتمدة على الذكاء الاصطناعي، باحثًا تستكشف قدرات نماذج اللغة الكبيرة، أو ببساطة متحمسًا مهتمًا بتجربة تقنيات الذكاء الاصطناعي الحديثة، فإن DeepSeek-R1 مع Ollama توفر لك حلًا قويًا ومرنًا يضع قدرات الذكاء الاصطناعي المتقدمة مباشرة بين يديك.

مع الإعداد والموارد الصحيحة، يمكنك استغلال قوة DeepSeek-R1 في كل شيء من توليد النصوص البسيطة إلى مهام الاستدلال المعقدة، كل ذلك أثناء الحفاظ على السيطرة الكاملة على بياناتك وموارد الحوسبة لديك. ولتلك الأوقات التي قد لا يكون فيها الحوسبة المحلية عملية، تذكر أن حلول مثل Anakin AI توفر بدائل مريحة تجعل القوة من نماذج الذكاء الاصطناعي المتقدمة على بعد بضع نقرات فقط.