Here is the translation of the provided HTML code into German: ```html

Während sich die Technologie weiterhin entwickelt, hat die Integration von maschinellem Lernen mit benutzerfreundlichen APIs spannende Möglichkeiten für Entwickler und Enthusiasten eröffnet. Eine solche Entwicklung ist das Laden eines lokalen Bildes in die Vision-Funktionen von GPT-4. Im Bereich der künstlichen Intelligenz bietet die Bildverarbeitung eine Vielzahl von Möglichkeiten, von der Erkennung über das Verständnis von Kontext bis hin zur Generierung von Antworten basierend auf visuellen Eingaben. In diesem Artikel werden wir erkunden, wie man effektiv ein lokales Bild in GPT-4 über seine API lädt und somit eine reibungslose Integration in deine Projekte sicherstellt.

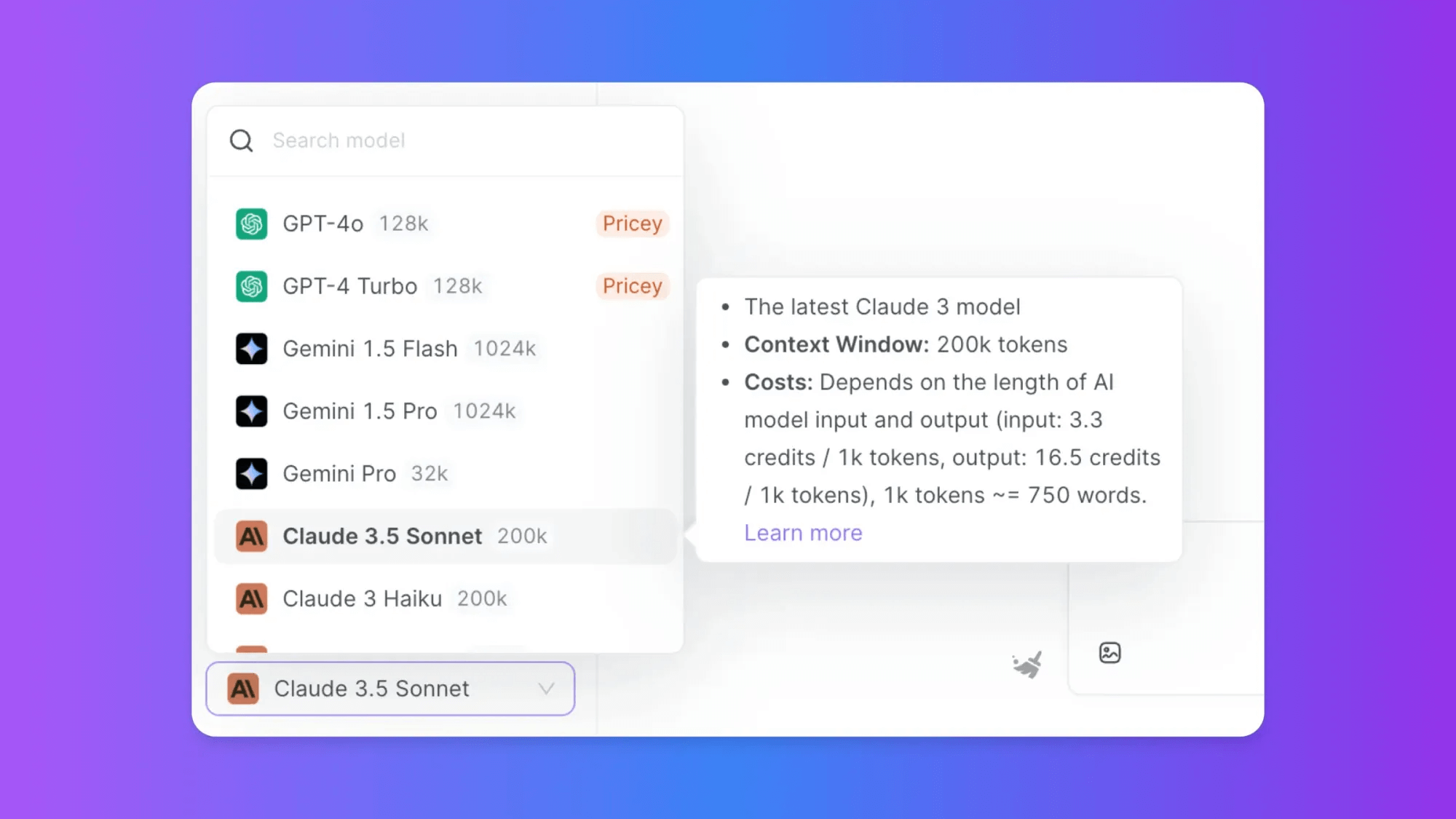

Suchst du nach einer AI-Plattform, die dir Zugang zu jedem AI-Modell mit einem All-in-One-Preis bietet?

Dann darfst du Anakin AI nicht verpassen!

Anakin AI ist eine All-in-One-Plattform für alle deine Workflow-Automatisierungen, erstelle beeindruckende AI-Apps mit einem einfach zu bedienenden No-Code-App-Builder, mit Llama 3, Claude, GPT-4, Unzensierte LLMs, Stable Diffusion...

Baue deine Traum-AI-App innerhalb von Minuten, nicht Wochen mit Anakin AI!

Verstehen von GPT-4 und seinen Vision-Funktionen

Bevor wir in die technischen Aspekte des Ladens eines lokalen Bildes in GPT-4 eintauchen, lass uns einen Moment Zeit nehmen, um zu verstehen, was GPT-4 ist und wie seine Vision-Funktionen funktionieren:

Was ist GPT-4?

Entwickelt von OpenAI, stellt GPT-4 die neueste Iteration der Serie der Generativen Vortrainierten Transformatoren dar. Es verbessert die Fähigkeiten seines Vorgängers durch die Integration einer anspruchsvollen Bildverarbeitung, die es Nutzern ermöglicht, sowohl mit Text- als auch mit visuellen Daten zu interagieren.

Vision-Funktionen:

Mit der Integration von Vision-Funktionen kann GPT-4 jetzt Bilder analysieren und interpretieren, was eine breite Palette von Anwendungen ermöglicht, darunter:

- Bildklassifizierung

- Objekterkennung

- Szenenverständnis

- Textextraktion aus Bildern

Diese Fähigkeiten ermöglichen es Entwicklern, innovative Anwendungen zu erstellen, die auf Anfragen mit Bildern reagieren können. Jetzt stellt sich die Frage: Wie laden wir ein lokales Bild in GPT-4?

Einrichten deiner Umgebung

Das Laden eines lokalen Bildes in GPT-4 erfordert einige erste Schritte zur Vorbereitung deiner Programmierumgebung. Nachfolgend sind die wichtigen Komponenten aufgeführt, die du eingerichtet haben musst, bevor wir in den Code eintauchen.

Programmiersprache:

Obwohl du verschiedene Programmiersprachen verwenden kannst, ist Python aufgrund seiner Einfachheit und umfangreichen Bibliotheken, die für die Arbeit mit APIs geeignet sind, die gängigste.

API-Schlüssel:

Du benötigst Zugang zur OpenAI API. Melde dich auf der Website von OpenAI an, um deinen einzigartigen API-Schlüssel zu erhalten.

Einrichtungsumgebung:

- Installiere notwendige Bibliotheken, wie

requestsundPillow. Du kannst diese ganz einfach mit pip einrichten:

pip installieren requests Pillow

Laden eines lokalen Bildes in GPT-4 über die API

Sobald deine Umgebung bereit ist, ist es an der Zeit, ein lokales Bild in GPT-4 zu laden. Nachfolgend sind die Schritte klar und verständlich beschrieben.

Schritt 1: Erforderliche Bibliotheken importieren

Starte dein Python-Skript, indem du die notwendigen Bibliotheken importierst:

import requests

from PIL import Image

import io

Schritt 2: Öffne das lokale Bild

Als nächstes möchtest du die lokale Bilddatei öffnen, die du hochladen möchtest. Stelle sicher, dass sich dein Bild in einem von der API unterstützten Format (JPEG, PNG usw.) befindet.

image_path = 'your_image_path_here.jpg' # Ändere dies zu deinem lokalen Bildpfad

with open(image_path, 'rb') as image_file:

image_data = image_file.read()

Schritt 3: Bereite deine API-Anfrage vor

Erstelle die Struktur der API-Anfrage, um dein lokales Bild an GPT-4 zur Verarbeitung zu senden. Du wirst die requests Bibliothek verwenden, um dies zu erleichtern.

API_URL = 'https://api.openai.com/v1/images/gpt-4-vision' # Anpassen entsprechend der aktuellen Dokumentation

headers = {

'Authorization': f'Bearer DEIN_API_SCHLÜSSEL', # Ersetze dies durch deinen tatsächlichen API-Schlüssel

'Content-Type': 'application/json',

}

data = {

'image': image_data,

}

Schritt 4: Sende die Anfrage

Nachdem du deine API-Anfrage vorbereitet hast, ist es Zeit, sie zu senden und die Antwort zu erfassen.

response = requests.post(API_URL, headers=headers, json=data)

Schritt 5: Bearbeite die Antwort

Nachdem du deine Anfrage gesendet hast, erhältst du eine Antwort. Du möchtest dies korrekt behandeln, um die Informationen, an denen du interessiert bist, zu extrahieren.

if response.status_code == 200:

result = response.json()

print("Antwort:", result)

else:

print("Fehler:", response.status_code, response.text)

Vollständiger Beispielcode

Um alles zusammenzubringen, so sollte dein vollständiges Skript aussehen:

import requests

from PIL import Image

import io

image_path = 'your_image_path_here.jpg' # Ändere dies zu deinem lokalen Bildpfad

API_URL = 'https://api.openai.com/v1/images/gpt-4-vision' # Anpassen entsprechend der aktuellen Dokumentation

headers = {

'Authorization': f'Bearer DEIN_API_SCHLÜSSEL', # Ersetze dies durch deinen tatsächlichen API-Schlüssel

'Content-Type': 'application/json',

}

with open(image_path, 'rb') as image_file:

image_data = image_file.read()

data = {

'image': image_data,

}

response = requests.post(API_URL, headers=headers, json=data)

if response.status_code == 200:

result = response.json()

print("Antwort:", result)

else:

print("Fehler:", response.status_code, response.text)

Wichtige Überlegungen beim Laden eines lokalen Bildes in GPT-4

Beim Laden eines lokalen Bildes in GPT-4 ist es wichtig, einige Faktoren zu berücksichtigen, um deinen Erfolg zu maximieren:

Dateigröße und Format:

Stelle sicher, dass dein Bild nicht zu groß ist und in einem unterstützten Format (JPEG oder PNG) vorliegt. Dies hilft, Probleme mit API-Grenzen und Verarbeitung zu vermeiden.

API-Durchsatzbegrenzungen:

Beachte deine API-Nutzungsgrenzen. Überschreitungen der zulässigen Anfragen können zu Unterbrechungen des Dienstes führen.

Fehlerbehandlung:

Implementiere eine robuste Fehlerbehandlung, um alle Probleme beim Laden von Bildern oder API-Anfragen zu erfassen. Dies ist in Produktionsumgebungen von entscheidender Bedeutung.

Häufig gestellte Fragen

F1: Kann ich ein beliebiges Bildformat verwenden, um ein lokales Bild in GPT-4 zu laden?

A1: Nein, du solltest JPEG- oder PNG-Formate verwenden, da diese typischerweise von der GPT-4 API unterstützt werden.

F2: Wie finde ich meinen OpenAI API-Schlüssel?

A2: Du kannst deinen API-Schlüssel erhalten, indem du dich auf der OpenAI-Website anmeldest und deine Kontoeinstellungen oder den API-Bereich besuchst.

F3: Was soll ich tun, wenn die API-Antwort einen Fehler anzeigt?

A3: Überprüfe den Statuscode und lese die Fehlermeldung, die mit der Antwort zurückgegeben wurde. Passe deine Anfrage entsprechend an oder überprüfe die API-Dokumentation für weitere Fehlerbehebungsschritte.

F4: Gibt es eine Begrenzung für die Größe des Bildes, das ich hochladen kann?

A4: Ja, die OpenAI API hat Begrenzungen für die Größe von Bildern und die Anzahl der Anfragen pro Minute. Siehe die API-Dokumentation für aktuelle Begrenzungen.

F5: Wie kann ich die Genauigkeit der Antworten von GPT-4 mit Bildern verbessern?

A5: Stelle sicher, dass du klare, hochwertige Bilder bereitstellst, die relevante Inhalte enthalten. Je klarer das Bild, desto besser die Verarbeitung und Antwort von der API.

Indem du die in diesem Artikel dargelegten strukturierten Schritte befolgst, kannst du leicht ein lokales Bild in GPT-4 laden und von seinen ausgeklügelten Vision-Funktionen profitieren. Die Integration von Bildverarbeitung mit maschinellem Lernen bietet endlose Möglichkeiten, und mit GPT-4 sieht die Zukunft der AI-gestützten Anwendungen vielversprechend aus.

Fazit

In einer Ära, in der die Technologie kontinuierlich unsere Interaktionen mit künstlicher Intelligenz umgestaltet, bieten die Integration von Bildverarbeitungsfähigkeiten in Modelle wie GPT-4 unvergleichliche Möglichkeiten für Entwickler. Dieser Artikel hat dich durch den Prozess des Ladens eines lokalen Bildes in GPT-4 geleitet und wesentliche Setups, effiziente Programmierpraktiken und wichtige Überlegungen zur Optimierung deiner API-Nutzung behandelt.

Durch die Nutzung der Vision-Funktionen von GPT-4 kannst du innovative Anwendungen erstellen, die Bilder analysieren und interpretieren, was letztlich das Nutzererlebnis in verschiedenen Bereichen verbessert. Ob für Bildklassifizierung, Objekterkennung oder Szenenverständnis, die potenziellen Anwendungen sind umfangreich und vielfältig.

Wenn du dich auf deine Reise begibst, um die Vision-Funktionen von GPT-4 zu erkunden, denke an die Bedeutung der Verwendung von hochwertigen Bildern und der Einhaltung der API-Richtlinien für optimale Leistung. Die Möglichkeiten sind grenzenlos – tauche ein, experimentiere und entdecke neue Höhen in deinen AI-Projekten! Mit den richtigen Werkzeugen, dem Wissen und der Kreativität kannst du einen erheblichen Einfluss auf die Zukunft von AI-gestützten Anwendungen zur Bildverarbeitung nehmen.

``` Feel free to adjust any specific phrasing or terminology according to the context in which this translation will be used.