Entonces, ¡no puedes perderte Anakin AI!

Anakin AI es una plataforma todo en uno para toda tu automatización de flujo de trabajo, crea una poderosa aplicación de IA con un creador de aplicaciones sin código fácil de usar, con Deepseek, o3-mini-high de OpenAI, Claude 3.7 Sonnet, FLUX, Minimax Video, Hunyuan...

¡Construye tu aplicación de IA soñada en minutos, no en semanas, con Anakin AI!

Introducción

La inteligencia artificial ha avanzado notablemente en los últimos años, con modelos de lenguaje potentes volviéndose cada vez más accesibles para usuarios cotidianos. DeepSeek R1, desarrollado por DeepSeek, representa uno de los modelos de IA de código abierto más avanzados disponibles hoy en día. Lo que hace que DeepSeek R1 sea particularmente impresionante es su capacidad para igualar a modelos comerciales como el o1 de OpenAI y Claude 3.5 Sonnet en tareas de matemáticas, programación y razonamiento, mientras está disponible para uso local.

En este tutorial completo, te guiaremos a través del proceso de descargar y ejecutar DeepSeek R1 localmente en tu PC. También te presentaremos Anakin AI, una poderosa plataforma que ofrece una forma alternativa de aprovechar las capacidades de DeepSeek sin la sobrecarga técnica de la instalación local.

Entendiendo DeepSeek R1

DeepSeek R1 es la serie de modelos de razonamiento de primera generación de DeepSeek, disponible en múltiples tamaños para adaptarse a diferentes configuraciones de hardware. Desde versiones destiladas más pequeñas hasta el modelo completo de 671B parámetros, DeepSeek R1 proporciona flexibilidad para usuarios con recursos computacionales variados. El modelo está licenciado bajo MIT, lo que permite tanto aplicaciones personales como comerciales.

DeepSeek R1 destaca en:

- Generación de texto: Creación de artículos, resúmenes y contenido creativo

- Asistencia de código: Generación y depuración de código en múltiples lenguajes de programación

- Comprensión del lenguaje natural: Interpretación de la entrada humana con comprensión matizada

- Respuesta a preguntas: Proporcionar respuestas informativas basadas en contextos

Requisitos del sistema

Antes de intentar ejecutar DeepSeek R1 localmente, asegúrate de que tu sistema cumpla con los requisitos necesarios. Estos varían dependiendo de qué versión del modelo planeas usar:

- Para modelos más pequeños (1.5B, 7B o 8B): CPU moderna con al menos 16GB de RAM y preferiblemente una GPU con 8GB+ de VRAM

- Para modelos medianos (14B, 32B): GPU potente con 16-24GB de VRAM

- Para modelos más grandes (70B): GPUs de alta gama con 40GB+ de VRAM o múltiples GPUs

- Para el modelo completo de 671B: Hardware de nivel empresarial con múltiples GPUs poderosas

DeepSeek R1 es compatible con sistemas operativos macOS, Linux y Windows.

Usar Ollama para Ejecutar DeepSeek R1 Localmente

Ollama se ha convertido en una de las soluciones más populares para ejecutar grandes modelos de lenguaje localmente. Simplifica el proceso al manejar descargas de modelos, inicialización y optimización para tu hardware específico.

Paso 1: Instalar Ollama

Primero, instalemos Ollama en tu sistema:

Para macOS:

brew install ollama

Si Homebrew no está instalado, visita brew.sh y sigue las instrucciones de configuración.

Para Windows: Descarga Ollama desde el sitio web oficial y sigue el asistente de instalación.

Para Linux:

curl -fsSL <https://ollama.com/install.sh> | sh

Después de la instalación, verifica que Ollama esté funcionando correctamente:

ollama --version

Paso 2: Descargar DeepSeek R1

Una vez que Ollama esté instalado, puedes descargar DeepSeek R1 con un simple comando. Elige el tamaño de modelo apropiado según las capacidades de tu hardware:

ollama pull deepseek-r1

Para una versión más pequeña, especifica el tamaño del modelo:

ollama pull deepseek-r1:1.5b

Otros tamaños disponibles incluyen:

deepseek-r1:7b(4.7GB de descarga)deepseek-r1:8b(4.9GB de descarga)deepseek-r1:14b(9.0GB de descarga)deepseek-r1:32b(20GB de descarga)deepseek-r1:70b(43GB de descarga)deepseek-r1:671b(404GB de descarga - requiere hardware empresarial)

Paso 3: Iniciar el Modelo

Después de descargar el modelo, inicia el servidor de Ollama:

ollama serve

Luego, ejecuta DeepSeek R1:

ollama run deepseek-r1

O, para usar una versión específica:

ollama run deepseek-r1:1.5b

Paso 4: Interactuando con DeepSeek R1

Con el modelo en funcionamiento, ahora puedes interactuar con él en la terminal. Simplemente escribe tus consultas y presiona Enter:

>>> ¿Qué es una clase en C++?

DeepSeek R1 procesará tu consulta y proporcionará una respuesta detallada basada en su entrenamiento.

Uso Avanzado con Ollama

Ollama ofrece varias características avanzadas para mejorar tu experiencia con DeepSeek R1:

Parámetros Personalizados

Puedes personalizar el comportamiento del modelo con parámetros como temperatura y top-p:

ollama run deepseek-r1:8b --temperature 0.7 --top-p 0.9

Usando la API

Ollama proporciona una API HTTP que te permite integrar el modelo en tus aplicaciones:

curl -X POST <http://localhost:11434/api/generate> -d '{

"model": "deepseek-r1:8b",

"prompt": "Explica la computación cuántica en términos simples",

"stream": false

}'

Consejos para Optimización de Rendimiento

Para obtener el mejor rendimiento al ejecutar DeepSeek R1 localmente:

- Aceleración de GPU: Asegúrate de que los controladores de tu GPU estén actualizados y correctamente configurados.

- Gestión de Memoria: Cierra aplicaciones innecesarias al ejecutar modelos más grandes.

- Cuantización: Experimenta con diferentes configuraciones de cuantización según tus necesidades específicas.

- Gestión de Ventanas de Contexto: Ten en cuenta tus longitudes de prompts y respuestas para optimizar el uso de memoria.

- Refrigeración: Asegúrate de que tu sistema tenga una refrigeración adecuada para evitar el estrangulamiento térmico.

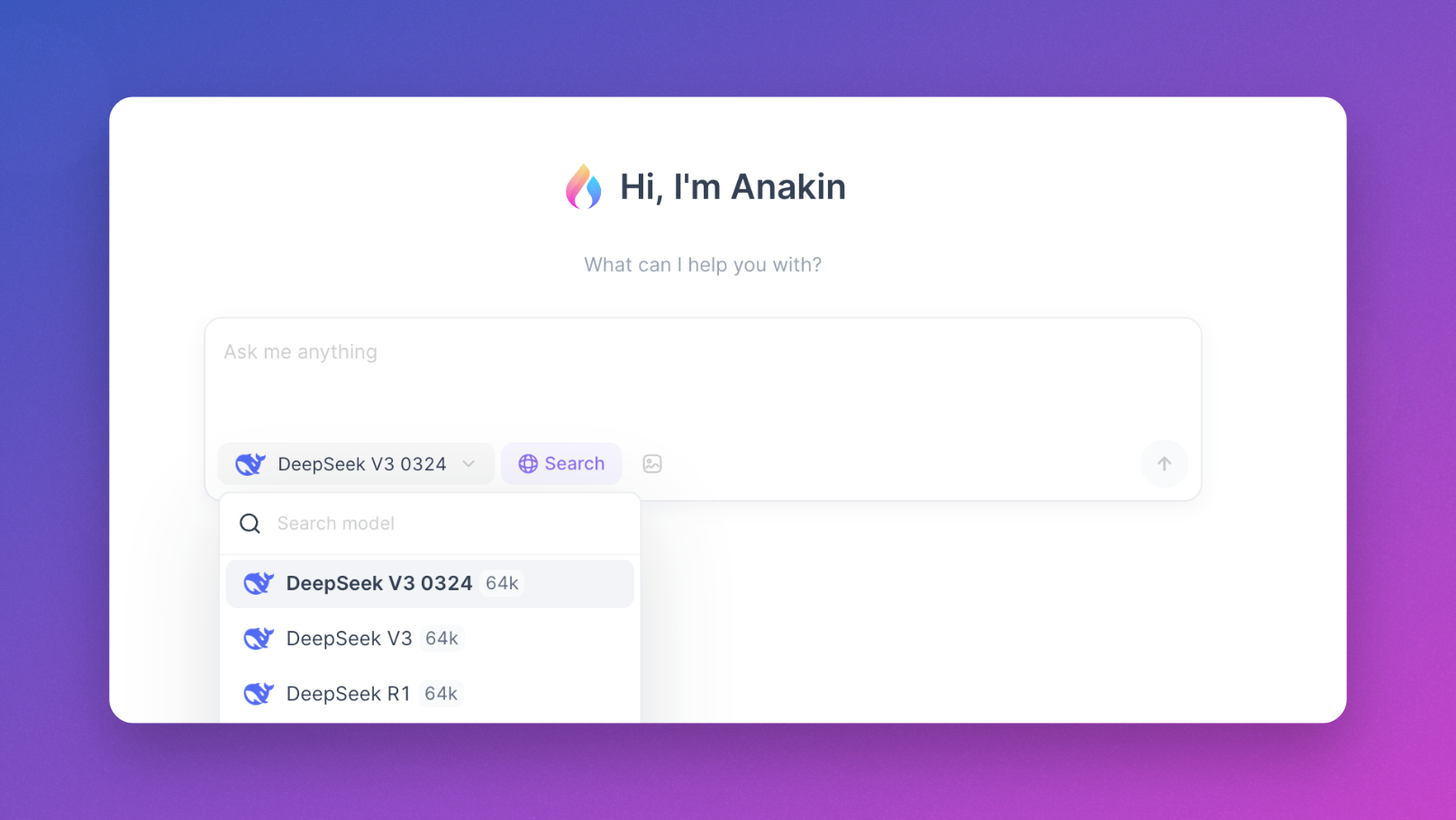

Usar Anakin AI: Una Alternativa Poderosa

Si bien ejecutar modelos localmente con Ollama ofrece un gran control y privacidad, requiere recursos computacionales significativos y configuración técnica. Para muchos usuarios, especialmente aquellos sin acceso a hardware potente, Anakin AI proporciona una excelente alternativa que te permite experimentar con DeepSeek y otros modelos poderosos sin la complejidad de las instalaciones locales.

¿Qué es Anakin AI?

Anakin AI es una plataforma todo en uno que ofrece:

- Acceso Inmediato: Usa DeepSeek y otros modelos poderosos directamente en tu navegador sin descargar ni instalar nada.

- Interfaz Amigable: Una interfaz de chat limpia e intuitiva que facilita la interacción con modelos de IA.

- Soporte para Múltiples Modelos: Acceso no solo a DeepSeek, sino también a Llama, Mistral, Dolphin y muchos más LLM de código abierto.

- Sin Limitaciones de Hardware: Realiza conversaciones con modelos grandes incluso en hardware modesto como laptops o tablets.

- Conversaciones Persistentes: Todas tus conversaciones se guardan y organizan para fácil referencia.

- Características Avanzadas: Crea aplicaciones de IA, integra tus datos y construye flujos de trabajo personalizados.

Introducción a Anakin AI

Para comenzar a usar DeepSeek R1 a través de Anakin AI:

- Visita https://anakin.ai

- Crea una cuenta o inicia sesión

- Selecciona DeepSeek de los modelos disponibles

- Comienza a chatear de inmediato sin ninguna configuración

Beneficios de Usar Anakin AI

Anakin AI es particularmente beneficioso para:

- Usuarios con recursos de hardware limitados

- Quienes necesitan acceso rápido sin configuración técnica

- Equipos que desean colaborar usando la misma infraestructura de IA

- Desarrolladores que prueban diferentes modelos antes de implementarlos localmente

Anakin AI también ofrece la capacidad de crear flujos de trabajo de IA sin conocimientos de codificación, lo que lo convierte en una opción accesible para usuarios de todos los antecedentes técnicos.

Construcción de Aplicaciones con DeepSeek R1

Más allá de interacciones simples por chat, DeepSeek R1 puede integrarse en varias aplicaciones:

Generación y Análisis de Código

DeepSeek R1 destaca en tareas relacionadas con el código, lo que lo hace valioso para desarrolladores que desean:

- Generar fragmentos de código según requisitos

- Depurar código existente

- Optimizar algoritmos

- Traducir entre lenguajes de programación

Investigación y Análisis

Las capacidades de razonamiento del modelo lo hacen adecuado para:

- Resumir artículos académicos

- Analizar tendencias de datos

- Generar hipótesis

- Crear informes estructurados

Creación de Contenido

Usa DeepSeek R1 para:

- Escribir y editar artículos

- Crear textos de marketing

- Generar contenido creativo

- Traducir entre idiomas

Conclusión

Ejecutar DeepSeek R1 localmente con Ollama representa un avance significativo en la democratización del acceso a poderosos modelos de IA. Este enfoque te da control total sobre tus datos e interacciones mientras aprovechas capacidades avanzadas de procesamiento del lenguaje.

Dependiendo de tus recursos de hardware y tu nivel de comodidad técnica, puedes elegir entre ejecutar el modelo localmente a través de Ollama o acceder a él a través de plataformas fáciles de usar como Anakin AI. Ambos enfoques tienen sus méritos:

- Instalación local con Ollama: Máxima privacidad, control y personalización, pero requiere hardware adecuado

- Anakin AI: Acceso inmediato, sin limitaciones de hardware, interfaz fácil de usar y capacidades de flujo de trabajo adicionales

Ya sea que seas un desarrollador construyendo la próxima generación de aplicaciones impulsadas por IA, un investigador explorando las capacidades de grandes modelos de lenguaje, o simplemente un entusiasta interesado en experimentar IA de vanguardia, DeepSeek R1 ofrece capacidades impresionantes que anteriormente solo estaban disponibles a través de servicios propietarios.

Siguiendo esta guía, ahora tienes el conocimiento para ejecutar DeepSeek R1 localmente usando Ollama o acceder a él a través de Anakin AI, dependiendo de tus necesidades y recursos específicos. ¡El poder de la IA avanzada está ahora al alcance de tu mano!