DeepSeek V3-0324 es un punto de control actualizado del modelo DeepSeek V3, con su fecha de lanzamiento, 24 de marzo de 2025, incorporada en su nombre. Las discusiones iniciales sugieren mejoras en las capacidades de codificación y razonamiento complejo, como se indica en artículos recientes. El modelo está disponible en GitHub DeepSeek-V3 GitHub y Hugging Face DeepSeek-V3-0324 Hugging Face, reflejando su naturaleza de código abierto y accesibilidad.

Introducción a DeepSeek V3-0324

DeepSeek V3-0324 es un modelo de lenguaje de código abierto de vanguardia desarrollado por DeepSeek AI, lanzado el 24 de marzo de 2025. Este modelo es una versión actualizada del anterior DeepSeek V3, conocido por su gran escala y eficiencia. Con 671 mil millones de parámetros totales y solo 37 mil millones activados por token, aprovecha arquitecturas avanzadas para manejar tareas complejas como codificación, razonamiento y procesamiento multilingüe. Este artículo explora su arquitectura, entrenamiento, rendimiento y potencial, ofreciendo ideas para aquellos interesados en los avances en IA.

Arquitectura del Modelo de DeepSeek V3-0324

DeepSeek V3-0324 emplea un enfoque de Mezcla de Expertos (MoE), donde múltiples redes de expertos se especializan en diferentes aspectos de los datos. Esto permite un masivo total de 671 mil millones de parámetros, con solo 37 mil millones activos por token, aumentando la eficiencia. La Atención Latente Multi-cabeza (MLA) comprime los vectores de clave y valor, reduciendo el uso de memoria y acelerando la inferencia, especialmente para contextos largos. La arquitectura DeepSeekMoE, una variante refinada de MoE, asegura un balance de carga sin términos de pérdida adicionales, estabilizando el entrenamiento. Además, el objetivo de Predicción Multi-Token (MTP) predice múltiples tokens futuros, densificando las señales de entrenamiento y permitiendo una generación más rápida a través de la decodificación especulativa.

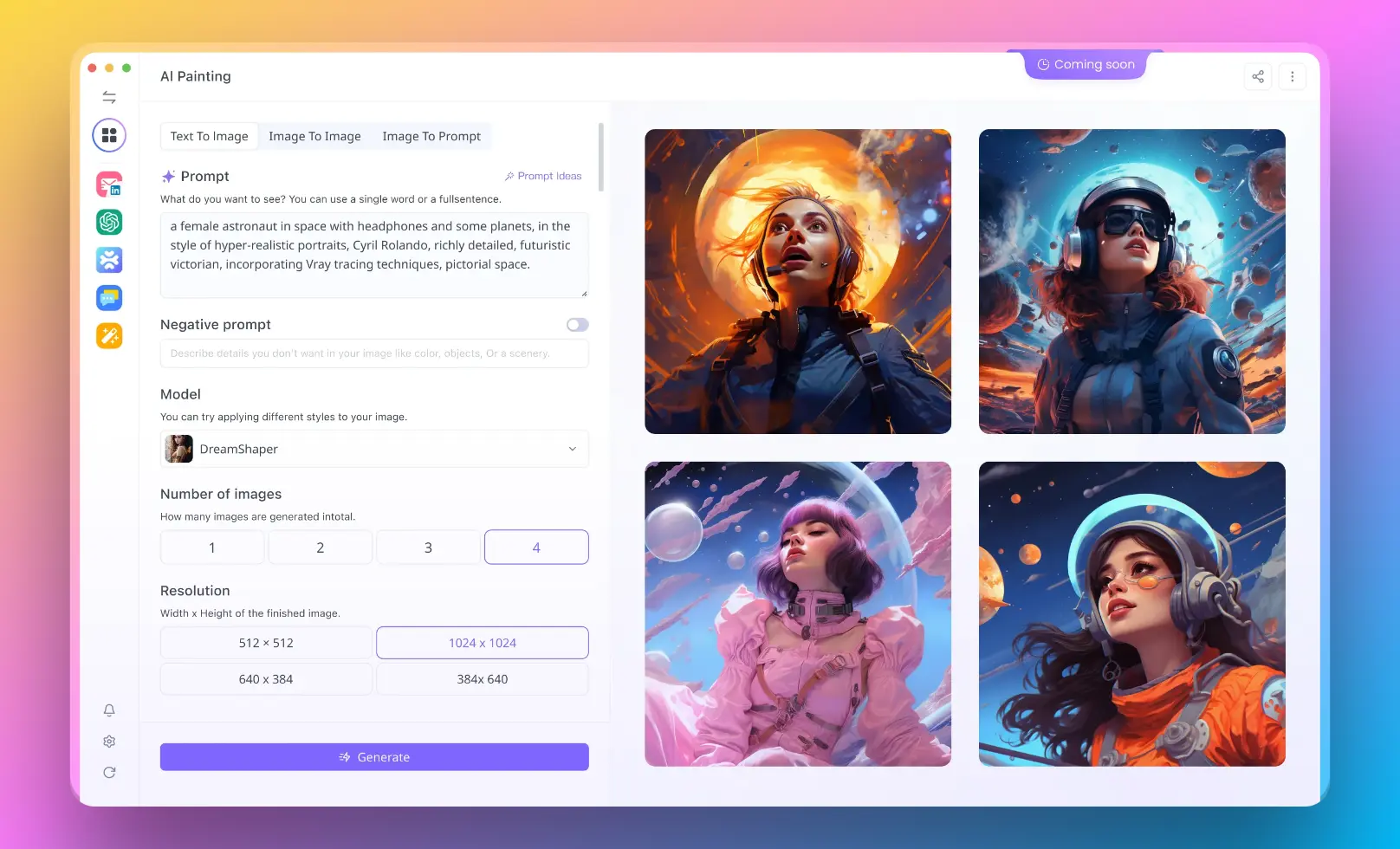

Entonces, ¡no puedes perderte Anakin AI!

Anakin AI es una plataforma todo en uno para toda tu automatización de flujo de trabajo, crea potentes aplicaciones de IA con un constructor de aplicaciones sin código fácil de usar, con Deepseek, o3-mini-high de OpenAI, Claude 3.7 Sonnet, FLUX, Minimax Video, Hunyuan...

¡Construye tu aplicación de IA de ensueño en minutos, no en semanas con Anakin AI!

El modelo fue preentrenado en 14.8 billones de tokens diversos y de alta calidad, abarcando matemáticas, programación y múltiples idiomas. Utiliza precisión mixta FP8 para eficiencia, reduciendo los costos y el tiempo de entrenamiento en comparación con los métodos tradicionales. El post-entrenamiento incluye un ajuste fino supervisado con 1.5 millones de instancias a través de dominios, mejorado por aprendizaje por refuerzo, refinando capacidades como razonamiento y generación de código. Este proceso, que costó 2.788 millones de horas de GPU H800, subraya su rentabilidad.

Rendimiento y Evaluación de DeepSeek V3-0324

DeepSeek V3-0324 destaca en varias pruebas, particularmente en codificación y razonamiento. Logra un 65.2% en HumanEval para generación de código y un 89.3% en GSM8K para matemáticas, superando muchos modelos de código abierto. En el post-entrenamiento, obtiene un 88.5% en MMLU y un 70.0% en AlpacaEval 2.0, compitiendo con modelos de código cerrado como GPT-4o y Claude-3.5-Sonnet. Su capacidad para manejar una ventana de contexto de 128K y lograr 1.8 veces Tokens Por Segundo (TPS) a través de MTP resalta su eficiencia práctica.

Esta nota de encuesta proporciona un examen detallado de DeepSeek V3-0324, un modelo de lenguaje de código abierto lanzado por DeepSeek AI el 24 de marzo de 2025. Se basa en el original DeepSeek V3, lanzado anteriormente, y se destaca por sus avances en tareas de codificación y razonamiento. Las siguientes secciones profundizarán en su arquitectura, entrenamiento, evaluación y futuras implicaciones, ofreciendo un análisis exhaustivo para investigadores y entusiastas de la IA.

Contexto y Lanzamiento

Arquitectura del Modelo

La arquitectura de DeepSeek V3-0324 se basa en el marco de Mezcla de Expertos (MoE), con 671 mil millones de parámetros totales y 37 mil millones activados por token. Este diseño, detallado en el informe técnico, permite cálculos eficientes al activar solo un subconjunto de expertos por token. La Atención Latente Multi-cabeza (MLA), como se describe en el informe, comprime los vectores de clave y valor para reducir la caché KV, mejorando la velocidad de inferencia. La arquitectura DeepSeekMoE, con 61 capas de transformadores y 256 expertos enrutados por capa de MoE, incluye una estrategia de balanceo de carga libre de pérdida auxiliar, garantizando un entrenamiento estable sin términos de pérdida adicionales. El objetivo de Predicción Multi-Token (MTP), que predice un token adicional (D=1), densifica las señales de entrenamiento y apoya la decodificación especulativa, logrando 1.8 veces Tokens Por Segundo (TPS) durante la inferencia.

| Componente de Arquitectura | Detalles |

|---|---|

| Parámetros Totales | 671B, con 37B activados por token |

| MLA | Comprime caché KV, dimensión de incrustación 7168, 128 cabezas, 128 por cabeza |

| DeepSeekMoE | 61 capas, 1 experto compartido, 256 enrutados, 8 activados por token |

| Objetivo MTP | Predice los siguientes 2 tokens, peso de pérdida 0.3 inicialmente, luego 0.1, D=1 |

Proceso de Entrenamiento

El entrenamiento involucró preentrenamiento en 14.8 billones de tokens, mejorado con muestras matemáticas, de programación y multilingües. La construcción de datos refinó la minimización de redundancias y utilizó empaquetado de documentos sin enmascaramiento de atención entre muestras, junto con una estrategia de Llenado en el Medio (FIM) a una tasa de 0.1 a través de Prefijo-Sufijo-Medio (PSM). El tokenizador, un BPE a nivel de bytes con 128K tokens, se modificó para eficiencia multilingüe. El entrenamiento de precisión mixta FP8, validado a gran escala, redujo costos, con 2.664 millones de horas de GPU H800 para el preentrenamiento, totalizando 2.788 millones para el entrenamiento completo, costando un estimado de $5.576 millones a $2 por hora de GPU. El post-entrenamiento incluyó un ajuste fino supervisado en 1.5 millones de instancias, con datos de DeepSeek-R1 para razonamiento y DeepSeek-V2.5 para no razonamiento, verificado por humanos, seguido de aprendizaje por refuerzo.

| Aspecto del Entrenamiento | Detalles |

|---|---|

| Tokens de Pre-entrenamiento | 14.8T, diversos y de alta calidad |

| Precisión | FP8 mixta, por bloques para activaciones, por bloques para pesos |

| Datos de Post-entrenamiento | 1.5M instancias, SFT y RL, los dominios incluyen razonamiento y código |

| Horas de GPU | 2.788M H800, costo total $5.576M a $2/hora de GPU |

Evaluación y Rendimiento

Los resultados de la evaluación, según el informe técnico, muestran la destreza de DeepSeek V3-0324 en varios benchmarks. Las evaluaciones de pre-entrenamiento incluyen:

| Benchmark | Métrica | Resultado | Comparación |

|---|---|---|---|

| BBH | 3-shot EM | 87.5% | Supera a Qwen2.5 72B (79.8%), LLaMA-3.1 405B (82.9%) |

| MMLU | 5-shot EM | 87.1% | Supera a DeepSeek-V2 Base (78.4%), cerca de Qwen2.5 (85.0%) |

| HumanEval | 0-shot P@1 | 65.2% | Supera a LLaMA-3.1 405B (54.9%), Qwen2.5 72B (53.0%) |

| GSM8K | 8-shot EM | 89.3% | Mejor que Qwen2.5 72B (88.3%), LLaMA-3.1 405B (83.5%) |

En el post-entrenamiento, el modelo de chat sobresale con un 88.5% en MMLU, un 70.0% en AlpacaEval 2.0, y más del 86% de tasa de victoria en Arena-Hard contra GPT-4-0314, compitiendo con modelos de código cerrado como GPT-4o y Claude-3.5-Sonnet. Su ventana de contexto de 128K y los 1.8x TPS habilitados por MTP resaltan su eficiencia práctica, con discusiones iniciales señalando habilidades de codificación mejoradas en comparación con versiones anteriores.

Aplicaciones y Direcciones Futuras

Las capacidades de DeepSeek V3-0324 sugieren aplicaciones en codificación automatizada, sistemas de razonamiento avanzados y chatbots multilingües. Su naturaleza de código abierto, bajo licencia MIT para el código, apoya el uso comercial, fomentando contribuciones de la comunidad. Las direcciones futuras pueden incluir el refinamiento de arquitecturas para contexto infinito, la mejora de la calidad de los datos y la exploración de métodos de evaluación integrales, como se sugiere en la conclusión del informe técnico.

Conclusión

DeepSeek V3-0324 representa un avance significativo en la IA de código abierto, cerrando brechas con modelos de código cerrado. Su arquitectura eficiente, entrenamiento extensivo y fuerte rendimiento lo posicionan como un líder, con el potencial de impulsar innovaciones futuras en el procesamiento del lenguaje natural.