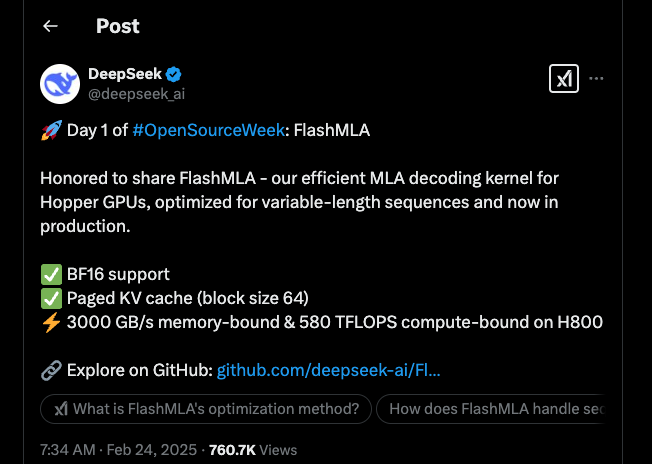

DeepSeek는 NVIDIA의 Hopper GPU를 위해 구축된 최첨단 MLA 디코딩 커널 FlashMLA를 공개하며 오픈 소스 주간을 힘차게 시작했습니다. 이 발표는 기술 커뮤니티에 큰 반향을 일으켰으며, 사람들은 이 업데이트가 AI 처리에 무엇을 의미하는지 깊이 탐구하고 싶어합니다.

매끄러운 비디오 제작 및 편집을 위한 AI의 힘을 활용하고 싶으신가요? Anakin AI가 바로 당신의 플랫폼입니다! 최신 AI 비디오 생성기 모음 — Runway ML, Minimax Video 01, Tencent Hunyuan Video 등등을 포함한 종합적인 스위트로 당신의 창의적 비전을 손쉽게 실현할 수 있습니다. 장면 변환, 시네마틱 시퀀스 생성 또는 고급 AI 모델을 사용하여 편집을 다듬는 모든 작업에서 Anakin AI가 필요한 것을 갖추고 있습니다.

🚀 오늘부터 창작을 시작하세요! AI 비디오 도구를 여기에서 탐색해보세요: Anakin AI 비디오 생성

FlashMLA란?

FlashMLA는 다중 헤드 잠재적 주의(Multi-head Latent Attention, MLA)의 디코딩 프로세스를 가속화하기 위해 설계된 전문 커널입니다. 간단히 말해, AI 모델이 가변 길이 시퀀스를 보다 효율적으로 처리하는 데 도움을 줍니다. 자연어 처리나 다른 AI 작업에 관심이 있는 경우 이 도구는 큰 파장을 일으킬 준비가 되어 있습니다.

주요 기능 및 성능

BF16 지원

FlashMLA의 가장 두드러진 특징 중 하나는 BF16(Brain Float 16) 정밀도 지원입니다. BF16을 사용함으로써 커널은 대규모 AI 모델이 요구하는 정확성을 희생하지 않으면서 메모리 사용량을 줄입니다. 사용자들은 이를 극찬하며, 중량급 계산을 처리하는 데 있어 진정한 게임 체인저라는 점을 언급했습니다.

페이지 키-값 캐시

또 다른 멋진 점은 페이지 키-값 캐시로, 블록 크기가 64입니다. 이 설정은 메모리를 효율적으로 관리하고 추론 성능을 높이는 데 도움을 줍니다. 모든 도구가 정확히 필요한 위치에 있는 잘 정리된 도구 상자를 가진 것과 같습니다.

인상적인 메트릭

성능 면에서 FlashMLA는 실망시키지 않습니다. H800 SXM5 GPU에서 메모리 제약 시나리오에서 3000 GB/s의 놀라운 속도를 기록하며, 컴퓨팅 제약 시에는 최대 580 TFLOPS에 도달합니다. 이러한 수치는 단순히 인상적인 것이 아니라, 커널 뒤에 있는 경이로운 엔지니어링의 증거입니다.

FlashMLA가 돋보이는 이유

FlashMLA는 FlashAttention 및 NVIDIA의 CUTLASS와 같은 잘 알려진 프로젝트에서 영감을 받았습니다. 효율성과 생산 준비성에 중점을 두고 구축되어, 개발자들이 자신의 워크플로에 매끄럽게 통합할 수 있도록 합니다. 커뮤니티에서는 AI 성능의 한계를 밀어붙이려는 진지한 사람이라면 반드시 필요한 도구로 여겨지고 있습니다.

통합 및 설정

시작하려는 분들은 설치가 쉽다는 것을 알게 될 것입니다. Hopper GPU, CUDA 12.3 이상 및 PyTorch 2.0 이상이 준비되면 다음의 간단한 명령어로 FlashMLA를 설치할 수 있습니다:python setup.py install

설치가 완료되면 다음과 같은 명령어로 벤치마크를 실행할 수 있습니다:python tests/test_flash_mla.py

이 직관적인 프로세스는 개발자들 사이에서 큰 호응을 얻었으며, 많은 이들이 FlashMLA가 프로젝트를 어떻게 재편성하고 있는지에 대해 긍정적인 후기를 공유하고 있습니다.

전체적인 그림

DeepSeek의 FlashMLA 출시는 오픈 소스 혁신의 흥미로운 주간의 시작을 알립니다. 회사는 여기서 멈추지 않고 전 세계의 개발자들이 이 새로운 기술을 가지고 협력하고 구축할 것을 초대하고 있습니다. AI가 계속 진화함에 따라, FlashMLA와 같은 도구는 고급 AI를 더 접근 가능하고 효율적으로 만드는 데 중요한 역할을 합니다.

개발자와 기술 애호가 모두 이 프로젝트를 주의 깊게 지켜보고 있습니다. FlashMLA를 통해 DeepSeek는 한계에 도전하려는 명확한 의지를 보여주었으며, 이번 발표는 오픈 소스 주간 동안 단지 서막에 불과합니다.

마무리 생각

DeepSeek의 FlashMLA 소개는 모두의 입에 오르내리고 있습니다. BF16에 대한 강력한 지원, 혁신적인 페이지 KV 캐시, 탁월한 성능 메트릭을 갖춘 이 도구는 AI 처리의 효율성을 재정의할 수 있는 잠재력을 가지고 있습니다. AI 분야에 있다면 지금 FlashMLA가 당신을 위해 무엇을 할 수 있는지를 탐색할 때입니다. DeepSeek가 오픈 소스 주간 동안 흥미로운 새로운 기능을 지속적으로 출시하는 것에 대한 업데이트를 주목하세요.