Alors, ne manquez pas Anakin AI !

Anakin AI est une plateforme tout-en-un pour toute votre automatisation de flux de travail, créez une application IA puissante avec un constructeur d'applications sans code facile à utiliser, avec Deepseek, o3-mini-high d'OpenAI, Claude 3.7 Sonnet, FLUX, Minimax Video, Hunyuan...

Construisez votre application IA de rêve en quelques minutes, pas en semaines, avec Anakin AI !

Introduction

Le paysage de l'intelligence artificielle évolue rapidement, avec des modèles linguistiques puissants devenant de plus en plus accessibles aux développeurs et aux entreprises. Parmi ceux-ci, DeepSeek s'est imposé comme un concurrent redoutable face à des modèles établis comme ceux d'OpenAI, offrant des capacités de raisonnement impressionnantes à des prix compétitifs. Ce guide complet explore la structure tarifaire de l'API DeepSeek, ses fonctionnalités et comment vous pouvez tirer parti d'Anakin AI pour maximiser son potentiel.

Comprendre les Modèles DeepSeek

Avant de plonger dans les détails des prix, il est essentiel de comprendre les différents modèles proposés par DeepSeek :

DeepSeek-R1

DeepSeek-R1 est le modèle de raisonnement phare avec des capacités exceptionnelles en mathématiques, codage et raisonnement logique. Les spécifications clés incluent :

- 671 milliards de paramètres au total utilisant l'architecture Mixture-of-Experts (MoE)

- Seulement 37 milliards de paramètres actifs par token (pour l'efficacité)

- Jusqu'à 128K tokens de longueur de contexte

- Open source sous licence MIT

- Performance comparable au modèle o1 d'OpenAI

DeepSeek-V3

DeepSeek-V3 représente l'offre la plus avancée de l'entreprise :

- Architecture MoE avec 671 milliards de paramètres

- Excellente pour les tâches générales comme spécialisées

- Disponible en versions de base et optimisées pour les chats

Structure Tarifaire de l'API DeepSeek

DeepSeek propose un modèle tarifaire transparent et compétitif conçu pour fournir des capacités d'IA de haute qualité sans vous ruiner.

Tarification DeepSeek-R1

Tarification Standard :

- Tokens d'Entrée (Cache Miss) : 0,55 $ par million de tokens

- Tokens d'Entrée (Cache Hit) : 0,14 $ par million de tokens

- Tokens de Sortie : 2,19 $ par million de tokens

Système de Mise en Cache de Contexte

Une caractéristique remarquable du modèle tarifaire de DeepSeek est son système de mise en cache intelligent :

- Comment ça fonctionne : Le système stocke les invites et réponses fréquemment utilisées pendant plusieurs heures ou jours

- Économies de coûts : Réduction jusqu'à 90 % des coûts pour les requêtes répétées

- Gestion automatique : Aucune configuration ou frais supplémentaires nécessaires

- Bénéfice de performance : Latence réduite pour les réponses mises en cache

Ce mécanisme de mise en cache rend DeepSeek particulièrement attrayant pour les entreprises traitant de grands volumes de requêtes similaires, car il peut entraîner des réductions de coûts substantielles au fil du temps.

Tarification DeepSeek-V2

Pour ceux qui recherchent des options plus avantageuses, DeepSeek-V2 propose :

- Tokens d'entrée : Nettement moins chers que GPT-3.5-Turbo

- Tokens de sortie : Tarifs compétitifs avec une qualité similaire

- Aucune exigence de dépense minimale

Comparaison des Tarifs

Lorsqu'on les compare aux offres d'OpenAI :

| Modèle | Tarification d'Entrée (par M tokens) | Tarification de Sortie (par M tokens) | Longueur de Contexte |

|---|---|---|---|

| DeepSeek-R1 | 0,55 $ (Cache Miss) / 0,14 $ (Cache Hit) | 2,19 $ | Jusqu'à 128K |

| DeepSeek-V3 | Tarifs compétitifs | Tarifs compétitifs | Étendu |

| OpenAI GPT-4 | 10,00 $ | 30,00 $ | 8K-32K |

| OpenAI o1 | Plus élevé que DeepSeek-R1 | Plus élevé que DeepSeek-R1 | Limité |

Commencer avec DeepSeek API

Implémenter l'API DeepSeek dans vos applications est simple :

Étape 1 : Obtenir la Clé API

- Visitez le Portail Développeur DeepSeek

- Créez un compte ou connectez-vous

- Générez votre clé API

- Conservez-la en sécurité pour l'utiliser dans vos applications

Étape 2 : Configurez votre Environnement

import requests

API_KEY = "your_api_key"

BASE_URL = "<https://api.deepseek.com>"

Étape 3 : Faites votre Première Appel API

Utiliser Python :

def query_deepseek(prompt):

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer {API_KEY}"

}

data = {

"model": "deepseek-reasoner",

"messages": [

{"role": "system", "content": "Vous êtes un assistant utile."},

{"role": "user", "content": prompt}

],

"stream": False

}

response = requests.post(f"{BASE_URL}/chat/completions", json=data, headers=headers)

return response.json()

result = query_deepseek("Résoudre ce problème mathématique : Quelle est l'intégrale de x^2 ?")

print(result)

Utiliser cURL :

curl <https://api.deepseek.com/chat/completions> \\\\

-H "Content-Type: application/json" \\\\

-H "Authorization: Bearer <your_api_key>" \\\\

-d '{

"model": "deepseek-reasoner",

"messages": [

{"role": "system", "content": "Vous êtes un assistant utile."},

{"role": "user", "content": "Expliquez l'intrication quantique."}

],

"stream": false

}'

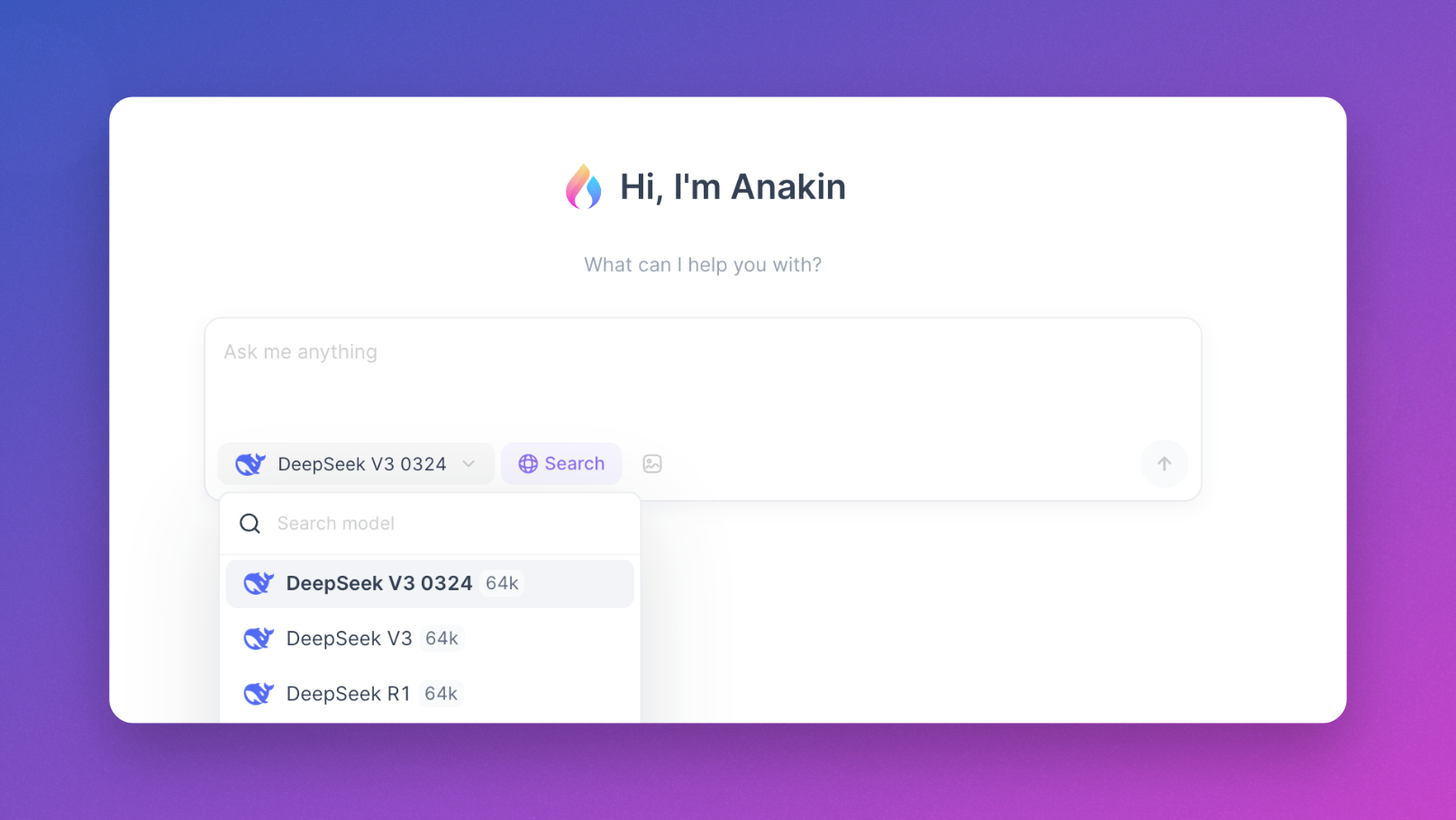

Tirer parti d'Anakin AI avec DeepSeek

Bien que l'API de DeepSeek soit puissante en soi, l'intégrer avec Anakin AI débloque encore plus de capacités et simplifie le processus de développement.

Qu'est-ce qu'Anakin AI ?

Anakin AI est une plateforme tout-en-un qui vous permet de :

- Créer des flux de travail IA sans écrire de code

- Accéder à plus de 1000 applications IA préconstruites

- Intégrer plusieurs modèles IA dans un seul flux de travail

- Gérer les coûts de l'IA efficacement grâce à un système de crédits

Avantages de l'utilisation de DeepSeek via Anakin AI

- Intégration simplifiée : Utilisez les modèles DeepSeek sans gérer des configurations API complexes

- Flux de travail Multi-Modeles : Combinez DeepSeek avec d'autres modèles comme GPT, Claude ou Mixtral

- Constructeur de flux de travail visuel : Créez des processus IA complexes via une interface de glisser-déposer

- Gestion des Coûts : Utilisez le système de crédits au lieu de gérer plusieurs abonnements API

- Modèles préconstruits : Accédez à des modèles spécialisés pour diverses applications

Commencer avec Anakin AI et DeepSeek

- Inscrivez-vous : Créez un compte sur la plateforme Anakin AI

- Choisissez DeepSeek : Sélectionnez le modèle DeepSeek approprié pour vos besoins

- Construisez le Flux de travail : Utilisez l'interface visuelle pour concevoir votre processus IA

- Déployez : Lancez votre solution en un seul clic

Cas d'utilisation Exemple avec Anakin AI et DeepSeek

- Service Client Amélioré :

- Utilisez DeepSeek-R1 pour des tâches de raisonnement complexes

- Traitez les requêtes des clients via le système de flux de travail d'Anakin

- Générez des réponses précises et utiles à grande échelle

- Pipeline de Génération de Contenu :

- Créez des plans avec DeepSeek-V3

- Générez du contenu détaillé basé sur ces plans

- Revoyez et affinez la production à l'aide de modèles spécialisés

- Assistant de Programmation :

- Exploitez les capacités de codage de DeepSeek-R1

- Créez des flux de travail pour la génération de code, l'explication et le débogage

- Intégrez avec des outils de développement via l'interface d'Anakin

Stratégies d'Optimisation des Coûts

Pour maximiser la valeur lors de l'utilisation de l'API de DeepSeek, envisagez ces stratégies :

1. Exploitez la Mise en Cache de Contexte

- Regroupez les requêtes similaires pour bénéficier des hits de cache

- Structurez les applications pour réutiliser le contexte lorsque c'est possible

- Surveillez les taux de hits de cache pour optimiser la performance

2. Optimiser l'Ingénierie des Invites

- Gardez les invites concises pour minimiser l'utilisation de tokens d'entrée

- Utilisez efficacement les invites système pour guider le comportement du modèle

- Équilibrez la longueur du contexte par rapport aux exigences de précision

3. Choisissez le Bon Modèle pour la Tâche

- Utilisez DeepSeek-R1 pour des tâches de raisonnement complexes et spécialisées

- Envisagez DeepSeek-V2 pour des applications plus générales avec des contraintes budgétaires

- Associez les capacités des modèles aux exigences spécifiques

4. Implémentez le Batching

- Traitez les demandes connexes ensemble lorsque c'est possible

- Utilisez le traitement asynchrone pour un meilleur débit

- Équilibrez la taille du lot par rapport aux exigences de latence

Fonctionnalités Avancées de l'API DeepSeek

Raisonnement par Chaîne de Pensée

DeepSeek-R1 excelle à décomposer des problèmes complexes en étapes gérables :

- Résolution de problèmes détaillée étape par étape

- Auto-vérification des résultats intermédiaires

- Processus de pensée transparents dans les sorties

Utilisation de la Longueur de Contexte

Avec un support de jusqu'à 128K tokens, DeepSeek-R1 peut :

- Traiter des documents volumineux

- Maintenir la cohérence à travers de longues conversations

- Gérer des instructions complexes en plusieurs parties

Optimisation de la Performance

Ajustez la performance en :

- Ajustant les longueurs de tokens pour des requêtes complexes

- Utilisant le cache de contexte pour les invites répétées

- Optimisant les invites système pour des tâches spécifiques

Conclusion

L'API DeepSeek offre une combinaison convaincante de performance, de flexibilité et de rapport qualité-prix. Sa structure tarifaire compétitive, en particulier avec le système innovant de mise en cache de contexte, en fait une option attrayante pour les développeurs et les entreprises cherchant à mettre en œuvre des capacités avancées d'IA.

En tirant parti de la plateforme intuitive d'Anakin AI parallèlement aux puissants modèles de DeepSeek, vous pouvez créer des flux de travail IA sophistiqués sans expertise technique profonde. Cette combinaison fournit le meilleur des deux mondes : les modèles linguistiques à la pointe de la technologie de DeepSeek et l'interface conviviale d'Anakin AI.

Que vous construisiez une solution de service client, développiez du contenu à grande échelle ou créiez des outils spécialisés, l'API DeepSeek, surtout lorsqu'elle est combinée avec Anakin AI, offre la performance, la flexibilité et l'efficacité des coûts nécessaires pour donner vie à votre vision de l'IA.

Commencez à explorer les capacités de DeepSeek via Anakin AI dès aujourd'hui et découvrez comment cette puissante combinaison peut transformer votre approche de la mise en œuvre de l'intelligence artificielle.