Einführung in Command R7B

In der sich schnell entwickelnden Landschaft der künstlichen Intelligenz hat Cohere mit der Veröffentlichung von Command R7B, einem hochmodernen Open-Source-Modell für große Sprachmodelle (LLM), einen bedeutenden Beitrag geleistet. Dieses Modell mit 7 Milliarden Parametern stellt einen großen Fortschritt im Bereich der Verarbeitung natürlicher Sprache dar und bietet außergewöhnliche Leistungen über ein breites Spektrum von Aufgaben, während es eine relativ kompakte Größe beibehält. Command R7B ist darauf ausgelegt, in unternehmensrelevanten Szenarien zu glänzen und ist damit ein vielseitiges Tool für Entwickler, Forscher und Unternehmen.

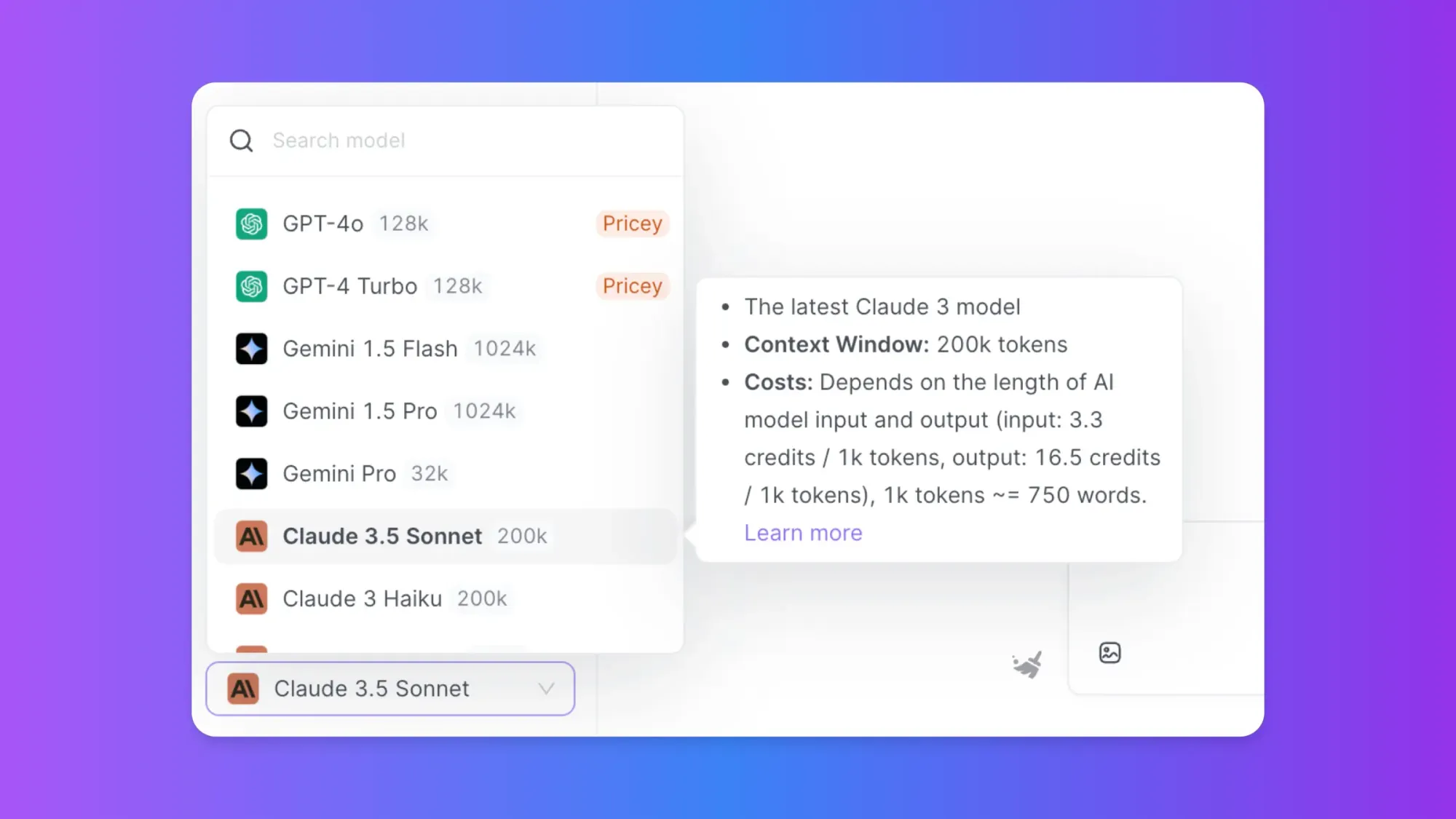

$20/Monat für ChatGPT, Claude Pro, Perplexity AI

$20/Monat für AI-Generatoren (wie Midjourney, FLUX, Recraft, DALLE 3)

$60/Monat für AI-Video-Generierungstools (wie Minimax, Luma AI, Runway ML

Warum sich mit einer KI zufrieden geben, wenn Sie sie alle haben können? Mit Anakin AI haben Sie Zugriff auf GPT 4, 4o, O1, Claude, Gemini und andere hochmoderne KI-Tools – alle in einer nahtlosen Plattform.

Die Kraft jeder KI vereint für Sie. Probieren Sie Anakin AI heute als Ihre All-in-One-KI-Plattform!

Command R7B: Technische Spezifikationen und Fähigkeiten

Modellarchitektur von Command R7B

Command R7B basiert auf einer architectures basierten Transformer-Architektur, die zum Standard für leistungsstarke Sprachmodelle geworden ist. Mit 7 Milliarden Parametern findet es ein Gleichgewicht zwischen Modellgröße und Rechen-effizienz, was einen Einsatz in verschiedenen Umgebungen ermöglicht, ohne umfangreiche Hardware-Ressourcen zu benötigen. Die Architektur des Modells ist sowohl auf Geschwindigkeit als auch auf Genauigkeit optimiert, wodurch es in der Lage ist, komplexe Sprachaufgaben mit bemerkenswerter Kompetenz zu bewältigen.

Kontextuelles Verständnis in Command R7B

Ein herausragendes Merkmal von Command R7B ist sein beeindruckendes Kontextfenster von 128.000 Tokens. Diese umfangreiche Kontextlänge ermöglicht es dem Modell, wesentlich längere Texte als viele seiner Vorläufer und Konkurrenten zu verarbeiten und zu verstehen. Die Fähigkeit, Kohärenz und Relevanz über einen so großen Textabschnitt hinweg aufrechtzuerhalten, ist entscheidend für Aufgaben, die ein tiefes Verständnis umfangreicher Dokumente oder Gespräche erfordern.

Mehrsprachige Fähigkeiten von Command R7B

Command R7B verfügt über mehrsprachige Kompetenzen und wurde auf 23 verschiedenen Sprachen trainiert. Diese breite Sprachabdeckung macht es zu einem unschätzbaren Werkzeug für globale Unternehmen und mehrsprachige Anwendungen. Die Fähigkeit des Modells, Inhalte in mehreren Sprachen zu verstehen und zu generieren, eröffnet Möglichkeiten für sprachübergreifende Aufgaben wie Übersetzung, Zusammenfassung und Informationsabruf über Sprachgrenzen hinweg.

Command R7B: Spezialisierte Funktionen

Abrufergänzte Generierung mit Command R7B

Eine der Kernstärken von Command R7B liegt in seiner Optimierung für die abgerufenergänzte Generierung (RAG). Diese Fähigkeit ermöglicht es dem Modell, sein vortrainiertes Wissen effektiv mit externen Informationsquellen zu kombinieren und seine Fähigkeit zu verbessern, genaue und kontextuell relevante Antworten zu liefern. In RAG-Anwendungen kann Command R7B abgerufene Informationen nahtlos in seine generierten Ausgaben integrieren, was es besonders nützlich für Frage-Antwort-Systeme, Chatbots und andere Anwendungen macht, die aktuelles oder domänenspezifisches Wissen erfordern.

Werkzeuggebrauch und agentische Fähigkeiten in Command R7B

Command R7B wurde speziell mit Blick auf Werkzeuggebrauch und agentische Fähigkeiten entwickelt. Das bedeutet, dass das Modell effektiv mit externen Werkzeugen, APIs und Datenbanken interagieren kann, was es zu einer idealen Wahl für den Aufbau komplexer KI-Agenten macht. Die Fähigkeit des Modells, mehrstufige Prozesse zu verstehen und auszuführen, Informationen aus verschiedenen Quellen zu kombinieren und Entscheidungen auf Basis verfügbarer Daten zu treffen, macht es besonders geeignet für Aufgaben, die anspruchsvolles Denken und Problemlösungsfähigkeiten erfordern.

Code-Generierung und -Verständnis mit Command R7B

Im Bereich der codebezogenen Aufgaben zeigt Command R7B beeindruckende Fähigkeiten. Das Modell glänzt in der Code-Generierung, Erklärung und Übersetzung in verschiedenen Programmiersprachen. Seine Kompetenz im Umgang mit codebezogenen Anfragen macht es zu einem wertvollen Asset für Software-Entwicklungsteams, das schnellere Prototypen, Debugging und Code-Review-Prozesse ermöglicht. Das Verständnis des Modells für Programmierkonzepte und Syntax erlaubt es, Entwicklern bei der Erstellung effizienter und sauberer Codes zu helfen sowie komplexe Algorithmen und Datenstrukturen zu erklären.

Command R7B: Leistungsbenchmarks und Vergleiche

Benchmark-Ergebnisse für Command R7B

Command R7B hat in einer Vielzahl von Benchmark-Tests außergewöhnliche Leistungen gezeigt und übertrifft oft andere Modelle ähnlicher Größe. In standardisierten Tests wie denen, die auf der Hugging Face Open LLM-Leiterplatte angezeigt werden, rangiert Command R7B konstant an der Spitze oder in der Nähe der Spitze unter Open-Source-Modellen vergleichbarer Größe. Seine starke Leistung in verschiedenen Aufgaben, einschließlich Denken, Zusammenfassung und Frage-Antwort, zeigt die Vielseitigkeit und Robustheit des Modells.

Command R7B vs. Andere Open-Source-Modelle

Im Vergleich zu anderen Open-Source-Sprachmodellen hebt sich Command R7B in mehreren wichtigen Bereichen hervor. Seine 128K Kontextlänge übertrifft viele Wettbewerber, was ein umfassenderes Verständnis von Inhalten in Langform ermöglicht. In Bezug auf mehrsprachige Fähigkeiten hat Command R7B seine Kompetenzen in 23 Sprachen, was es vor viele einsprachige oder zweisprachige Modelle bringt. Das spezialisierte Training des Modells in RAG und Werkzeuggebrauch gibt ihm ebenfalls einen Vorteil in unternehmensrelevanten Szenarien, in denen diese Fähigkeiten zunehmend wichtig sind. Im Vergleich zu Modellen wie LLaMA 2 und MPT-7B zeigt Command R7B in vielen Aufgaben wettbewerbsfähige oder überlegene Leistungen, während es zusätzliche Funktionen wie verbesserte Sicherheitskontrollen und spezialisiertes Training für Unternehmensanwendungsfälle bietet. Die Leistung des Modells bei codebezogenen Aufgaben ist besonders bemerkenswert und übertrifft oft andere Modelle ähnlicher Größe in Bereichen wie SQL-Generierung und Code-Übersetzung.

Command R7B: Praktische Anwendungen und Anwendungsfälle

Unternehmensanwendungen von Command R7B

Das Design von Command R7B macht es besonders gut geeignet für Unternehmensanwendungen. Seine Fähigkeit, komplexe Abfragen zu verarbeiten, sich in externe Datenquellen zu integrieren und mehrstufige Denkaufgaben zu erfüllen, macht es zu einer ausgezeichneten Wahl für den Aufbau fortschrittlicher Business-Intelligence-Systeme, Kunden-Support-Chatbots und Datenanalysetools. Die Mehrsprachigkeit des Modells ist ebenfalls wertvoll für globale Unternehmen, die mit mehrsprachigen Inhalten und Kommunikation umgehen.

Command R7B in Forschung und Entwicklung

Für Forscher und Entwickler bietet Command R7B eine leistungsstarke Plattform für Experimente und Innovation. Seine Open-Source-Natur ermöglicht Feinabstimmung und Anpassung, sodass Forscher das Modell für spezifische Bereiche oder Aufgaben anpassen können. Die starke Leistung des Modells bei verschiedenen NLP-Aufgaben macht es zu einem wertvollen Werkzeug zur Erschließung neuer Möglichkeiten in Bereichen wie natürlichem Sprachverständnis, -generierung und sprachübergreifenden Anwendungen.

Command R7B für Content-Erstellung und -Analyse

Im Bereich der Inhaltserstellung und -analyse zeigt Command R7B beeindruckende Fähigkeiten. Seine Fähigkeit, kohärente und kontextuell relevante Texte zu generieren, macht es nützlich für Aufgaben wie Artikel schreiben, Inhaltszusammenfassung und kreative Schreibhilfe. Für die Inhaltsanalyse ermöglichen es die große Kontextfenster des Modells und seine starken Verständnisfähigkeiten, längere Dokumente zu verarbeiten und zu verstehen, was es effektiv für Aufgaben wie Stimmungsanalyse, Themenmodellierung und Informationsabruf macht.

Command R7B: Ethische Überlegungen und Sicherheitsmerkmale

Sicherheitsmodi in Command R7B

Eine der bemerkenswerten Funktionen von Command R7B ist die Implementierung verschiedener Sicherheitsmodi. Das Modell umfasst zwei verschiedene Sicherheitskonfigurationen:

- Kontextueller Sicherheitsmodus: Dieser Modus ist so konzipiert, dass die Erstellung von Inhalten, die mit sexuellem Missbrauch und Ausbeutung von Kindern in Verbindung stehen, verhindert wird. Er erlaubt jedoch die Diskussion anderer potenziell sensibler Themen wie Gewalt, Hassrede, Fehlinformationen oder sexuelle Inhalte, solange der generierte Inhalt nicht zu schädlichen Konsequenzen führt.

- Strikter Sicherheitsmodus: Neben den Einschränkungen des kontextuellen Sicherheitsmodus geht diese Konfiguration strenger vor. Sie verweigert die Erstellung jeglicher Inhalte, die mit Gewalt, Hassrede, Fehlinformationen oder sexuellen Themen in Verbindung stehen. Sie vermeidet auch die Verwendung von Schimpfwörtern und wird keine Anleitung zu illegalen oder kontrollierten Aktivitäten geben.

Diese Sicherheitsmodi stellen einen bedeutenden Fortschritt bei der Behandlung ethischer Bedenken im Zusammenhang mit großen Sprachmodellen dar und bieten den Nutzern eine größere Kontrolle über die Art des Inhalts, den das Modell generiert.

Verantwortungsvolle KI-Entwicklung mit Command R7B

Die Entwicklung und Veröffentlichung von Command R7B spiegeln ein Engagement für verantwortungsvolle KI-Praktiken wider. Durch die Bereitstellung des Modells als Open Source und detaillierte Dokumentation über seine Fähigkeiten und Einschränkungen fördert Cohere Transparenz und ermöglicht der breiteren KI-Community, das Modell zu überprüfen und zu verbessern. Dieser Ansatz fördert ein kooperatives Umfeld zur Behandlung potenzieller Vorurteile und ethischer Bedenken in der KI-Entwicklung.

Command R7B: Technische Implementierung und Bereitstellung

Integration von Command R7B in bestehende Systeme

Die Integration von Command R7B in bestehende Systeme wird durch die Kompatibilität mit beliebten Frameworks und Bibliotheken für maschinelles Lernen erleichtert. Das Modell kann einfach mit der Hugging Face Transformers-Bibliothek geladen und verwendet werden, was es einer breiten Palette von Entwicklern zugänglich macht, die mit diesem Ökosystem vertraut sind. Für diejenigen, die Command R7B im großen Stil bereitstellen möchten, macht die relativ kompakte Größe des Modells (im Vergleich zu größeren Alternativen) es leichter handhabbar in Bezug auf Rechenressourcen und Speicheranforderungen.

Feinabstimmung von Command R7B für spezifische Aufgaben

Einer der Vorteile von Command R7B, dass es Open Source ist, besteht darin, dass es für spezifische Aufgaben oder Bereiche feinabgestimmt werden kann. Dieser Prozess umfasst das weitere Training des Modells mit aufgabenspezifischen Daten, sodass es sein Wissen und seine Fähigkeiten an bestimmte Anwendungsfälle anpassen kann. Die Feinabstimmung kann die Leistung bei spezialisierten Aufgaben erheblich verbessern, sodass Command R7B für domänenspezifische Anwendungen noch wertvoller wird.

Command R7B: Zukunftsperspektiven und Potenzialentwicklungen

Laufende Forschung und Verbesserung von Command R7B

Als Open-Source-Modell wird Command R7B voraussichtlich von laufender Forschung und Verbesserungen der KI-Community profitieren. Dieser kooperative Ansatz in der Entwicklung könnte zu Verbesserungen in verschiedenen Bereichen führen, wie:

- Weitere Verbesserungen in den mehrsprachigen Fähigkeiten

- Verbesserte Leistung bei spezifischen Aufgaben durch community-gesteuerte Feinabstimmung

- Entwicklung neuer Techniken für eine effiziente Bereitstellung und Inferenz

- Erforschen neuartiger Anwendungen, die die einzigartigen Fähigkeiten von Command R7B nutzen

Command R7B in der sich entwickelnden Landschaft der KI

Die Veröffentlichung von Command R7B stellt einen bedeutenden Meilenstein in der Demokratisierung fortschrittlicher KI-Technologien dar. Da sich das Feld der KI weiterhin schnell entwickelt, spielen Modelle wie Command R7B eine entscheidende Rolle bei der Förderung von Innovation und Zugänglichkeit. Die Kombination von starker Leistung, Vielseitigkeit und ethischen Überlegungen positioniert das Modell als wertvolle Ressource für Forscher, Entwickler und Unternehmen, die darauf abzielen, modernste Sprach-KI-Technologien zu nutzen.

Fazit: Die Auswirkungen von Command R7B auf Open-Source-KI

Command R7B steht als Beweis für die Kraft der Open-Source-Entwicklung im Bereich der künstlichen Intelligenz. Indem Cohere der Öffentlichkeit ein leistungsstarkes, vielseitiges und ethisch bewusstes Sprachmodell anbietet, hat es einen bedeutenden Beitrag zur KI-Community geleistet. Die beeindruckenden Fähigkeiten des Modells in verschiedenen Aufgaben, kombiniert mit einem durchdachten Ansatz für Sicherheit und ethische Überlegungen, machen es zu einem wertvollen Werkzeug für eine Vielzahl von Anwendungen. Während sich die KI-Landschaft weiter entwickelt, dient Command R7B sowohl als leistungsstarkes Werkzeug für aktuelle Anwendungen als auch als Grundlage für zukünftige Innovationen. Seine Veröffentlichung bietet nicht nur einen unmittelbaren Wert für Entwickler und Forscher, sondern setzt auch einen neuen Standard dafür, was Open-Source-Sprachmodelle erreichen können. Der Erfolg des Modells unterstreicht die Bedeutung kooperativer, transparenter Ansätze in der KI-Entwicklung und ebnet den Weg für inklusivere und verantwortungsvollere Fortschritte auf diesem Gebiet.