¿Alguna vez has soñado con crear impresionantes videos generados por IA, pero te has sentido limitado por herramientas costosas y propietarias como Sora de OpenAI? No estás solo. El reciente lanzamiento de Open-Sora, un modelo de generación de videos por IA de código abierto desarrollado por HPC-AI Tech (el equipo de Colossal-AI), ha enviado ondas de emoción a través de las comunidades creativas y tecnológicas. Ofreciendo capacidades poderosas comparables a alternativas comerciales, Open-Sora se está convirtiendo rápidamente en la solución preferida para la creación de videos por IA accesibles y de alta calidad.

En este artículo, profundizaremos en lo que hace de Open-Sora una herramienta innovadora, exploraremos su evolución, características técnicas, métricas de rendimiento y cómo se compara con Sora de OpenAI. Ya seas un creador de contenido, desarrollador o simplemente un entusiasta de la IA, encontrarás muchas razones para emocionarte con Open-Sora.

¿Listo para explorar más herramientas innovadoras de video por IA? Echa un vistazo a los poderosos modelos de generación de video de Anakin AI como Minimax Video, Tencent Hunyuan y Runway ML, todos disponibles en una plataforma simplificada. Eleva tus proyectos creativos hoy: Explora el Generador de Video de Anakin AI

La Evolución de Open-Sora: De un Comienzo Prometedor a Retador de la Industria

Open-Sora no se convirtió en una sensación de la noche a la mañana. Ha evolucionado significativamente desde su lanzamiento inicial, mejorando constantemente sus capacidades y rendimiento:

Historial de Versiones a Simple Vista:

- Open-Sora 1.0: Lanzamiento inicial, proceso de entrenamiento y arquitectura del modelo completamente de código abierto.

- Open-Sora 1.1: Introducción de generación de video de múltiples resoluciones, múltiples longitudes y múltiples relaciones de aspecto, junto con acondicionamiento y edición de imágenes/videos.

- Open-Sora 1.2: Añadido flujo rectificado, 3D-VAE y métricas de evaluación mejoradas.

- Open-Sora 1.3: Implementación de atención de ventana desfasada y VAE espaciotemporal unificado, escalando hasta 1.1 mil millones de parámetros.

- Open-Sora 2.0: La versión más reciente y avanzada, con 11 mil millones de parámetros, casi igualando a los modelos propietarios como Sora de OpenAI.

Cada iteración ha llevado a Open-Sora más cerca de la paridad con los modelos comerciales líderes en la industria, democratizando el acceso a la poderosa tecnología de generación de videos por IA.

Bajo el Capó: Arquitectura Técnica y Características Principales

¿Qué hace exactamente que Open-Sora 2.0 sea una alternativa tan convincente a Sora de OpenAI? Desglosamos su arquitectura innovadora y potentes capacidades:

Arquitectura del Modelo Innovadora:

- Transformador de Difusión de Movimiento enmascarado (MMDiT): Utiliza mecanismos avanzados de atención total 3D, mejorando significativamente el modelado de características espaciotemporales.

- Transformador de Difusión Espaciotemporal (ST-DiT-2): Soporta diversas duraciones de video, resoluciones, relaciones de aspecto y tasas de cuadros, lo que lo hace muy versátil.

- Autoencoder de Video de Alta Compresión (Video DC-AE): Reduce drásticamente el tiempo de inferencia a través de compresión eficiente, permitiendo una generación de video más rápida.

Impresionantes Capacidades de Generación:

Open-Sora 2.0 ofrece diversos y intuitivos métodos de generación de video:

- Texto a Video: Crea videos atractivos directamente a partir de descripciones textuales.

- Imagen a Video: Da vida a imágenes estáticas con movimiento dinámico.

- Video a Video: Modifica sin problemas contenido de video existente.

- Control de Intensidad de Movimiento: Ajusta la intensidad del movimiento con un simple parámetro "Puntaje de Movimiento" (que varía de 1 a 7).

Estas características capacitan a los creadores para producir contenido altamente personalizado y visualmente atractivo con facilidad.

Proceso de Entrenamiento Eficiente: Alto Rendimiento a una Fracción del Costo

Uno de los logros más destacados de Open-Sora es su metodología de entrenamiento rentable. Al aprovechar estrategias innovadoras, el equipo de Open-Sora ha reducido significativamente los gastos de entrenamiento en comparación con los estándares de la industria:

Metodología de Entrenamiento Inteligente:

- Entrenamiento en Múltiples Etapas: Comienza con marcos de baja resolución, afinando gradualmente para obtener salidas de alta resolución.

- Estrategia de Prioridad de Baja Resolución: Prioriza aprender características de movimiento primero, luego la mejora de la calidad, ahorrando hasta 40 veces los recursos computacionales.

- Filtrado de Datos Rigurosos: Garantiza datos de entrenamiento de alta calidad, mejorando la eficiencia general.

- Procesamiento Paralelo: Utiliza ColossalAI para la utilización optimizada de la GPU en entornos de entrenamiento distribuidos.

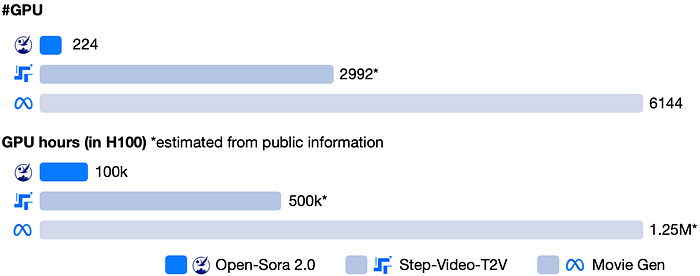

Notable Eficiencia de Costos:

- Open-Sora 2.0: Desarrollado a aproximadamente $200,000 (equivalente a 224 GPUs).

- Step-Video-T2V: Estimado en 2992 GPUs (500k horas de GPU).

- Movie Gen: Requiere aproximadamente 6144 GPUs (1.25M horas de GPU).

Esto representa una sorprendente reducción de costos de 5 a 10 veces en comparación con los modelos de generación de video propietarios, haciendo que Open-Sora sea accesible a un rango más amplio de usuarios y desarrolladores.

Métricas de Rendimiento: ¿Cómo se Compara Open-Sora?

Al evaluar modelos de IA, las métricas de rendimiento son cruciales. Open-Sora 2.0 ha mostrado resultados impresionantes, casi igualando a Sora de OpenAI en métricas clave:

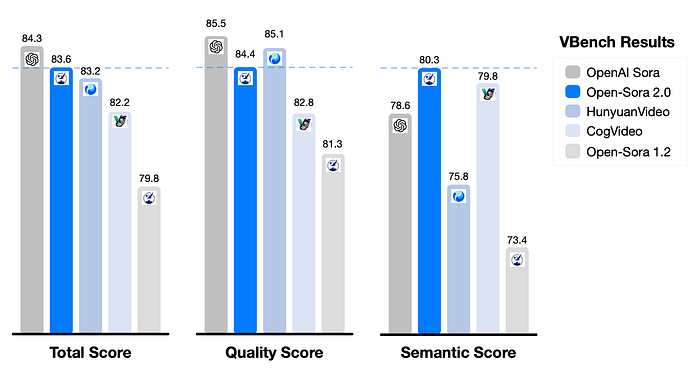

Resultados de Evaluación VBench:

- Puntuación Total: Open-Sora 2.0 obtuvo 83.6, en comparación con 84.3 de Sora de OpenAI.

- Puntuación de Calidad: 84.4 (Open-Sora) frente a 85.5 (Sora de OpenAI).

- Puntuación Semántica: 80.3 (Open-Sora) frente a 78.6 (Sora de OpenAI).

La brecha de rendimiento entre Open-Sora y Sora de OpenAI se ha reducido drásticamente, del 4.52% en versiones anteriores a solo el 0.69% en la actualidad.

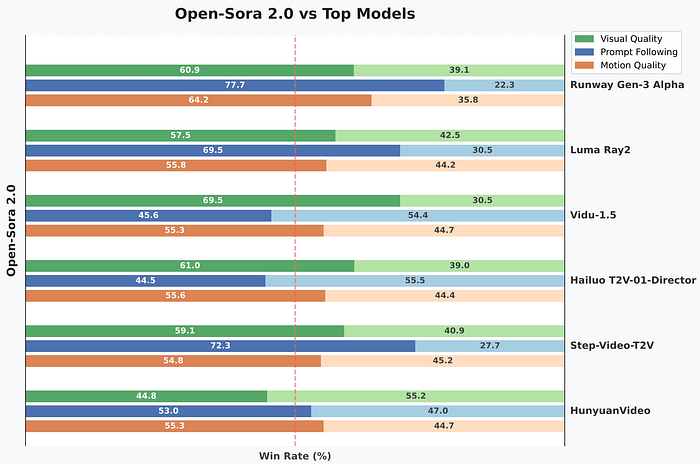

Tasas de Ganancia de Preferencia de Usuarios:

En comparaciones directas, Open-Sora 2.0 supera consistentemente a otros modelos líderes:

- Calidad Visual: 69.5% de tasa de ganancia contra Vidu-1.5, 61.0% contra Hailuo T2V-01-Director.

- Seguimiento de Indicaciones: 77.7% de tasa de ganancia contra Runway Gen-3 Alpha, 72.3% contra Step-Video-T2V.

- Calidad de Movimiento: 64.2% de tasa de ganancia contra Runway Gen-3 Alpha, 55.8% contra Luma Ray2.

Estos resultados demuestran claramente la ventaja competitiva de Open-Sora, convirtiéndolo en una alternativa viable a soluciones propietarias costosas.

Especificaciones de Generación de Video: ¿Qué Puedes Esperar?

Open-Sora 2.0 ofrece capacidades robustas de generación de video adecuadas para diversas necesidades creativas:

Resolución y Longitud:

- Soporta múltiples resoluciones (256px, 768px) y relaciones de aspecto (16:9, 9:16, 1:1, 2.39:1).

- Genera videos de hasta 16 segundos a alta calidad (720p).

Tasa de Cuadros y Tiempo de Procesamiento:

- Salida constante de 24 FPS para una calidad cinematográfica suave.

- Los tiempos de procesamiento varían:

- Resolución 256×256: ~60 segundos en una única GPU de alta gama.

- Resolución 768×768: ~4.5 minutos con 8 GPUs en paralelo.

- GPU RTX 3090: 30 segundos para un video de 2 segundos a 240p, 60 segundos para un video de 4 segundos.

Requisitos de Hardware e Instalación: Empezando

Para comenzar a usar Open-Sora, deberás cumplir con requisitos específicos de hardware y software:

Requisitos del Sistema:

- Python: Versión 3.8 o superior.

- PyTorch: Versión 2.1.0 o superior.

- CUDA: Versión 11.7 o superior.

Requisitos de Memoria de GPU:

- GPUs de Consumo (por ejemplo, RTX 3090 con 24GB de VRAM): Adecuadas para videos cortos y de baja resolución.

- GPUs Profesionales (por ejemplo, RTX 6000 Ada con 48GB de VRAM): Recomendadas para resoluciones más altas y videos más largos.

- GPUs H100/H800: Ideales para máxima resolución y secuencias más largas.

Pasos de Instalación:

- Clona el repositorio:

git clone https://github.com/hpcaitech/Open-Sora

- Configura el entorno de Python:

conda create -n opensora python=3.8 -y

- Instala los paquetes requeridos:

pip install -e .

- Descarga los pesos del modelo desde los repositorios de Hugging Face.

- Optimiza el uso de memoria con la opción

--save_memorydurante la inferencia.

Limitaciones y Futuros Desarrollos: ¿Qué Sigue para Open-Sora?

A pesar de sus impresionantes capacidades, Open-Sora 2.0 aún enfrenta algunas limitaciones:

- Longitud del Video: Actualmente limitada a 16 segundos para salidas de alta calidad.

- Límites de Resolución: Resoluciones más altas requieren múltiples GPUs de alta gama.

- Restricciones de Memoria: Las GPUs de consumo tienen capacidades limitadas.

Sin embargo, el equipo de Open-Sora está trabajando activamente en mejoras como la interpolación de múltiples cuadros y una mejor coherencia temporal, prometiendo videos generados por IA aún más suaves y largos en el futuro.

Reflexiones Finales: Democratizando la Generación de Videos por IA

Open-Sora 2.0 representa un avance significativo en la democratización de la tecnología de generación de videos por IA. Con un rendimiento casi equivalente a los modelos propietarios como Sora de OpenAI —pero a una fracción del costo— Open-Sora capacita a creadores, desarrolladores y empresas para aprovechar el poder de la generación de videos por IA sin gastos prohibitivos.

A medida que Open-Sora continúa evolucionando, está listo para revolucionar las industrias creativas, ofreciendo herramientas de generación de videos accesibles y de alta calidad para todos.

¿Listo para explorar herramientas de generación de videos por IA aún más poderosas? Descubre Minimax Video, Tencent Hunyuan, Runway ML y más, todos disponibles en Anakin AI. Desata tu creatividad hoy: Explora el Generador de Video de Anakin AI