以下のHTMLコードを日本語に翻訳してください。 次のようなURLがあることを確認してください: https://anakin.ai/apps/keyword または https://anakin.ai/blog/keyword を以下に変換してください https://anakin.ai/ja-jp/apps/keyword https://anakin.ai/ja-jp/blog/keyword 以下はHTMLです:

Fish Speech TTSは、オープンソースのテキスト読み上げ技術の大きな進歩を表しており、開発者、研究者、愛好家にとって強力で多目的なソリューションを提供します。Fish Audioによって開発されたこの革新的なシステムは、高品質で自然な音声を複数の言語で生成するために、先進的な深層学習技術と豊富な多言語トレーニングデータを組み合わせています。

それなら、Anakin AIを見逃すことはできません!

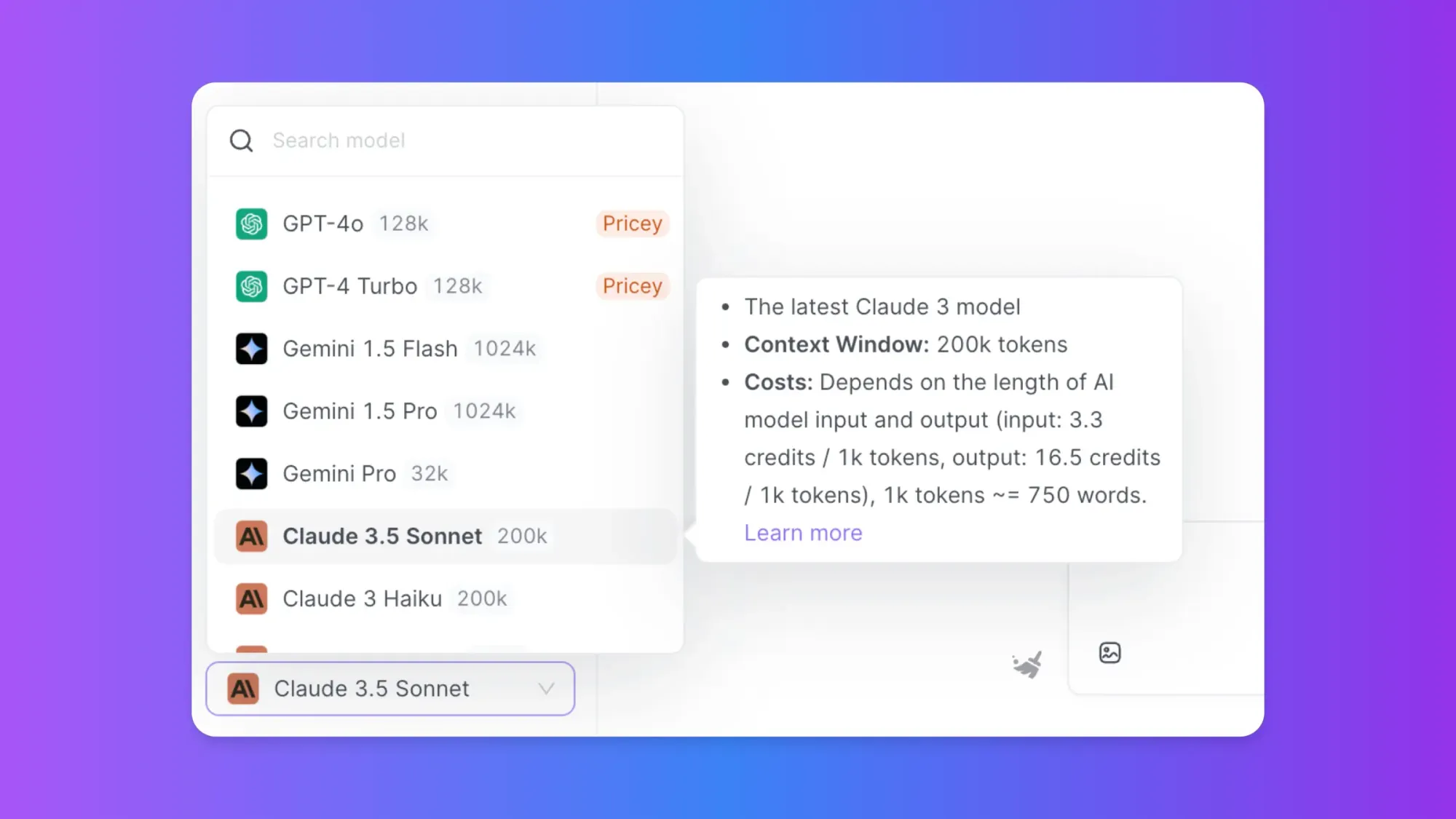

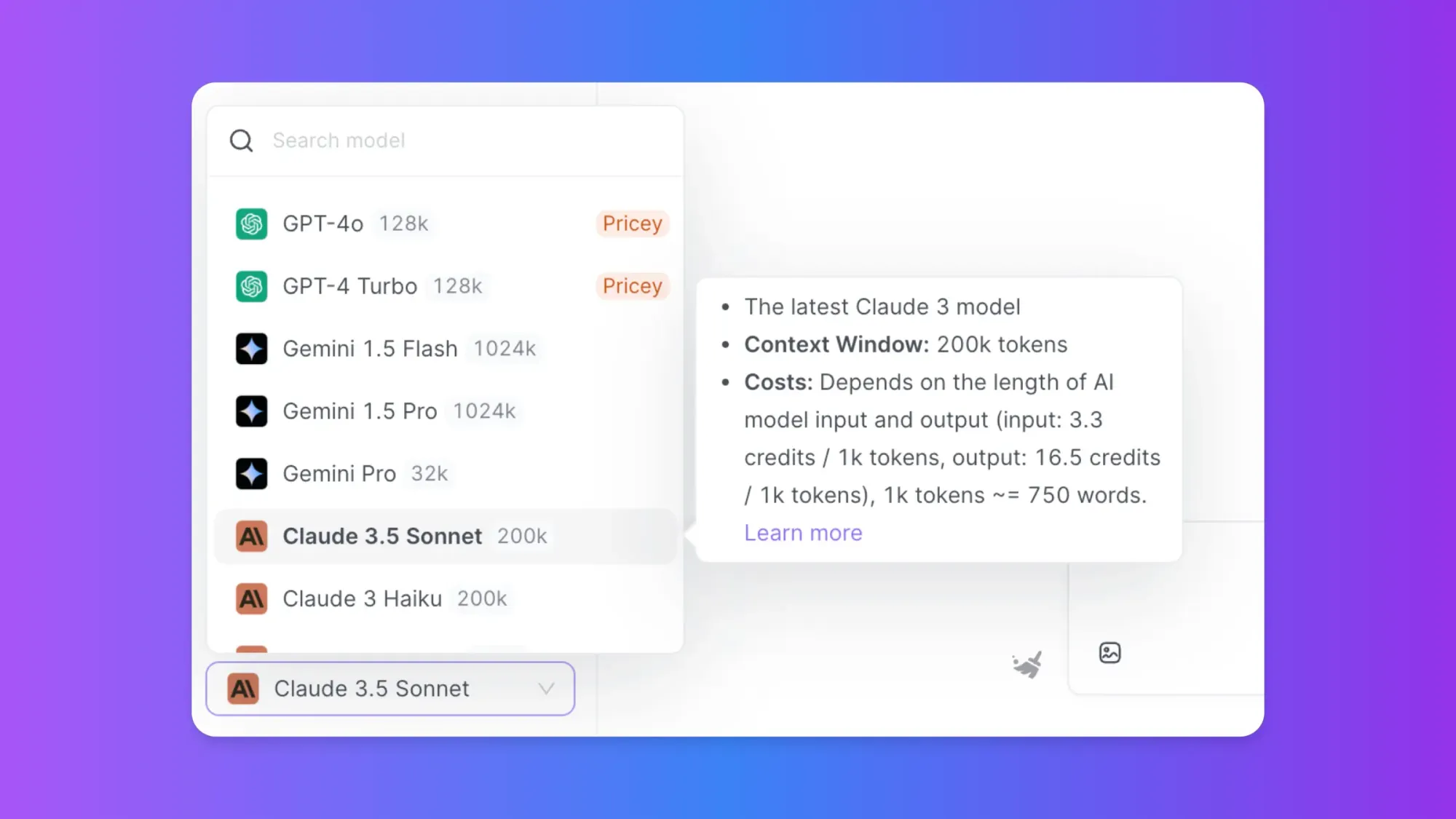

Anakin AIは、ワークフローの自動化のためのオールインワンプラットフォームで、使いやすいノーコードアプリビルダーでパワフルなAIアプリを作成できます。Llama 3、Claude Sonnet 3.5、GPT-4、Uncensored LLMs、Stable Diffusionなどを使用して、数分で夢のAIアプリを構築できます。

Fish Speech TTSとは何ですか?

Fish Speech TTSは、テキスト入力から人のような音声を生成するために設計されており、英語、中国語、日本語をサポートしています。このシステムのアーキテクチャは、最新の機械学習モデルと技術を活用して、優れたパフォーマンスと柔軟性を実現しています。

Fish Speech TTSの主な特徴は次のとおりです:

多言語サポート:このシステムは、英語、中国語、日本語で音声を生成できるため、さまざまなアプリケーションや市場に適しています。

高品質な出力:Fish Speechは、商用のソリューションと遜色ない、適切なイントネーション、リズム、アクセントを持つ自然な音声を生成します。

高速推論:モデルの動作速度はおおよそ1秒あたり20トークンであり、高速なコンテンツ生成(GPUの場合、約1秒あたり20秒のオーディオ)が可能です。

カスタマイズ性:ユーザーは独自のデータでモデルを微調整できるため、ボイスクローニングや個別の音声合成が可能です。

オープンソース:コードベース全体がGitHub上で公開されており、透明性とコミュニティ主導の開発を促進しています。

スケーラビリティ:Fish Speechは、Medium(400Mパラメータ)とLarge(1Bパラメータ)の2つのバージョンで利用可能であり、さまざまな計算要件とユースケースに対応しています。

Fish Speech TTSはどのように動作しますか?

Fish Speech TTSシステムは、音声合成のいくつかの切り口技術を組み合わせた洗練されたアーキテクチャを採用しています。

テキストから意味モデルへの変換

Fish Speechの中心には、LLAMAアーキテクチャに基づいた大規模な言語モデル(LLM)があります。このモデルは、入力テキストを意味表現に変換し、テキストの意味と意図を捉えます。LLMは膨大なテキストデータでトレーニングされており、文脈を理解し適切な意味エンコーディングを生成することができます。

音声生成のためのVQGAN

Fish Speechは、意味表現をオーディオ特徴に変換するために、ベクトル量子化生成対抗ネットワーク(VQGAN)を使用しています。このコンポーネントは、語法、イントネーション、話者の特徴など、音声の微妙なニュアンスを捉えるのに重要です。

VITSデコーダ

Fish Speechのバージョン1.1では、VITS(end-to-endテキストから音声変換のための変分推論と対抗学習)デコーダを導入しました。この追加により、単語エラーレートの低下や音色の類似性の向上が図られ、より正確で自然な音声出力が可能となります。

デュアルARデコーディング戦略

Fish Speechは、安定した高品質な音声生成を保証するために、デュアル自己回帰(AR)デコーディング戦略を採用しています。このアプローチでは、2つの自己回帰モデルが使用されます:

- 最初のARモデルは、おおよそ1秒あたり20トークンの速度で隠れた特徴をデコードします。

- 2番目のARモデルは、これらの特徴を最終的なオーディオコードブックにデコードします。

この戦略は、他のメソッドと比べて信頼性が高く、特に大量のコードブックを扱う場合に有効です。

トレーニングプロセスとデータ

Fish Speechの開発には、大規模かつ計算量の多いトレーニングプロセスが必要でした。このモデルは、英語、中国語、日本語の合計150,000時間のオーディオデータセットでトレーニングされました(各言語につき50,000時間)。初期の事前トレーニングフェーズには、16基のNVIDIA A800 GPUを使用して約1週間の計算時間が必要でした。このフェーズでは、モデルが3つのサポートされる言語全体の音声パターンと特性を学習することができました。事前トレーニングに続いて、モデルは高品質な混合言語データセット(1,000時間)で監督された微調整(SFT)を行いました。このステップにより、モデルの出力品質が向上し、言語間での一貫性が確保されました。

パフォーマンスとベンチマーク

Fish Speech TTSは、音声品質と自然さの面で商用ソリューションと匹敵する、または時には上回る印象的なパフォーマンスを発揮しています。モデルがおおよそ1秒あたり20トークンでコンテンツを生成する能力は、NVIDIA 4090のような上位GPU上では約1秒あたり20秒のオーディオを生成することを意味します。この高速化の利点は特に注目に値し、遅いTTSシステムでは単語や文の欠落や繰り返しの可能性を低減します。

ここでは、Fish Speech TTSを異なるオペレーティングシステムで実行する方法と、簡単な説明を追加します。

Windows/LinuxでFish Speech TTSを実行する方法

Windows

- python.orgからPython 3.9以降をインストールします

- コマンドプロンプトを開き、以下を実行します:

pip install torch torchvision torchaudio - git-scm.comからGitをインストールします

- リポジトリをクローンします:

git clone https://github.com/fishaudio/fish-speech.git - プロジェクトディレクトリに移動します:

cd fish-speech - 依存関係をインストールします:

pip install -e . - WebUIを実行します:

python webui.py

Linux

- パッケージマネージャをアップデートします:

sudo apt update(Ubuntu/Debianの場合) - Pythonをインストールします:

sudo apt install python3 python3-pip - PyTorchをインストールします:

pip3 install torch torchvision torchaudio - Gitをインストールします:

sudo apt install git - リポジトリをクローンします:

git clone https://github.com/fishaudio/fish-speech.git - プロジェクトディレクトリに移動します:

cd fish-speech - 依存関係をインストールします:

pip3 install -e . - Flash Attentionをインストールします:

pip3 install ninja && MAX_JOBS=4 pip3 install flash-attn --no-build-isolation - WebUIを実行します:

python3 webui.py

Fish Speech TTSは、さまざまなプラットフォーム向けのカスタマイズ可能な高品質なマルチ言語音声合成を提供する強力なオープンソーステキスト読み上げソリューションです。

結論

Fish Speech TTSは、オープンソースの音声合成技術における重要なマイルストーンです。高品質なマルチ言語テキスト読み上げ機能をアクセス可能な形式で提供することにより、開発者、研究者、ビジネスが高度な音声技術をプロジェクトやアプリケーションに組み込む力を与えます。

豊富なトレーニングデータ、洗練されたモデルアーキテクチャ、継続的な開発の取り組みの組み合わせにより、Fish Speechは商用のTTSソリューションに対する魅力的な代替手段となっています。プロジェクトが進化し改善するにつれて、それはアクセシビリティや教育、エンターテイメントや顧客サービスなど、さまざまな分野でイノベーションを促進する潜在能力を持っています。

音声合成の将来を探求または貢献したい方にとって、Fish Speech TTSは、オープンで協力的な環境で最先端の技術に関わるための魅力的な機会を提供します。自分のプロジェクトにTTSを実装するか、音声技術の進歩に貢献することを目指すには、Fish Speechは堅牢かつ柔軟な基盤を提供します。

それなら、Anakin AIを見逃すことはできません!

Anakin AIは、ノーコードの簡単なアプリビルダーでパワフルなAIアプリを作成するワークフロー自動化のためのオールインワンプラットフォームです。Llama 3、Claude Sonnet 3.5、GPT-4、Uncensored LLMs、Stable Diffusionなどを使用して、数分で夢のAIアプリを構築できます。