AIコミュニティの注目を集める驚きの動きとして、Appleが7BのDCLM(DataComp for Language Models)ベースモデルのウェイトを公開しました。このリリースは、オープンソースAIの世界においてAppleの言語モデルの研究と開発への取り組みを示す重要な一歩となります。DCLM-7Bモデルは、体系的なデータキュレーション技術の効果を示すために設計され、すぐに研究者や開発者の間で関心のあるトピックとなりました。

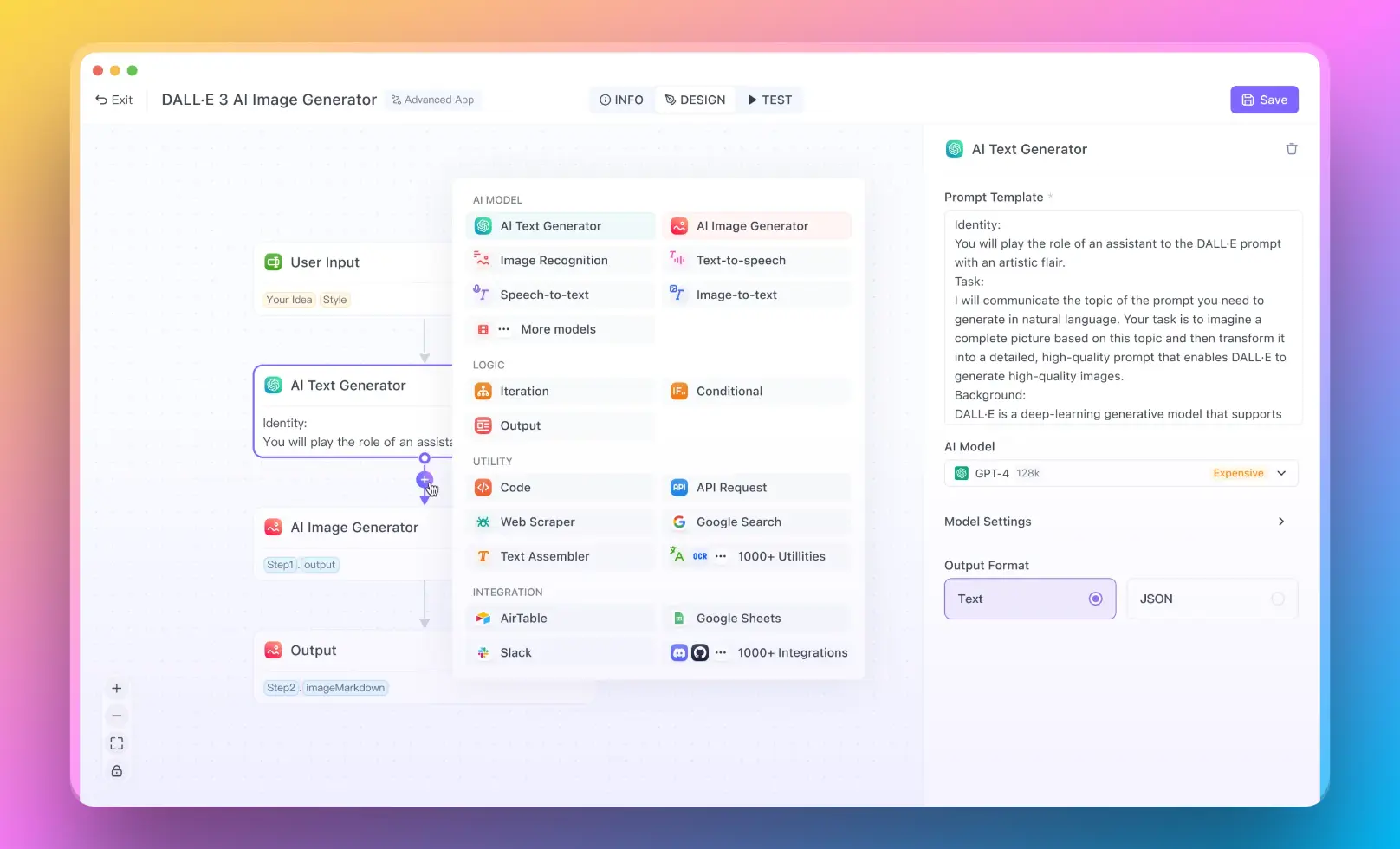

Anakin AIを使用すれば、コーディングの知識なしで簡単にAIワークフローを作成できます。GPT-4、Claude 3.5 Sonnet、Uncensored Dolphin-Mixtral、Stable Diffusion、DALLE、Web ScrapingなどのLLM APIに接続して、ワークフローを一つに統合できます!

複雑なコーディングを忘れて、Anakin AIで日々の作業を自動化しましょう!

期間限定で、Google Gemini 1.5とStable Diffusionを無料で使用することもできます!

DCLM-7Bとは、Appleのオープンソース7Bモデルですか?

DCLM-Baseline-7Bは、DCLM-Baselineデータセットで訓練された70億パラメータの言語モデルです。このデータセットは、データの品質がモデルの性能に与える影響を強調するために、データキュレーションの一環として慎重に作成されました。このモデルは、2.5兆トークンで訓練され、コンテキストの長さが2048トークンであることなど、印象的な仕様を持っています。さらに、Appleは8Kの拡張コンテキスト長を備えたバージョンもリリースしており、その機能をさらに拡張しています。

DCLM-7Bの主な特徴

- パラメータ数:70億のパラメータ

- トレーニングデータ:2.5兆トークン

- 初期コンテキスト長:2048トークン

- 拡張コンテキスト長:8Kトークン(更新バージョンで)

- ライセンス:Apple ASCL(MITライセンスに類似)

- 入手性:Hugging Faceで公開されています

AppleによるDCLM-7BのApple ASCLライセンスでの公開は、オープンソースAIコミュニティへの貢献を意図したものです。この動きにより、研究者や開発者はモデルを自由に使用、変更、配布することができるようになり、自然言語処理と理解の進展を加速する可能性があります。

パフォーマンスの比較:DCLM-7B vs. Mistral 7B

AppleのDCLM-7Bの能力を理解するために、同じパラメータ範囲の他の優れたモデルと比較することが重要です。特にMistral AIによって開発され、オープンソースコミュニティで広く採用されているMistral 7Bは、優れた比較基準として機能します。

ベンチマークの比較

| ベンチマーク | DCLM-7B | Mistral 7B |

|---|---|---|

| MMLU | 57.1 | 62.6 |

| ARC-c | 50.8 | 63.7 |

| HellaSwag | 78.5 | 83.1 |

| TruthfulQA | 45.4 | 44.9 |

| GSM8K | 31.8 | 35.4 |

| HumanEval | 25.0 | 26.2 |

注:これらの数字は概算であり、利用可能なデータに基づいています。実際のパフォーマンスは、特定の評価条件によって異なる場合があります。

パフォーマンスの分析

一般的な知識と推論:Mistral 7Bは、多様な知識と推論を必要とするタスクでわずかに優位性を示しており、MMLU(マルチタスク言語理解)とARC-c(AI2推論チャレンジ)のスコアが高いことで示されます。

常識と文脈理解:共通のセンスの推論や状況理解をテストするHellaSwagベンチマークでは、Mistral 7Bが有利であり、文脈の微妙なニュアンスをより理解していることを示しています。

真実性:TruthfulQAベンチマークでは、DCLM-7Bの方がわずかに優れたパフォーマンスを示しており、正確で真実性のある回答を提供する能力にわずかな利点があることを示しています。

数学的な推論:Grade School Math 8K(GSM8K)ベンチマークでは、Mistral 7Bがわずかにリードしており、基本的な数学的問題解決におけるパフォーマンスが優れています。

コード生成:コード生成能力を評価するHumanEvalベンチマークでは、わずかな差はありますが、Mistral 7Bがわずかに優れています。

Mistral 7Bがいくつかのベンチマークで優れたパフォーマンスを示しているようですが、DCLM-7Bは特に真実性を持つ点で地位を守っています。パフォーマンスの違いは顕著ですが、圧倒的に大きいわけではなく、DCLM-7Bは自らのクラスで競争力のあるモデルであることを示しています。

DCLM-Baselineデータセット:モデルトレーニングの画期的な変化

AppleのDCLM-7Bリリースの最も興味深い側面の一つは、付属するDCLM-Baselineデータセットです。このデータセットは、モデルのトレーニングの基盤を築くもので、言語モデルの性能向上においてデータの品質とキュレーションに重点を置くAppleの取り組みを物語っています。

データセットの特徴

- サイズ:約7.2TB(zstd圧縮)

- 構成:さまざまな高品質なテキストデータ

- キュレーションプロセス:最適な学習のために体系的に選択され、フィルタリングされました

- 入手性:オープンソースで、Hugging Face経由でアクセスできます

DCLM-Baselineデータセットは、AIコミュニティにおける重要な貢献です。そのサイズと品質は、研究者や開発者が独自の言語モデルを訓練または微調整する際に貴重なリソースとなります。データセットのオープンソースライセンスにより、Appleのイノベーションへの取り組みがさらに強調されています。

モデルパフォーマンスへの影響

DCLM-Baselineデータセットの注意深いキュレーションは、DCLM-7Bモデルのパフォーマンスに重要な役割を果たしています。高品質で多様なデータに焦点を当てることで、Appleはバイアス、不正確性、および限られたドメイン知識などの言語モデルの一般的な課題に取り組んでいます。このアプローチにより、さまざまなタスクにおいてより堅牢で信頼性の高いモデルの出力が可能になる可能性があります。

Apple/DCLM-7BのHugging Faceカードをチェックしてみてください:

AIコミュニティへの影響

DCLM-7Bおよび関連するデータセットのリリースは、AIコミュニティにいくつかの重要な影響をもたらします:

AIの民主化:高品質なモデルとデータセットを公開することで、AppleはAI技術の民主化に貢献し、小規模なチームや個々の研究者が最先端のリソースを活用できるようにします。

データキュレーションの基準:DCLM-Baselineデータセットは、言語モデルのトレーニングにおけるデータキュレーションの新たな基準を設定し、将来のデータセット作成方法論に影響を与える可能性があります。

研究の機会:モデルとデータセットの両方が利用可能であることにより、モデルの解釈性、微調整戦略、データセットの分析などの新しい研究の可能性が開かれます。

産業競争:AppleのオープンソースLLM領域への参入により、テックジャイアント間の競争が激化し、フィールドのイノベーションが加速する可能性があります。

倫理的な考慮事項:DCLM-7Bのデータ品質とキュレーションへの焦点は、倫理的なAI開発と慎重に選択されたトレーニングデータのバイアスの軽減とモデルの信頼性の向上について重要な問題を提起します。

課題と今後の展望

DCLM-7Bのリリースは間違いなくポジティブな展開ですが、同時にいくつかの課題と改善の余地もあります:

計算要件:データセットの大きさ(7.2TB)は、計算リソースに限りがある研究者にとって課題となる可能性があり、アクセス性が制限されるかもしれません。

ベンチマーキングの一貫性:Mistral 7Bとのパフォーマンス比較で示されているように、公正かつ一貫性のあるモデル評価を確保するために、標準化されたベンチマーキングの実践が必要です。

特殊化 vs 汎化:DCLM-7Bモデルが特定のタスクの特殊化と一般言語理解能力をどのようにバランスさせるかについて、将来の研究が探求できるでしょう。

倫理的な使用と展開:強力な言語モデルと同様に、DCLM-7Bの倫理的な使用と責任ある展開を確保することは重要です。さまざまなアプリケーションでの採用が進むにつれて、これが重要となります。

継続的な開発:AppleがDCLMモデルシリーズの開発とサポートをどのように続けるか、より大きなモデルのリリースや特定のドメイン向けの専門バージョンの可能性を含め、今後の展開が注目されます。

結論

AppleによるDCLM-7BモデルとDCLM-Baselineデータセットのリリースは、オープンソースAIの分野における重要なマイルストーンを示しています。モデルのパフォーマンスは、Mistral 7Bなどの他の7Bパラメータモデルと競争力があるものの、その真価はデータキュレーションへのアプローチとAppleがリソースを共有したオープンな姿勢にあります。

DCLM-7Bモデルとデータセットは、自然言語処理のさらなる研究と開発のための確固たる基盤を提供しています。データの品質がモデルのパフォーマンスに与える影響や、より堅牢で信頼性の高い言語モデルの開発におけるデータ品質の重要性を探る新たな可能性を提供します。

DCLM-7BについてAIコミュニティがさらに分析し、取り組むと、革新的な応用、洗練された手法、および言語モデルの評価のための新しいベンチマークが期待されます。Appleの貢献は、研究者や開発者が利用できるツールを向上させるだけでなく、大手テック企業がオープンソースのAIエコシステムにどのように意義のある貢献をするかの前例を示しています。

DCLM-7Bのリリースは、単なる新しいモデルの導入以上のものであり、AIの開発におけるより協力的でオープンなアプローチへの一歩です。これから先、モデルとデータセットが言語モデルの研究と応用の軌道にどのように影響を与えるかを見ていくことは、効率的で正確かつ倫理的に適合したAIシステムの可能性を切り拓く上で興味深いものとなるでしょう。