以下のHTMLコードを日本語に翻訳してください。 次のURLがあることを確認してください: https://anakin.ai/apps/keyword または https://anakin.ai/blog/keyword これらを以下のように変換する https://anakin.ai/ja-jp/apps/keyword https://anakin.ai/ja-jp/blog/keyword 以下がHTMLです:

素早く進化するテクノロジーの世界では、言語モデルをアプリケーションに統合することが自然言語処理(NLP)のイノベーションの礎となっています。Python向けの強力なライブラリであるLangChainは、CTransformersなどのツールを提供することで、これらの統合を簡素化しています。CTransformersはC/C ++実装の高速性を活かしながらPythonの柔軟性を維持し、開発者が複雑な言語モデルを効率的に展開することを容易にします。この記事では、LangChainフレームワーク内のCTransformersの機能、実用例、インストールガイド、および活気あるLangChainコミュニティの洞察について詳しく説明します。

TL;DR: クイック概要

- LangChainとCTransformersをインストールする:これらのツールをPython環境に簡単に追加します。

- CTransformersでテキストを生成する:事前学習済みモデルを使用してテキストを作成します。

- 高度な機能を探索する:動的なテキスト生成にストリーミングを実装します。

- LangChainコミュニティに参加する:NLPの愛好家や専門家のネットワークと関わります。

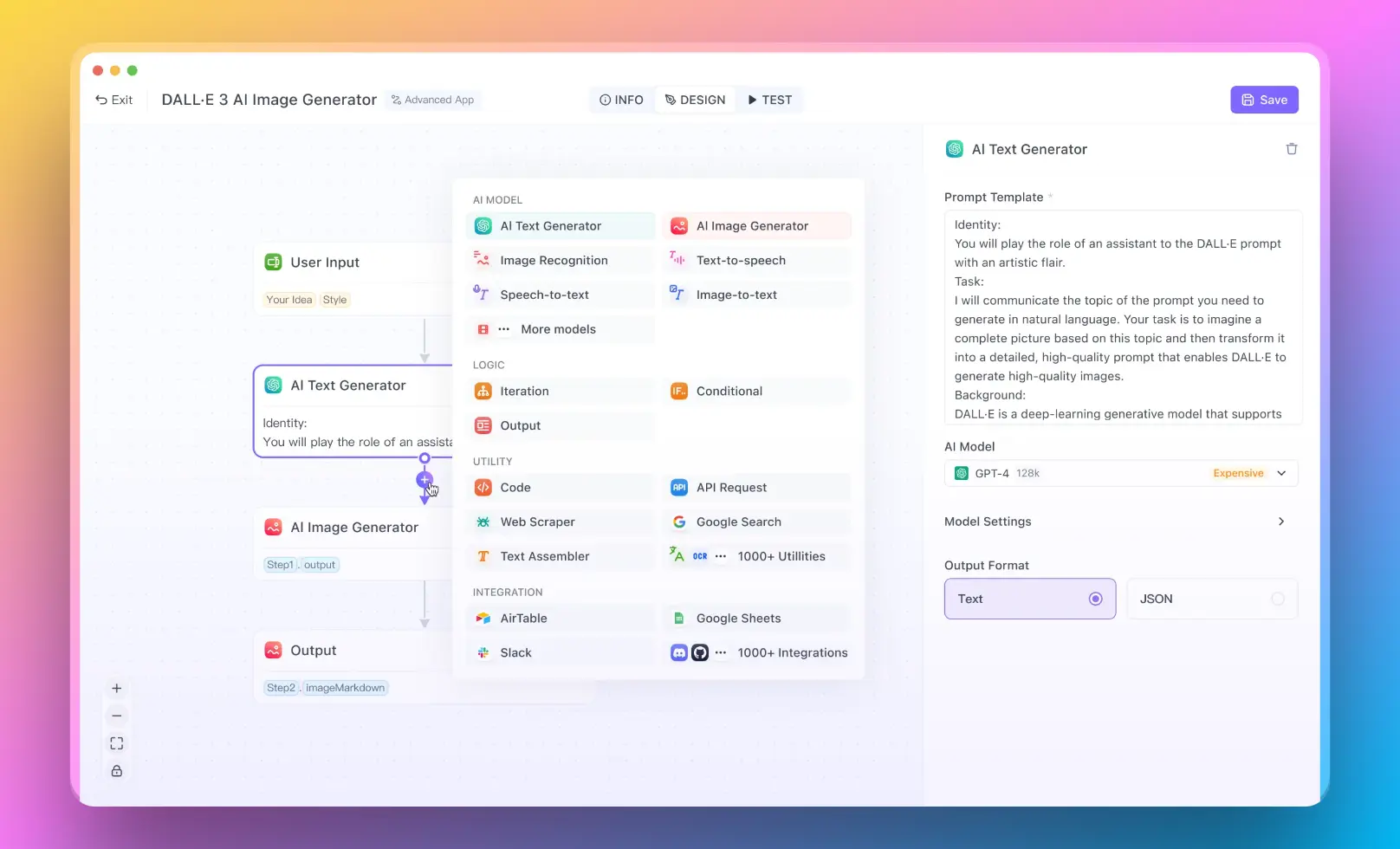

- コーディング経験がないユーザー向けに、Anakin AIでRAGシステムを実行することもできます。No Code Builderを使用して、素晴らしいAIアプリを作成できます!

LangChain内のCTransformersとは何ですか?

LangChain内のCTransformersは、特にGGMLライブラリで最適化されたTransformerモデルのPythonでの使用を容易にする強力な抽象化レイヤーを表します。これにより、これらのモデルのスムーズな実行を可能にするPythonバインディングが提供され、さまざまなモデルタイプに対する統一されたインターフェースが提供されます。この互換性は、Hugging Face Hubにホストされているモデルにも拡張され、アクセス可能なリソースの範囲がさらに広がります。

PythonでLangChainをインストールする方法

PythonでLangChainをインストールするには、次の単一のコマンドを使用します:

pip install langchain

このコマンドは、LangChainとその依存関係をインストールし、CTransformersの統合とその包括的な機能の利用のための準備を整えます。

LangChainコミュニティとは何ですか?

LangChainコミュニティは、言語モデルとそのアプリケーションの探索と進化に焦点を当てた開発者、研究者、愛好家からなる活気に満ちたエコシステムです。このコミュニティでは、CTransformersなどのツールなどの洞察、ツール、リソースを共有して、イノベーションと協力を促進しています。LangChainライブラリへのコミュニティの貢献(ドキュメント、例、サポートなど)は、最先端のNLPテクノロジーへのアクセスの民主化に重要な役割を果たしています。

LangChainでCTransformersを使用する手順

LangChainとCTransformersをインストールする

例を詳しく説明する前に、環境を設定することが重要です。以下の手順でPythonでLangChainとCTransformersをインストールします:

pip install langchain

pip install ctransformers

この簡単なインストールプロセスにより、LangChainフレームワーク内のCTransformersを試行するために必要なツールが提供されます。

LangChainでのCTransformersの基本的な使用方法

まず、LangChain内のCTransformersでモデルをロードして使用する方法を調べてみましょう:

from langchain_community.llms import CTransformers

# CTransformersモデルの初期化

llm = CTransformers(model='marella/gpt-2-ggml')

# テキストの生成

response = llm.invoke("AI is going to")

print(response)

このスニペットは、モデルをロードしてテキストを生成する方法を示しており、CTransformersとLangChainのシームレスな統合を示しています。

ストリーミングを用いた高度なテキスト生成

ストリーミングテキスト生成などのより複雑なシナリオには、CTransformersが優れた対応を提供します:

from langchain.callbacks.streaming_stdout import StreamingStdOutCallbackHandler

# ストリーミング機能を備えたCTransformersの設定

llm = CTransformers(

model="marella/gpt-2-ggml",

callbacks=[StreamingStdOutCallbackHandler()]

)

# ストリーミングでモデルを呼び出す

response = llm.invoke("AI is going to")

この例では、ストリーミングを使用してテキスト生成プロセスを拡張し、ダイナミックなアプリケーションのリアルタイム出力を可能にする方法を示しています。

LangChainでのCTransformersによる感情分析の実行

このシナリオでは、Hugging Face Hubで利用可能な事前学習済みの感情分析モデルにCTransformersを介してアクセスできると考えます。モデルは入力テキストの感情を分類します。この例では、デモンストレーションのために架空のモデル名「sentiment-analysis-ggml」を使用しています。これを実際のモデル名に置き換える必要があります。

ステップ1:LangChainとCTransformersをインストールする

まず、LangChainとCTransformersがPython環境にインストールされていることを確認します。まだインストールしていない場合は、次のコマンドを実行してインストールできます:

pip install langchain

pip install ctransformers

ステップ2:必要なライブラリをインポートする

次に、LangChainおよびその他必要なライブラリから必要なコンポーネントをインポートします:

from langchain_community.llms import CTransformers

ステップ3:感情分析モデルを初期化する

さて、CTransformersを使用して感情分析モデルを初期化しましょう。使用する実際のモデル名に「sentiment-analysis-ggml」を置き換えてください。

# 感情分析モデルの初期化

sentiment_model = CTransformers(model='sentiment-analysis-ggml')

ステップ4:感情分析を実行する

モデルを初期化したら、任意のテキストに対して感情分析を実行できます。サンプルの文の感情を分析してみましょう:

# サンプルテキスト

text = "LangChainとCTransformersを使用すると、NLPのタスクが非常に簡単で効率的になります。"

# 感情分析を実行

sentiment_result = sentiment_model.invoke(text)

print(sentiment_result)

このコードスニペットは、感情分析の結果を出力します。結果には通常、分類(例:「positive」または「negative」)と、モデルの出力形式に応じて信頼スコアが含まれます。

結論

LangChain内のCTransformersは、C/C ++の効率性とPythonの柔軟性を結びつける革新的なツールとして登場します。具体的な例とインストールガイドによって、この記事では開発者がプロジェクト内でCTransformersのパワーを利用するための道筋が明らかにされました。LangChainコミュニティは、NLPの分野を前進させるための協力とイノベーションの拠点として引き続き存在しています。

LangChainでCTransformersと共に旅に出て、アプリケーション内の言語モデルのフルポテンシャルを引き出しましょう。