急速に進化する人工知能の分野において、強力で検閲されていない言語モデルにローカルでアクセスできることは、開発者、研究者、AI愛好者にとって前例のない自由を提供します。DeepSeekによって開発された最先端の言語モデル、DeepSeek R1は、OpenAIの製品に匹敵する印象的な推論能力で大きな注目を集めています。この包括的なガイドでは、あなたのローカルマシンでDeepSeek R1の検閲されていないバージョンを実行するために知っておくべきすべてを案内し、AIとのインタラクションに対する完全な制御とプライバシーを提供します。

DeepSeek R1の理解:強力な推論モデル

DeepSeek R1は、オープンソースAI技術における重要な進展を示しています。このモデルは、特に次のような複雑なベンチマークで卓越したパフォーマンスを発揮しています:

- 多段階の問題解決を必要とする高度な推論タスク

- 数学計算およびアルゴリズム的問題解決

- 高精度のコーディングおよび技術文書作成

- さまざまな分野にわたるクリエイティブなコンテンツ生成

DeepSeek R1の標準バージョンには、特定のタイプの出力を制限するための安全メカニズムが組み込まれています。ただし、多くのユーザーは、こうした制限が逆効果になる合法的な研究、クリエイティブな適用、または専門的な使用ケースのために、検閲されていないバージョンを求めています。

なぜローカルで検閲されていないDeepSeek R1を実行するのか?

ローカルで検閲されていないDeepSeek R1のバージョンを実行することには、いくつかの魅力的な利点があります:

- 完全なプライバシー: あなたのデータとプロンプトは決してマシンを離れません

- 使用料なし: クラウドAPIに関連するトークンごとの費用やサブスクリプションコストを回避できます

- カスタマイズ: 制限なくパラメータやシステムプロンプトを微調整できます

- オフライン機能: インターネット接続なしで高度なAIを使用できます

- 制限なし: ハードウェアが処理できるだけのクエリを実行できます

アブリテレーションプロセス:検閲されていない状態への移行

DeepSeek R1のような言語モデルから安全フィルターを取り除くプロセスは、しばしば「アブリテレーション」と呼ばれます。従来の微調整が広範な再訓練を必要とするのに対し、アブリテレーションはモデルの内部の活性化パターンを変更して、特定のプロンプトを拒否する傾向を抑制します。

このプロセスは、人工的な制約を取り除きながらコアの推論能力を保持し、次のようなモデルを実現します:

- 元の知性と能力を維持する

- 拒否することなくより広範囲なプロンプトに応答する

- 創造的かつ物議を醸すトピックを探求することを許可する

Anakin AIの紹介:AIワークフローへのゲートウェイ

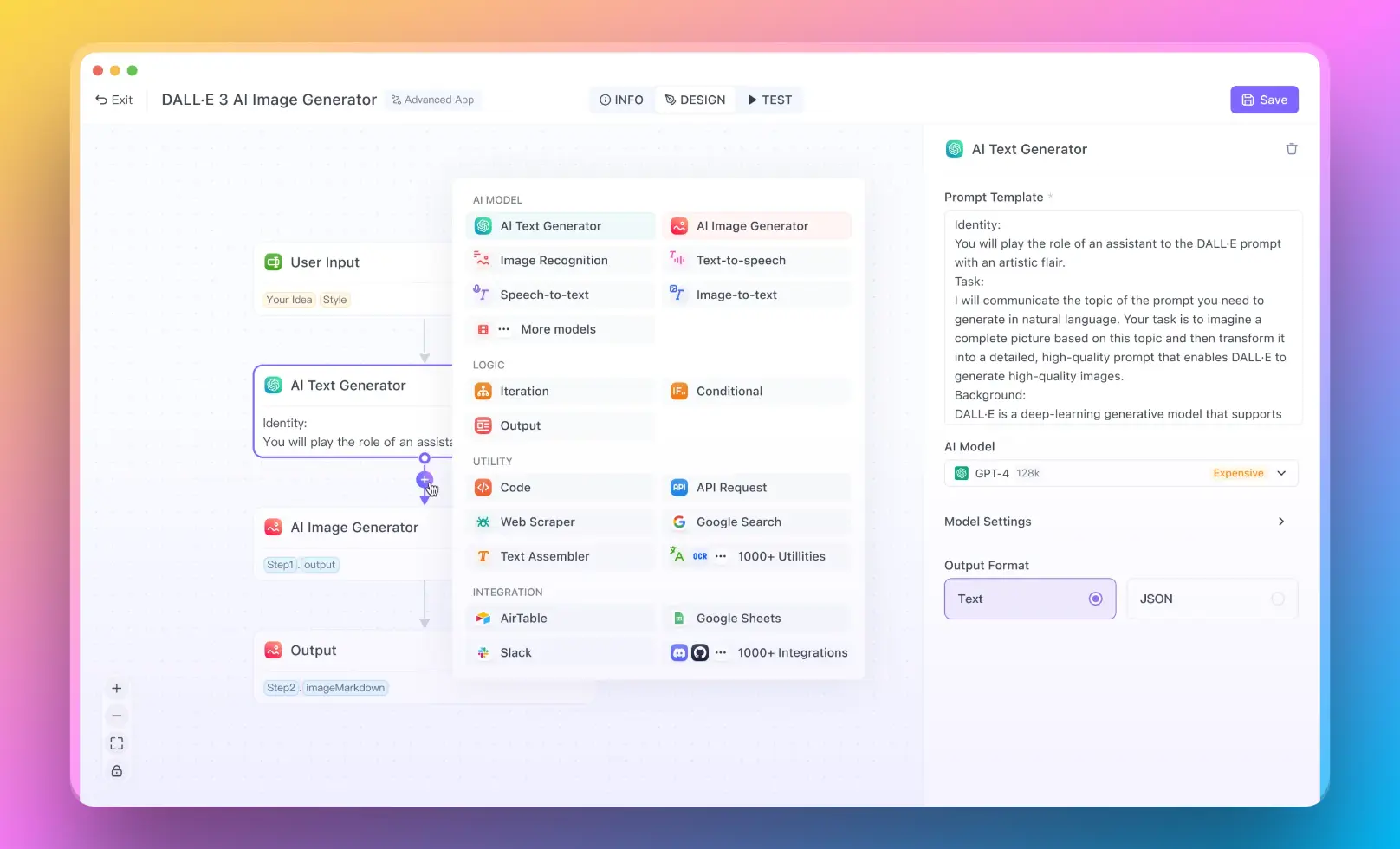

ローカルインストールに入る前に、検閲されていないモデル(DeepSeek R1など)で作業するための強力なプラットフォームとしてAnakin AIを考慮する価値があります。

Anakin AIは、検閲されていないDeepSeek R1を含むさまざまな強力なモデルを活用できるAIワークフローを作成するためのノーコードソリューションを提供します。

Anakin AIを使用して、あなたは:

- DeepSeek R1、GPT-4、Claude 3.5、そして検閲されていないDolphin-Mixtralを含むさまざまなLLM APIに接続する

- プログラミング知識なしで複雑なAIワークフローを作成する

- AI画像生成(FLUX)および音声/動画生成(Minimax)を統合する

- さまざまなユースケースのための1000以上の事前構築されたAIアプリにアクセスする

検閲されていないDeepSeek R1で迅速にスタートを切りたいが、ローカル展開の技術的な複雑さを管理したくない方には、Anakin AIが優れた代替手段を提供します。しかし、完全なローカルセットアップにコミットする方のために、インストールガイドに進みましょう。

ローカルでDeepSeek R1を実行するためのハードウェア要件

DeepSeek R1は、いくつかのサイズで利用でき、リソース要件はそれに応じてスケーリングします:

最小要件:

- GPU: 8Bパラメータモデルに対して最低8GBのVRAMを持つNVIDIA GPU

- RAM: 最低16GB(32GB以上を推奨)

- ストレージ: モデルサイズに応じて15-40GBの空き容量

- CPU: モダンなマルチコアプロセッサ(Intel i7/Ryzen 7以上)

大きなモデル(32B/70B)の推奨:

- GPU: NVIDIA RTX 4090(24GB VRAM)または複数のGPU

- RAM: 64GB以上

- ストレージ: 100GB以上の空き容量を持つNVMe SSD

- CPU: 8つ以上の物理コアを持つハイエンドプロセッサ

Ollamaを使用して検閲されていないDeepSeek R1をインストールおよび実行する

Ollamaは、ローカルで大規模な言語モデルを実行するのを簡素化するユーザーフレンドリーなツールです。次の手順で、検閲されていないDeepSeek R1をデプロイできます:

ステップ1: Ollamaをインストールする

macOS/Linuxの場合:

curl -fsSL https://ollama.com/install.sh | sh

Windowsの場合:

Ollamaの公式ウェブサイトからインストーラーをダウンロードしてください。

ステップ2: モデルをプルする

ハードウェアの能力に応じて、適切なモデルサイズを選択します:

# 低リソースの8Bパラメータバージョンの場合

ollama pull deepseek-r1:8b

# ハードウェアがサポートする場合の大きなバージョン

ollama pull deepseek-r1:32b

ollama pull deepseek-r1:70b

特に検閲されていないバージョンに関しては、コミュニティが提供したモデルを使用する必要があるかもしれません:

ollama pull huihui_ai/deepseek-r1-abliterated:8b

ステップ3: モデルを実行する

インストールしたモデルでインタラクティブセッションを開始します:

ollama run deepseek-r1:8b

または、検閲されていないバージョンの場合:

ollama run huihui_ai/deepseek-r1-abliterated:8b

これで、コマンドラインを介してモデルと直接対話できます。

ステップ4: アプリケーションとの統合

Ollamaは、他のアプリケーションとモデルを統合するREST APIを提供しています:

- APIエンドポイント: http://localhost:11434

- サンプルリクエスト:

POST http://localhost:11434/api/generate

{

"model": "deepseek-r1:8b",

"prompt": "ここにプロンプトを入力",

"stream": true

}

最適なパフォーマンスのための高度な設定

量子化オプション

量子化は、品質に最小限の影響を与えながらモデルのメモリフットプリントを削減します:

- Q4_K_M: 品質とパフォーマンスの最良のバランス

- Q6_K: より高い品質だが、より多くのVRAMが必要

- Q2_K: 限られたハードウェアのための最大効率

パラメータ調整

これらのパラメータでモデルの動作を微調整します:

ollama run deepseek-r1:8b -c '

{

"temperature": 0.7,

"top_p": 0.9,

"context_length": 4096,

"repeat_penalty": 1.1

}'

GPUレイヤーの割り当て

限られたVRAMがある場合は、GPUにオフロードするレイヤーの数を指定できます:

ollama run deepseek-r1:8b --gpu-layers 32

Anakin AIを使用して強化されたワークフローを実現

前述のように、Anakin AIは複雑なローカルセットアップのための強力な代替手段を提供します。Anakin AIが検閲されていないDeepSeek R1との体験をどのように強化できるかをご紹介します:

- ノーコードワークフロー作成: プログラミングなしで複雑なAIワークフローを視覚的に構築する

- 複数モデルの統合: 同じワークフロー内でDeepSeek R1を他のモデルと組み合わせる

- 事前構築されたテンプレート: 様々なアプリケーションに特化したテンプレートにアクセスする

- コスト効率: インフラを管理することなく、使用した分だけを支払う

Anakin AIを始めるためには:

- Anakin AIプラットフォームにサインアップする

- 利用可能なモデルからDeepSeek R1を選択する

- ドラッグ&ドロップインターフェースを使用してワークフローを視覚的に構築する

- ワンクリックでソリューションをデプロイする

倫理的配慮と責任ある使用

検閲されていないモデルは合法的なアプリケーションに貴重な自由を提供しますが、同時に責任も伴います:

- コンテンツモニタリング: ユーザー向けアプリケーションには独自のコンテンツフィルタリングを実装する

- 法的遵守: 使用が地元の法律および規制を遵守していることを確認する

- プライバシー保護: 特に機密情報を処理する際には、ユーザーデータを責任を持って取り扱う

- 危害防止: 個人やグループに直接的な危害を及ぼす可能性のあるアプリケーションを避ける

一般的な問題のトラブルシューティング

メモリエラー

CUDAのメモリ不足エラーが発生した場合:

- コンテキストの長さを減らす

- より攻撃的な量子化を使用する(例:Q6_Kの代わりにQ4_K_M)

- GPUに割り当てるレイヤーを減らす

- 他のGPU集中的なアプリケーションを閉じる

パフォーマンスが遅い

パフォーマンスを向上させるためには:

- 利用可能な場合はGPUアクセラレーションを有効にする

- モデルストレージにNVMe SSDを使用する

- バッチサイズとスレッド数を最適化する

- 大きなモデル用にハードウェアをアップグレードすることを検討する

モデルの幻覚

出力の不正確さを減らすためには:

- 温度設定を下げる

- リピートペナルティを増やす

- 明示的な指示を伴う詳細なプロンプトを提供する

- モデルの動作を導くシステムプロンプトを使用する

結論

検閲されていないDeepSeek R1モデルをローカルで実行することで、強力なAI機能に完全なプライバシーと制御を持ってアクセスできます。Ollamaを通じたローカルインストールの技術的なルートを選択するか、Anakin AIの簡素化された体験を選ぶかにかかわらず、特定のニーズにこの最先端モデルをデプロイするために必要な知識を持っています。

技術的な側面と倫理的な考慮事項の両方を理解することで、検閲されていないAIモデルを責任を持って活用し、彼らが提供する可能性の全範囲を探求することができます。言語モデルが進化し続ける中で、ローカルにデプロイし、カスタマイズするスキルを持つことは、開発者、研究者、そしてAI愛好者にとって貴重な資産であり続けます。

大きな力には大きな責任が伴うことを忘れないでください。これらの機能を倫理的に、法的に、そして注意深く使用し、AI技術の進歩に対してポジティブに寄与してください。