急速に進化する人工知能の分野において、強力なAIモデルへのアクセスは、従来は高いコストや技術的な要件によって制限されていました。中国のAI企業DeepSeekによって開発された最先端の言語モデルDeepSeek AIは、この領域でのゲームチェンジャーとして登場しました。OpenAIの製品に匹敵するパフォーマンスを持つDeepSeekのオープンソースアプローチは、高度なAI機能へのアクセスを平等にしました。この包括的なガイドでは、DeepSeek AIを完璧に無料で利用するためのさまざまな方法を紹介し、財政的制約なしにこの技術を活用できるようにします。

それなら、Anakin AIを見逃すことはできません!

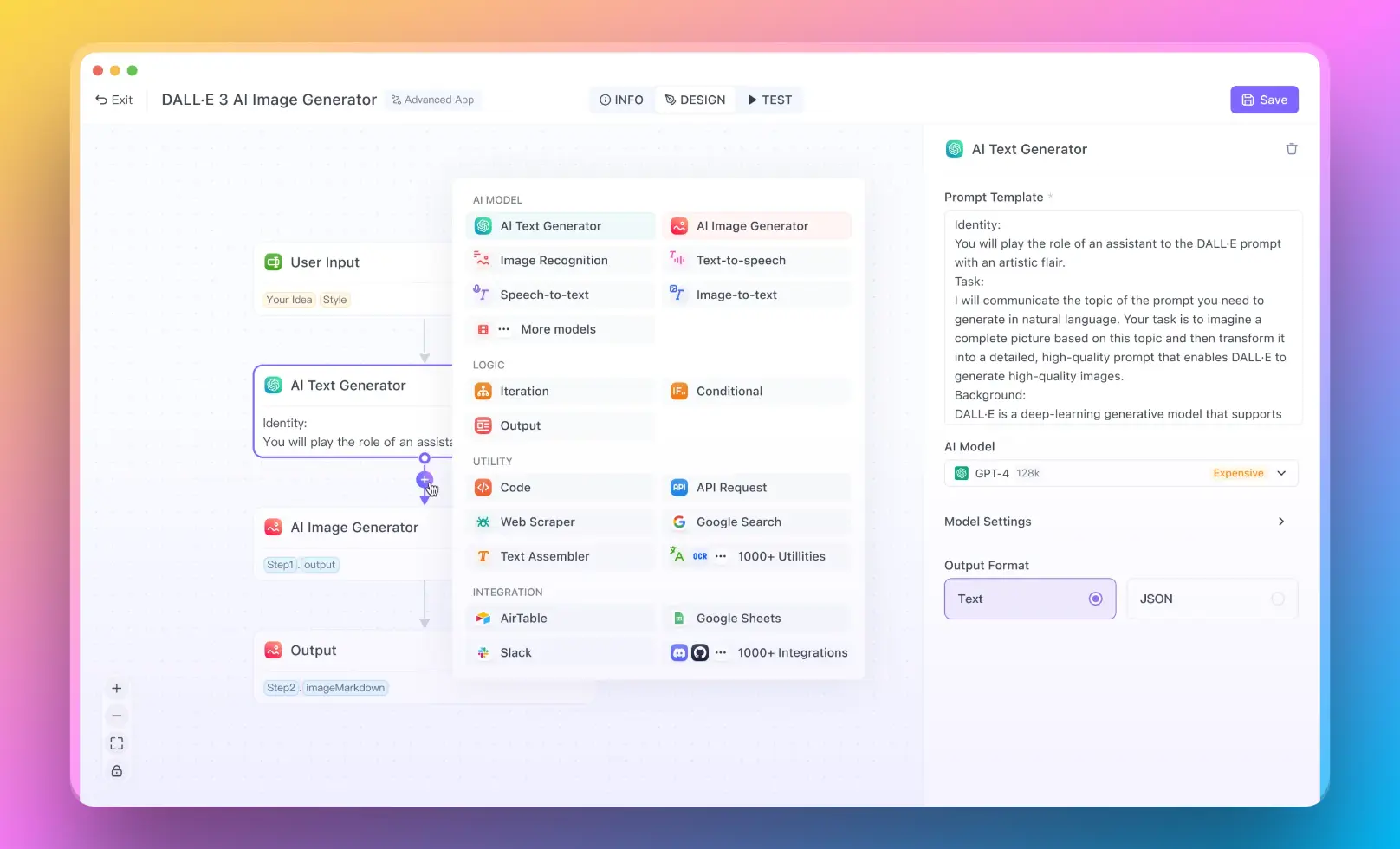

Anakin AIは、すべてのワークフロー自動化のためのオールインワンプラットフォームであり、使いやすいノーコードアプリビルダーを使って強力なAIアプリを作成できます。Llama 3、Claude 3.5 Sonnet、GPT-4、無修正LLM、Stable Diffusionなどを使って…

数分以内に夢のAIアプリを構築しましょう。Anakin AIを利用すれば、数週間ではなく!

DeepSeek AIとは?

DeepSeek AIは、大規模な言語モデル(LLMs)のコレクションであり、その優れた推論、数学、コーディング、および一般知識タスクにおける能力によりAIコミュニティで大きな注目を集めています。DeepSeekの特異点は、パフォーマンスだけでなく、そのアクセスのしやすさにもあります。同社は、研究者、開発者、および愛好者が多くの商業AIサービスに伴う高価なコストなしに利用できるように、いくつかのモデルのバージョンをオープンソースとして提供しています。

DeepSeekモデルファミリーには以下が含まれます:

- DeepSeek-R1: 会社の第一世代の推論モデルで、1.5Bから671Bパラメータまでさまざまなサイズで提供されています

- DeepSeek-V3: 一般的な対話に最適化された会話AIモデル

- DeepSeek Coder: プログラミングおよびコード生成タスク用の専門モデル

これらのモデルは、ベンチマークテストで素晴らしいパフォーマンスを示しており、一部のバージョンは、主要なAI企業からのはるかに高価な独自モデルの能力に近づくか、あるいはそれに匹敵するものとなっています。

Anakin AIの利用:DeepSeekへのアクセスの最も簡単な方法

より技術的なアプローチに飛び込む前に、セットアップや技術的な知識なしでDeepSeekモデルにアクセスする最も簡単な方法、Anakin AIを探ってみましょう。

Anakin AIは、多くの強力なAIモデル、DeepSeekを含む、無料でアクセスできるオールインワンAIプラットフォームです。このユーザーフレンドリーなプラットフォームを使用すると、何もダウンロードしたり、複雑な環境を設定したりすることなく、DeepSeekの機能をすぐに使用開始できます。

Anakin AIの使い方:

- anakin.aiにアクセスし、無料アカウントを作成します

- アプリストアセクションに移動し、「DeepSeek」を検索します

- DeepSeekアプリケーションが複数表示され、DeepSeek-R1およびDeepSeek V3が含まれています

- 希望のDeepSeekモデルの「このアプリを使う」をクリックします

- 直感的なチャットインターフェースを介してすぐにモデルと対話を開始します

Anakin AIには、DeepSeekへのアクセスに対するいくつかの利点があります:

- インストールやセットアップは不要

- 初心者と専門家の両方に設計されたユーザーフレンドリーなインターフェース

- DeepSeekだけでなく、複数のAIモデルへのアクセス

- 合理的な使用制限のある無料プラン

- カスタムワークフローやバッチ処理などの高度な機能

Anakin AIを使用することで、ハードウェア要件や技術的な設定を心配することなく、質問への回答、コンテンツ生成、コーディング支援、問題解決などのタスクに対してDeepSeekの能力を体験することができます。

OllamaでDeepSeekをローカルに実行する

プライバシーや管理、そして潜在的にはより高いパフォーマンスを求めてAIモデルを自分のハードウェアでローカルに実行したい方にとって、Ollamaは自分のコンピュータ上でDeepSeekモデルをデプロイするための優れたソリューションを提供します。

DeepSeekをローカルに実行するための要件:

ハードウェア要件は、使用予定のDeepSeekのバージョンによって異なります:

- 小型モデル(1.5B、7B、または8B)の場合: モダンなCPUと少なくとも16GBのRAM、理想的には十分なGPU(8GB以上のVRAM)

- 中型モデル(14B、32B)の場合: 16-24GBのVRAMを持つ強力なGPU

- 大型モデル(70B)の場合: 40GB以上のVRAMを持つ高性能GPU

- 671Bモデル全体の場合: 複数の強力なGPUを搭載したエンタープライズグレードのハードウェア

OllamaでDeepSeekを実行するためのステップバイステップガイド:

Ollamaのインストール:

- macOSおよびLinuxの場合:

curl -fsSL <https://ollama.com/install.sh> | sh - Windowsの場合: ollama.com/downloadからインストーラーをダウンロードします

DeepSeekをダウンロードして実行: ハードウェア能力に基づいて適切なモデルサイズを選択します:

# エントリーレベルのシステム用(1.5Bバージョン)

ollama run deepseek-r1:1.5b

# 中価格帯のシステム用(7Bバージョン)

ollama run deepseek-r1:7b

# より良いシステム用(8B Llamaベースのバージョン)

ollama run deepseek-r1:8b

# 高性能システム用(14Bバージョン)

ollama run deepseek-r1:14b

モデルとの対話: モデルが読み込まれると、質問をしたりプロンプトを提供したりするためのコマンドプロンプトが表示されます:

>>> 量子コンピュータの重要性は何ですか?

モデルの管理:

- インストールされたモデルをリスト表示:

ollama list - モデルを削除:

ollama rm deepseek-r1:7b - モデル情報を表示:

ollama show deepseek-r1

グラフィカルインターフェースの追加:

Ollamaはデフォルトでコマンドラインインターフェースを提供しますが、グラフィカルユーザーインターフェースを使用して体験を向上させることができます。人気のオプションには以下があります:

- Open WebUI: Ollamaモデルと対話するための豊富な機能を持つWebインターフェース

- LM Studio: ローカルの言語モデルを管理し、利用するためのデスクトップアプリケーション

- MSTY.app: Ollamaに最適化されたユーザーフレンドリーなインターフェース

たとえば、Open WebUIをインストールするには、Dockerを使用することができます:

docker run -d --name openwebui -p 3000:8080 -v open-webui:/app/backend/data --restart always ghcr.io/open-webui/open-webui:latest

その後、ブラウザでhttp://localhost:3000にアクセスします。

クラウドプラットフォーム上のDeepSeek

DeepSeekをローカルで実行するためのハードウェアがない場合でも、モデルを直接制御したい場合、市場にはDeepSeekモデルをデプロイするための無料または低コストのオプションを提供するいくつかのクラウドプラットフォームがあります:

Google Colab(無料プラン)

新しいGoogle Colabノートブックを作成します

必要なパッケージをインストールします:

!pip install transformers torch accelerate

DeepSeekを読み込み使用します:

from transformers import AutoModelForCausalLM, AutoTokenizer

model_id = "deepseek-ai/deepseek-r1-7b"

tokenizer = AutoTokenizer.from_pretrained(model_id)

model = AutoModelForCausalLM.from_pretrained(model_id)

# テキストを生成

inputs = tokenizer("人工知能についての詩を書いて", return_tensors="pt")

outputs = model.generate(**inputs, max_length=200)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))

Hugging Face Spaces

- 無料のHugging Faceアカウントを作成します

- 新しいSpaceを作成します

- Gradioをフレームワークとして選択します

- 提供されたテンプレートを使用してDeepSeek用のシンプルなインターフェースを構築します

DeepSeekを使用したRAGアプリケーションの構築

DeepSeekの最も強力なアプリケーションの1つは、特定の知識ベースを参照できる取得強化生成(RAG)システムを構築することです。以下は、DeepSeekで無料のRAGシステムを作成するための簡略化されたアプローチです:

DeepSeekとLangChainの使用:

必要なパッケージをインストールします:

pip install langchain langchain-community langchain-deepseek-official

ドキュメント処理の設定:

from langchain.document_loaders import PyPDFLoader

from langchain.text_splitter import RecursiveCharacterTextSplitter

# ドキュメントを読み込む

loader = PyPDFLoader("your_document.pdf")

data = loader.load()

# チャンクに分割

text_splitter = RecursiveCharacterTextSplitter(chunk_size=1000, chunk_overlap=100)

documents = text_splitter.split_documents(data)

埋め込みを作成し、ベクトルストレージを設定:

from langchain.embeddings import HuggingFaceEmbeddings

from langchain.vectorstores import FAISS

# 無料の埋め込みモデルを使用

embeddings = HuggingFaceEmbeddings(model_name="all-MiniLM-L6-v2")

# ベクトルストアを作成

vectorstore = FAISS.from_documents(documents, embeddings)

無料のNVIDIA NIMサービスでDeepSeekをセットアップ:

from langchain_nvidia_ai_endpoints import ChatNVIDIA

from langchain.chains import RetrievalQA

# NVIDIA NIMから無料のAPIキーを取得

llm = ChatNVIDIA(

model="deepseek-ai/deepseek-r1",

api_key="your_free_nvidia_nim_api_key",

temperature=0.7

)

# RAGチェーンを作成

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff",

retriever=vectorstore.as_retriever()

)

# システムにクエリを実行

result = qa_chain.invoke({"query": "ドキュメントの重要なポイントは何ですか?"})

print(result["result"])

DeepSeek APIアクセスオプション

モデルを自分でセットアップすることなくAPIコールを通じてDeepSeekを使用することを好む場合、無料または低コストでアクセスできるいくつかのオプションがあります:

- NVIDIA NIM: 新しいユーザー向けに無料クレジットを提供するDeepSeekモデル

- Perplexity API: 寛大な無料プランでDeepSeekモデルへのアクセスを提供

- DeepSeekの公式プラットフォーム: 開発者向けに時折無料APIクレジットを提供

NVIDIA NIMの利用を開始する方法:

- nim.nvidia.comでアカウントを作成します

- AIモデルセクションに移動し、DeepSeekを選択します

- APIキーを生成します

- LangChainなどのライブラリやREST APIコールを介してアプリケーションでキーを使用します

コミュニティリソースとオープンソースツール

オープンソースコミュニティは、DeepSeekの体験を向上させるための多くの無料ツールを開発しました:

- LangChain統合: DeepSeekを使用してアプリケーションを構築するための無料フレームワーク

- DeepSeek GitHubリポジトリ: DeepSeekからの公式コードと例

- モデル量子化ツール: パフォーマンスを大きく損なうことなくモデルサイズを縮小するためのGPTQやAWQなどのツール

- Discordコミュニティ: ヒントやユースケースを共有する活発なユーザーコミュニティ

限られたハードウェアでのDeepSeekパフォーマンスの最適化

限られたハードウェアでDeepSeekをローカルで実行している場合、次の最適化技術が役立つことがあります:

- 量子化モデルの使用: 4ビットまたは8ビットの量子化バージョンは、メモリ要件を大幅に削減します

- コンテキストの長さを短縮: 入力コンテキストを制限してメモリ使用量を減少させます

- システムリソースの最適化: 不要なアプリケーションやプロセスを終了します

- GPUアクセラレーションの利用: 古いGPUでもCPUのみの推論に比べて大幅なスピードアップが可能です

結論:無料AIの未来を受け入れる

DeepSeekは、強力なAIモデルへのアクセスの民主化における重要なマイルストーンを表しています。高度な言語モデルをオープンソースとして提供することにより、DeepSeekは個人、研究者、組織が従来の制約なしに最先端のAI機能を活用できるようにしました。

これらのモデルをローカルで実行することは、最も多くの制御とプライバシーを提供しますが、Anakin AIのようなプラットフォームは、DeepSeekの機能を即座に体験するための最もユーザーフレンドリーなアプローチを提供します。Anakinの直感的なインターフェースは、無料プランやDeepSeekだけでなく複数のモデルへのアクセスと組み合わさり、この技術の可能性を探るための優れた出発点となります。

単純さのためにAnakin AIを使用するのか、最大のコントロールを得るためにOllamaでDeepSeekをローカルで実行するのか、またはスケーラビリティのためにクラウドプラットフォームを利用するのか、DeepSeekのようなオープンソースモデルを通じてAI技術の民主化は新たなイノベーションと創造性の世代を力づけています。

DeepSeekを使った旅を始める際、最も強力なAIアプリケーションは、これらのモデルを独自のデータ、問題、洞察と組み合わせることから生まれることを忘れないでください。このガイドに示されたツールと方法は出発点にすぎません。本当の魔法は、あなたがそれらを使って構築するものにあります。