それなら、アナキンAIを見逃してはいけません!

アナキンAIは、すべてのワークフロー自動化のためのオールインワンプラットフォームであり、使いやすいノーコードアプリビルダーを使って強力なAIアプリを作成し、Deepseek、OpenAIのo3-mini-high、Claude 3.7 Sonnet、FLUX、Minimax Video、Hunyuanなどを搭載しています。

アナキンAIで数分以内に夢のAIアプリを構築しましょう!

イントロダクション

人工知能は近年目覚ましい進歩を遂げ、強力な言語モデルが日常のユーザーにますますアクセスしやすくなっています。DeepSeekが開発したDeepSeek R1は、今日利用可能な最も先進的なオープンソースAIモデルの一つを代表しています。DeepSeek R1の特に印象的な点は、商業モデルであるOpenAIのo1やClaude 3.5 Sonnetと同等の数学、コーディング、推論タスクの能力を持ちながら、ローカルでの使用が可能であることです。

この包括的なチュートリアルでは、PC上でDeepSeek R1をダウンロードして実行するプロセスを案内します。また、DeepSeekの機能を活用するための技術的負担なしに、アナキンAIという強力なプラットフォームをご紹介します。

DeepSeek R1の理解

DeepSeek R1は、異なるハードウェア構成に対応するための複数のサイズで利用可能なDeepSeekの第一世代推論モデルシリーズです。小型の蒸留版から671Bパラメータのフルモデルまで、DeepSeek R1はさまざまな計算リソースを持つユーザーに柔軟性を提供します。このモデルはMITのライセンスの下で利用可能で、個人および商業利用が許可されています。

DeepSeek R1は以下のタスクに優れています:

- テキスト生成: 記事、要約、創造的なコンテンツの作成

- コード支援: 複数のプログラミング言語でのコード生成とデバッグ

- 自然言語理解: 微妙な理解での人間の入力に対する解釈

- 質問応答: 文脈に基づいた情報提供レスポンス

システム要件

DeepSeek R1をローカルで実行する前に、システムが必要な要件を満たしていることを確認してください。これらは、使用するモデルのバージョンによって異なります:

- 小型モデル(1.5B、7B、または8B用): 最低16GBのRAMを備えた最新のCPU、およびできれば8GB以上のVRAMを持つGPU

- 中型モデル(14B、32B用): 16〜24GBのVRAMを持つ強力なGPU

- 大型モデル(70B用): 40GB以上のVRAMを持つハイエンドGPUまたは複数のGPU

- フル671Bモデル用: 複数の強力なGPUを備えたエンタープライズグレードのハードウェア

DeepSeek R1は、macOS、Linux、およびWindowsオペレーティングシステムをサポートしています。

Ollamaを使用してDeepSeek R1をローカルで実行する

Ollamaは、大型言語モデルをローカルで実行するための最も人気のあるソリューションの一つとして登場しました。モデルのダウンロード、初期化、特定のハードウェアに対する最適化を処理することで、プロセスを簡素化します。

ステップ1: Ollamaをインストールする

まず、システムにOllamaをインストールしましょう:

macOS用:

brew install ollama

Homebrewがインストールされていない場合は、brew.shにアクセスしてセットアップ手順に従ってください。

Windows用: 公式ウェブサイトからOllamaをダウンロードし、インストールウィザードに従ってください。

Linux用:

curl -fsSL <https://ollama.com/install.sh> | sh

インストール後、Ollamaが正常に動作していることを確認してください:

ollama --version

ステップ2: DeepSeek R1をダウンロードする

Ollamaがインストールされたら、簡単なコマンドでDeepSeek R1をダウンロードできます。ハードウェアの能力に基づいて適切なモデルサイズを選択してください:

ollama pull deepseek-r1

小型版を指定する場合は、モデルのサイズを指定してください:

ollama pull deepseek-r1:1.5b

利用可能な他のサイズには次のものが含まれます:

deepseek-r1:7b(4.7GBダウンロード)deepseek-r1:8b(4.9GBダウンロード)deepseek-r1:14b(9.0GBダウンロード)deepseek-r1:32b(20GBダウンロード)deepseek-r1:70b(43GBダウンロード)deepseek-r1:671b(404GBダウンロード - エンタープライズハードウェアが必要)

ステップ3: モデルを起動する

モデルをダウンロードした後、Ollamaサーバーを起動します:

ollama serve

その後、DeepSeek R1を実行します:

ollama run deepseek-r1

特定のバージョンを使用する場合:

ollama run deepseek-r1:1.5b

ステップ4: DeepSeek R1との対話

モデルが実行中の状態で、ターミナルで対話することができます。単にクエリを入力し、Enterを押してください:

>>> C++のクラスとは何ですか?

DeepSeek R1は、あなたのクエリを処理し、そのトレーニングに基づいて詳細な応答を提供します。

Ollamaを使った高度な使用法

Ollamaは、DeepSeek R1との体験を向上させるためのいくつかの高度な機能を提供しています:

カスタムパラメータ

温度やtop-pのようなパラメータを使用して、モデルの動作をカスタマイズできます:

ollama run deepseek-r1:8b --temperature 0.7 --top-p 0.9

APIの使用

Ollamaは、モデルをアプリケーションに統合するためのHTTP APIを提供します:

curl -X POST <http://localhost:11434/api/generate> -d '{

"model": "deepseek-r1:8b",

"prompt": "量子コンピューティングを簡単な言葉で説明してください",

"stream": false

}'

パフォーマンス最適化のヒント

DeepSeek R1をローカルで実行する際の最適なパフォーマンスを得るには:

- GPUアクセラレーション: GPUドライバが最新で適切に設定されていることを確認してください。

- メモリ管理: 大型モデルを実行する際は、不要なアプリケーションを閉じてください。

- 量子化: 特定のニーズに合わせて異なる量子化設定を試してみてください。

- コンテキストウィンドウ管理: プロンプトと応答の長さを意識して、メモリ使用を最適化してください。

- 冷却: システムに適切な冷却があることを確認して、熱スロットリングを防ぎます。

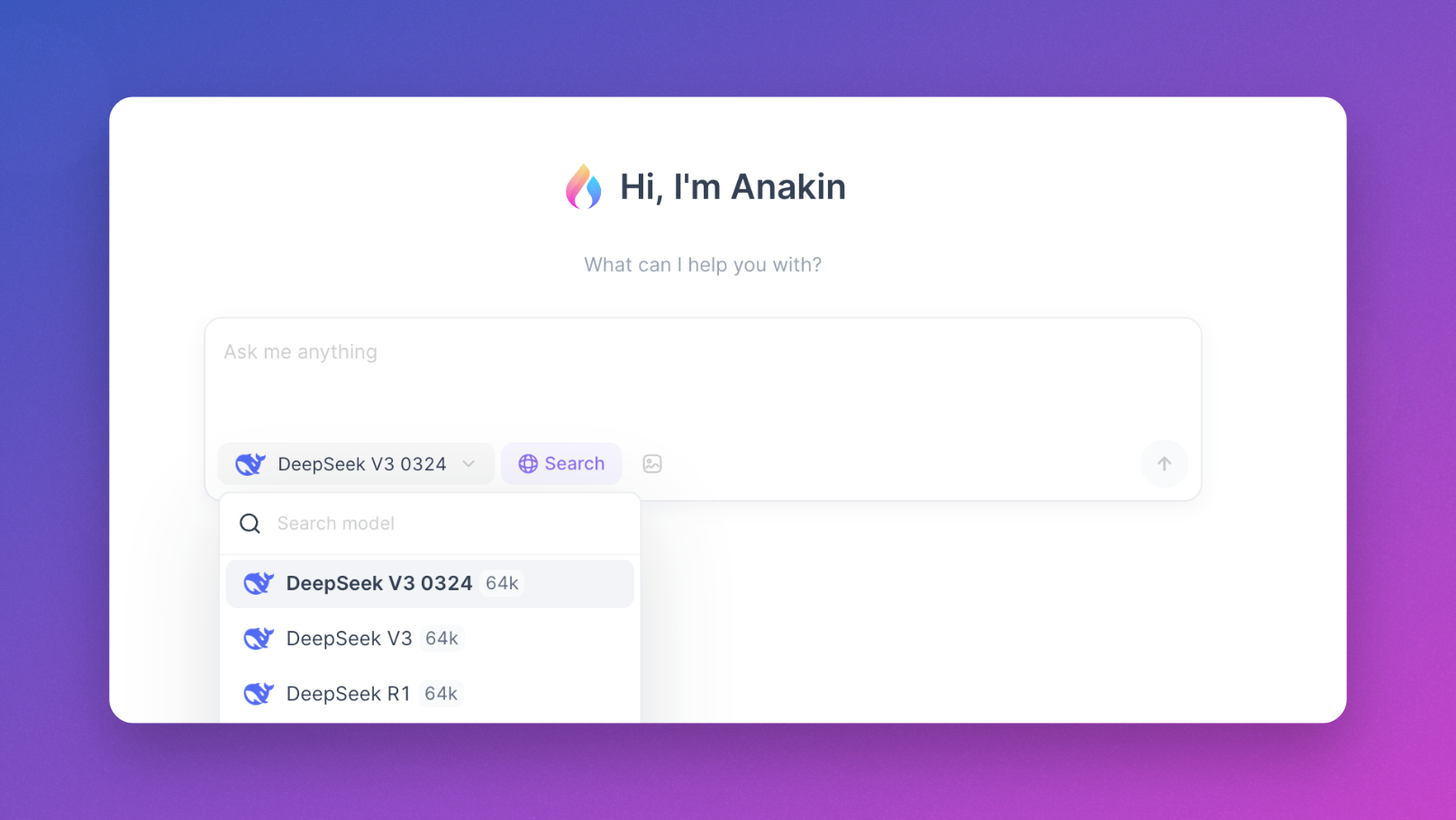

アナキンAIの使用: 強力な代替手段

Ollamaを使ってローカルでモデルを実行することは、優れたコントロールとプライバシーを提供しますが、計算リソースと技術的なセットアップが必要です。特に強力なハードウェアにアクセスできないユーザーにとって、アナキンAIはローカルインストールの複雑さなしでDeepSeekや他の強力なモデルを体験できる優れた代替手段を提供します。

アナキンAIとは何ですか?

アナキンAIは、次の機能を提供するオールインワンプラットフォームです:

- 即時アクセス: DeepSeekや他の強力なモデルを、ダウンロードやインストールなしでブラウザ上で直接使用できます。

- ユーザーフレンドリーなインターフェース: AIモデルとの対話を簡単にするクリーンで直感的なチャットインターフェース。

- 複数モデルサポート: DeepSeekだけでなく、Llama、Mistral、Dolphinなど多くのオープンソースLLMにもアクセス可能。

- ハードウェア制約なし: ノートパソコンやタブレットのような控えめなハードウェアでも大型モデルとの会話を実行できます。

- 永続的な会話: すべてのチャットが保存され、簡単に参照できるように整理されます。

- 高度な機能: AIアプリケーションを作成し、データと統合し、カスタムワークフローを構築します。

アナキンAIの使い始め方

アナキンAIを通じてDeepSeek R1を使用するには:

- https://anakin.aiにアクセス

- アカウントを作成またはサインイン

- 利用可能なモデルからDeepSeekを選択

- セットアップなしで即座にチャットを開始

アナキンAIを使用する利点

アナキンAIは特に以下のようなユーザーにとって有益です:

- ハードウェアリソースが限られているユーザー

- 技術的セットアップなしで素早くアクセスする必要がある人々

- 同じAIインフラを使用して協力したいチーム

- ローカルにデプロイする前にさまざまなモデルをテストしたい開発者

アナキンAIは、コーディング知識なしでAIワークフローを作成できる機能も提供しており、すべての技術的バックグラウンドのユーザーにとってアクセスしやすいオプションとなっています。

DeepSeek R1を使用したアプリケーションの構築

シンプルなチャットインタラクションを超えて、DeepSeek R1はさまざまなアプリケーションに統合できます:

コード生成と分析

DeepSeek R1はコード関連のタスクに優れており、開発者が次のようなことをしたいときに貴重です:

- 要件に基づいてコードスニペットを生成する

- 既存のコードをデバッグする

- アルゴリズムを最適化する

- プログラミング言語間で翻訳する

研究と分析

モデルの推論能力により、次のようなタスクに適しています:

- 学術論文の要約

- データトレンドの分析

- 仮説の生成

- 構造化されたレポートの作成

コンテンツ作成

DeepSeek R1を使用して:

- 記事を書くおよび編集する

- マーケティングコピーを作成する

- 創造的なコンテンツを生成する

- 言語間で翻訳する

結論

Ollamaを使用してDeepSeek R1をローカルで実行することは、強力なAIモデルへのアクセスを民主化する上で大きな前進を表しています。このアプローチにより、データと対話に対する完全なコントロールを得ながら、最先端の言語処理能力を活用できます。

ハードウェアリソースと技術的快適度に応じて、Ollamaを通じてモデルをローカルで実行するか、アナキンAIのようなユーザーフレンドリーなプラットフォームを通じてアクセスするかを選択できます。どちらのアプローチにも利点があります:

- Ollamaを使用したローカルインストール: 最大のプライバシー、コントロール、カスタマイズが可能ですが、適切なハードウェアが必要です

- アナキンAI: 即時アクセス、ハードウェア制約なし、ユーザーフレンドリーなインターフェース、追加のワークフロー機能

次世代のAI駆動アプリケーションを構築する開発者であれ、大型言語モデルの能力を探る研究者であれ、最前線のAI体験に興味がある愛好家であれ、DeepSeek R1は以前は専有のサービスを通じてのみ利用可能だった印象的な機能を提供します。

このガイドに従うことで、Ollamaを使用してDeepSeek R1をローカルで実行するか、特定のニーズとリソースに応じてアナキンAIを通じてアクセスする知識を得ました。高度なAIの力が今あなたの指先にあります!