DeepSeek V3-0324は、名前にリリース日である2025年3月24日が埋め込まれたDeepSeek V3モデルの更新チェックポイントです。初期の議論では、最近の記事で指摘されたように、コーディング能力や複雑な推論の改善が示唆されています。このモデルは、GitHub DeepSeek-V3 GitHub とHugging Face DeepSeek-V3-0324 Hugging Face で利用可能であり、オープンソースの性質とアクセスのしやすさを反映しています。

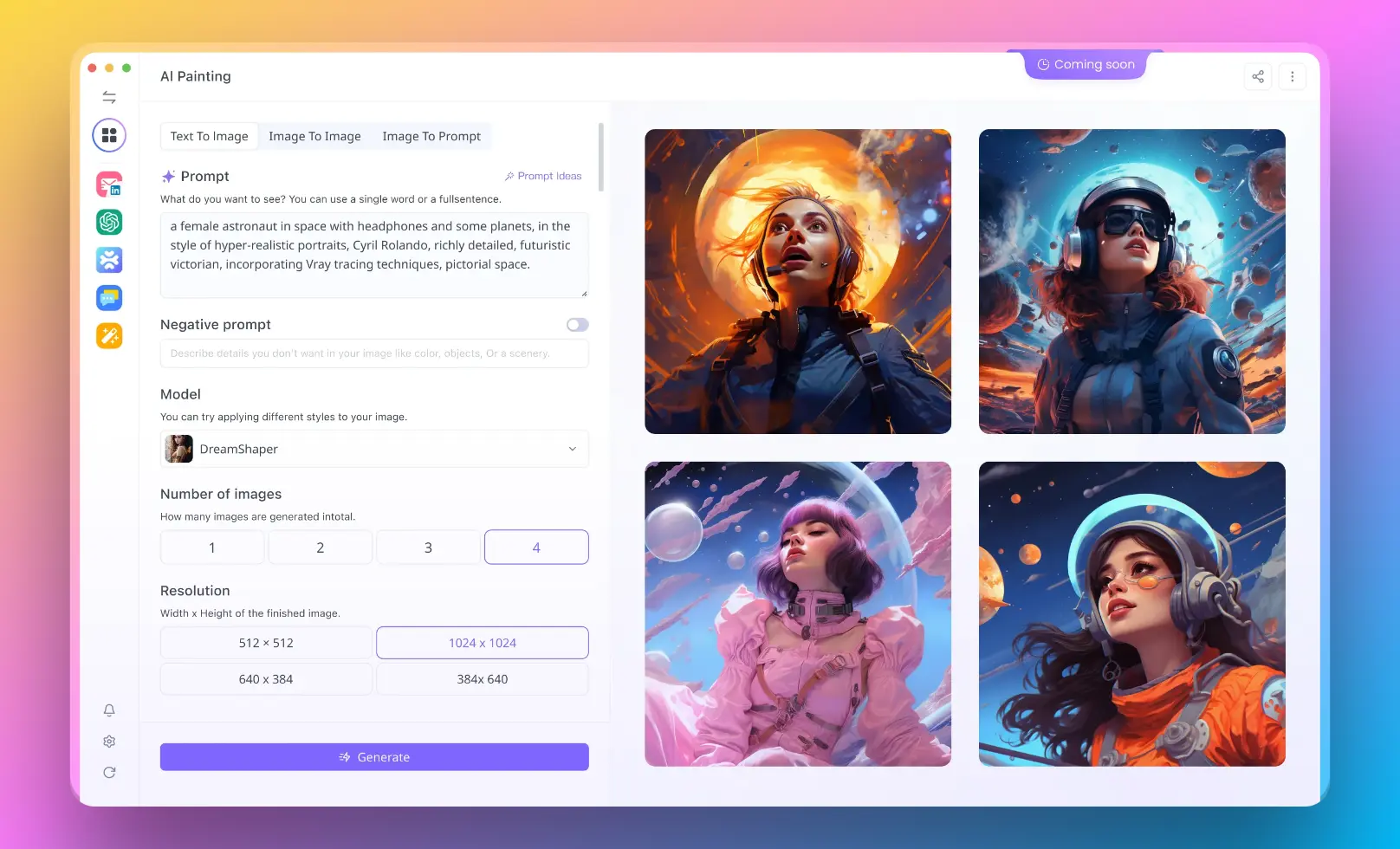

今すぐ DeepSeek V3 0304 を試してみませんか? 今すぐ Anakin AI をご利用ください! Anakin AI は、Claude 3.7 Sonnet Thinking、o1-Pro、Google Gemini 2.0、FLUX AI 画像生成、Minimax AI ビデオ生成など、さまざまな機能を 1 か所にまとめたオールインワン プラットフォームです。

DeepSeek V3-0324の紹介

DeepSeek V3-0324は、DeepSeek AIが開発した最先端のオープンソース言語モデルで、2025年3月24日にリリースされました。このモデルは、スケールと効率性で知られる初期のDeepSeek V3の更新版です。合計6710億のパラメータを持ち、トークンごとに37億のみがアクティブで、高度なアーキテクチャを活用して、コーディング、推論、多言語処理のような複雑なタスクを扱います。本記事では、そのアーキテクチャ、トレーニング、パフォーマンス、および可能性を探り、AIの進歩に興味のある人々に洞察を提供します。

DeepSeek V3-0324のモデルアーキテクチャ

DeepSeek V3-0324は、複数の専門家ネットワークが異なるデータの側面を専門とするMixture-of-Experts (MoE)アプローチを採用しています。これにより、合計6710億のパラメータが可能になり、トークンごとに37億のみがアクティブになり、効率性が向上します。Multi-head Latent Attention (MLA)は、キーとバリューのベクトルを圧縮し、メモリ使用量を削減し、長い文脈の推論を迅速化します。DeepSeekMoEアーキテクチャは、洗練されたMoEのバリアントであり、追加の損失項なしで負荷を均衡させ、トレーニングを安定化させます。さらに、Multi-Token Prediction (MTP)目的は、複数の将来のトークンを予測し、トレーニング信号を密にし、投機的デコーディングによる生成の迅速化を可能にします。

それなら、Anakin AIをお見逃しなく!

Anakin AIは、すべてのワークフロー自動化のためのオールインワンプラットフォームで、DeepseekやOpenAIのo3-mini-high、Claude 3.7 Sonnet、FLUX、Minimax Video、Hunyuanなどを使って簡単に強力なAIアプリを作成できます。

数分で夢のAIアプリを作成できるAnakin AIをお試しください!

このモデルは、数学、プログラミング、および複数の言語をカバーする148兆の高品質で多様なトークンで事前にトレーニングされました。従来の方法と比較して、トレーニングコストと時間を削減するためにFP8混合精度を使用します。トレーニング後は、領域を横断する150万インスタンスを使用した教師付きファインチューニングが含まれ、強化学習によって推論やコード生成などの能力が洗練されます。このプロセスでは278万時間のH800 GPUが必要で、コスト効率の良さを強調しています。

DeepSeek V3-0324のパフォーマンスと評価

DeepSeek V3-0324は、特にコーディングや推論においてさまざまなベンチマークで優れた結果を示しています。コード生成においてHumanEvalで65.2%、数学でGSM8Kで89.3%を達成し、多くのオープンソースモデルを上回っています。トレーニング後は、MMLUで88.5%、AlpacaEval 2.0で70.0%を記録し、GPT-4oやClaude-3.5-Sonnetなどのクローズドソースモデルと競争しています。128Kのコンテキストウィンドウを処理し、MTPを介して1.8倍のトークン毎秒(TPS)を達成する能力は、実用的な効率を強調します。

この調査ノートは、2025年3月24日にDeepSeek AIによってリリースされたオープンソース言語モデルDeepSeek V3-0324の詳細な検討を提供します。これは、以前にリリースされたオリジナルのDeepSeek V3を基にしており、コーディングや推論タスクにおける進歩で知られています。以下のセクションでは、そのアーキテクチャ、トレーニング、評価、および将来の影響について掘り下げ、AI研究者や愛好者に対する徹底的な分析を提供します。

背景とリリース

モデルアーキテクチャ

DeepSeek V3-0324のアーキテクチャは、6710億の合計パラメータを持ち、トークンごとに37億がアクティブなMixture-of-Experts (MoE)フレームワークに根ざしています。この設計は、技術レポートで詳述されており、トークンごとに一部の専門家のみをアクティブにすることで効率的な計算を可能にします。報告書で説明されているMulti-head Latent Attention (MLA)は、キーとバリューのベクトルを圧縮してKVキャッシュを削減し、推論速度を向上させます。DeepSeekMoEアーキテクチャは、61のトランスフォーマーレイヤーとモエレイヤーごとに256のルーティングされた専門家を持ち、追加の損失項なしの負荷均衡戦略を含んでおり、追加の損失項なしで安定したトレーニングを確保します。Multi-Token Prediction (MTP)目的は、1つの追加トークン(D=1)を予測し、トレーニング信号を密にし、推論中に1.8倍のトークン毎秒(TPS)を実現します。

| アーキテクチャのコンポーネント | 詳細 |

|---|---|

| 合計パラメータ | 671B、トークンごとに37Bがアクティブ |

| MLA | KVキャッシュを圧縮、埋め込み次元7168、128ヘッド、ヘッドごとに128 |

| DeepSeekMoE | 61レイヤー、1共有専門家、256ルーティング、トークンごとに8アクティブ |

| MTP目的 | 次の2つのトークンを予測、損失重み0.3で初めて、次に0.1、D=1 |

トレーニングプロセス

トレーニングは148兆トークンで事前トレーニングされ、数学、プログラミング、および多言語のサンプルで強化されました。データ構築は冗長性の最小化を洗練し、クロスサンプルの注意マスキングなしでドキュメントパッキングを使用し、Prefix-Suffix-Middle (PSM)を介して0.1の割合で中間にフィル(FIM)戦略を使用しました。トークナイザーは、128KトークンのバイトレベルBPEであり、多言語効率のために修正されました。FP8混合精度トレーニングは、大規模で検証され、コストを削減しました。事前トレーニングに266.4万H800 GPU時間がかかり、完全なトレーニングでは278.8万時間のGPU時間を必要とし、GPU時間あたり2ドルの推定で約557万6千ドルかかりました。トレーニング後は、DeepSeek-R1のデータを用いて推論、DeepSeek-V2.5の非推論データを含む150万インスタンスに対する教師付きファインチューニングが含まれ、強化学習により検証されました。

| トレーニングの側面 | 詳細 |

|---|---|

| 事前トレーニングトークン | 148T、多様で高品質 |

| 精度 | FP8混合、アクティベーション用にタイル別、重み用にブロック別 |

| トレーニング後データ | 150万インスタンス、SFTおよびRL、領域には推論とコードが含まれる |

| GPU時間 | 278.8万H800、総コスト557.6万ドル(GPU時間あたり2ドル) |

評価とパフォーマンス

評価結果は技術レポートによると、DeepSeek V3-0324のベンチマーク全体での能力を示しています。事前トレーニング評価には以下が含まれます:

| ベンチマーク | メトリック | 結果 | 比較 |

|---|---|---|---|

| BBH | 3ショットEM | 87.5% | Qwen2.5 72B (79.8%)、LLaMA-3.1 405B (82.9%)を上回る |

| MMLU | 5ショットEM | 87.1% | DeepSeek-V2 Base (78.4%)を上回り、Qwen2.5 (85.0%)に近い |

| HumanEval | 0ショットP@1 | 65.2% | LLaMA-3.1 405B (54.9%)、Qwen2.5 72B (53.0%)を超える |

| GSM8K | 8ショットEM | 89.3% | Qwen2.5 72B (88.3%)、LLaMA-3.1 405B (83.5%)よりも優れている |

トレーニング後、チャットモデルはMMLUで88.5%、AlpacaEval 2.0で70.0%、GPT-4-0314に対してArena-Hardで86%以上の勝率を誇り、GPT-4oやClaude-3.5-Sonnetなどのクローズドソースモデルと競争しています。128KのコンテキストウィンドウとMTPによる1.8倍のTPSは、実用的な効率を強調し、以前のバージョンと比較してコーディング能力が向上したとの初期の議論があります。

アプリケーションと今後の方向性

DeepSeek V3-0324の能力は、自動コーディング、高度な推論システム、および多言語チャットボットのアプリケーションを示唆しています。そのオープンソースの性質は、コードのためのMITライセンスの下で商業利用を支持し、コミュニティの貢献を促進します。今後は、無限のコンテキストのためのアーキテクチャの洗練、データ品質の向上、および包括的な評価方法の探求が含まれる可能性があると、技術レポートの結論で示唆されています。

結論

DeepSeek V3-0324は、オープンソースAIの重要な進歩であり、クローズドソースモデルとのギャップを埋めるものです。その効率的なアーキテクチャ、広範なトレーニング、強力なパフォーマンスにより、自然言語処理のさらなる革新を推進する可能性を秘めています。