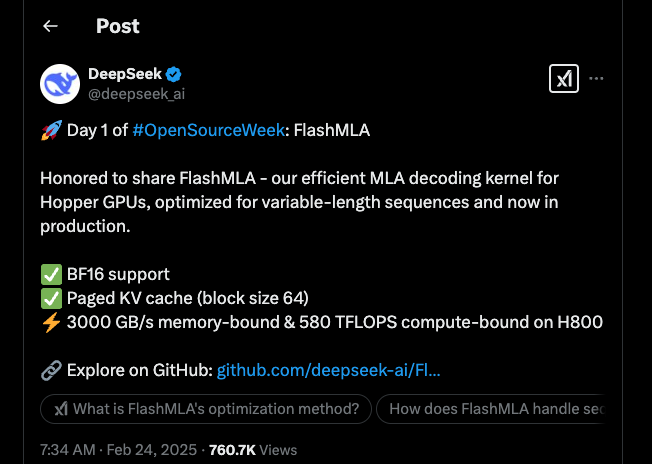

DeepSeekはオープンソースウィークを盛大に開始し、NVIDIAのHopper GPU用に作られた最先端のMLAデコーディングカーネルであるFlashMLAを発表しました。この発表はテックコミュニティで話題になっており、皆さんはこの更新がAI処理にどのような意味を持つのかを探ることに興味を持っています。

シームレスなビデオ制作と編集のためにAIの力を活用したいですか?Anakin AIがあなたのプラットフォームです!最先端のAIビデオジェネレーターを含む包括的なスイートを備えており、Runway ML、Minimax Video 01、Tencent Hunyuan Videoなど、あなたのクリエイティブビジョンを簡単に実現できます。シーンを変換したり、映画的なシーケンスを生成したり、高度なAIモデルで編集を洗練させたりする際には、Anakin AIが必要なものすべてを提供します。

🚀 今日から制作を始めましょう!ここでAIビデオツールを探索してください:Anakin AI Video Generation

FlashMLAとは何ですか?

FlashMLAは、マルチヘッド潜在アテンション(MLA)のデコードプロセスを加速するために設計された専門的なカーネルです。簡単に言うと、AIモデルが可変長シーケンスをより効率的に処理するのを助けます。自然言語処理やその他のAIタスクに興味がある場合、このツールは大きな拍車をかけることでしょう。

主要な特徴とパフォーマンス

BF16サポート

FlashMLAの際立った特徴の1つは、BF16(Brain Float 16)精度のサポートです。BF16を使用することで、カーネルは大規模AIモデルが要求する精度を犠牲にすることなく、メモリ使用量を削減します。ユーザーはその素晴らしさを称賛しており、ヘビー級の計算処理を行う際には本当にゲームチェンジャーであることが認識されています。

ページングKVキャッシュ

もう一つのクールな点は、ページングキー・バリューキャッシュで、ブロックサイズは64です。この設定はメモリを効率的に管理し、推論パフォーマンスを向上させるのに役立ちます。必要なツールがすぐに揃っている整然としたツールボックスのようなものです。

印象的なメトリック

パフォーマンスに関して、FlashMLAは期待に応えています。H800 SXM5 GPU上では、メモリバウンドシナリオで驚異的な3000 GB/sを記録し、計算バウンドのタスクでは最大580 TFLOPSを出力します。これらの数字は単に印象的であるだけでなく、カーネルの背後にある素晴らしいエンジニアリングを証明しています。

FlashMLAの際立つ特徴

FlashMLAは、FlashAttentionやNVIDIAのCUTLASSなどの有名なプロジェクトからインスピレーションを受けています。効率性と生産性の準備に焦点を当てて構築されたため、開発者はこれをワークフローにシームレスに統合できます。コミュニティの人々は、AIパフォーマンスの限界を押し上げることを真剣に考えている人には必須のツールだとすぐに評価しています。

統合とセットアップ

始めたい人にとって、インストールは簡単です。Hopper GPU、CUDA 12.3以上、PyTorch 2.0以上を使用すれば、次の簡単なコマンドでFlashMLAをインストールできます:python setup.py install

インストール後は、次のコマンドでベンチマークを実行できます:python tests/test_flash_mla.py

この簡単なプロセスは開発者の間で好評を博しており、多くの人々がFlashMLAが自分のプロジェクトをどのように変革しているかについて称賛の声を上げています。

大きなビジョン

DeepSeekによるFlashMLAのリリースは、オープンソースの革新のエキサイティングな週の始まりを示しています。同社はここで止まらず、世界中の開発者にこの新技術を共同で構築することを呼びかけています。AIが進化し続ける中で、FlashMLAのようなツールは高度なAIをよりアクセスしやすく、効率的にする上で重要な役割を果たします。

開発者やテクノロジー愛好者は、このプロジェクトに注目しています。FlashMLAを通じて、DeepSeekは限界を押し上げることへの明確なコミットメントを示しており、この発表はオープンソースウィークの氷山の一角に過ぎません。

最後の考え

DeepSeekによるFlashMLAの導入は、話題を呼んでいます。BF16の強力なサポート、革新的なページングKVキャッシュ、そして優れたパフォーマンスメトリックを考慮すると、このツールはAI処理における効率性の再定義を目指しています。AIの世界にいるなら、FlashMLAがあなたのために何をできるのかを探る絶好の機会です。DeepSeekがオープンソースウィークを通じて新しい刺激的な機能の展開を続ける中、さらなる更新にもご注目ください。